本文来源公众号“集智书童”,仅用于学术分享,侵权删,干货满满。

原文链接:微小目标检测新标杆 | DPNet首创动态神经网络范式,微小目标检测效率跃升35%!

精简阅读版本

本文主要解决了什么问题

-

1. 微小目标检测的精度与效率平衡问题:在复杂环境中,精确检测微小物体至关重要,但单纯放大图像会显著增加计算成本和负样本数量,严重降低检测性能并限制其适用性。

-

2. 动态调整下采样因子的需求:传统的静态神经网络对所有输入图像使用相同的降采样参数进行推理,无法根据输入图像的内容自适应调整下采样策略。

-

3. 多尺度训练中的特征分布不一致问题:不同下采样因子(df)导致的特征图分布差异显著,使得单一模型难以兼容多种df。

本文的核心创新是什么

-

1. 提出动态池化网络(DPNet):通过引入一个可调节的下采样因子 df,将特征图的固定下采样过程转化为灵活的过程,实现输入感知的下采样。

-

2. 设计自适应归一化模块(ANM):解决混合尺度训练中不同df带来的特征分布差异问题,使统一检测器能够与不同的 df 良好兼容。

-

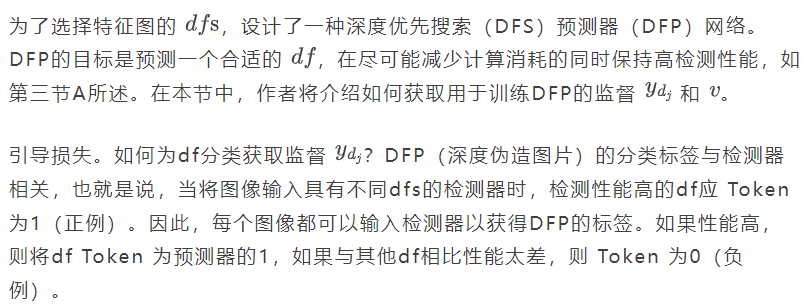

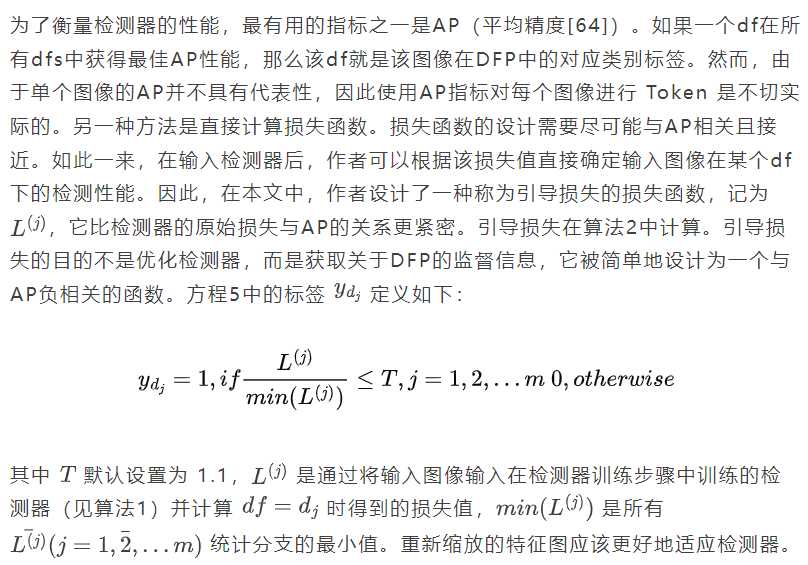

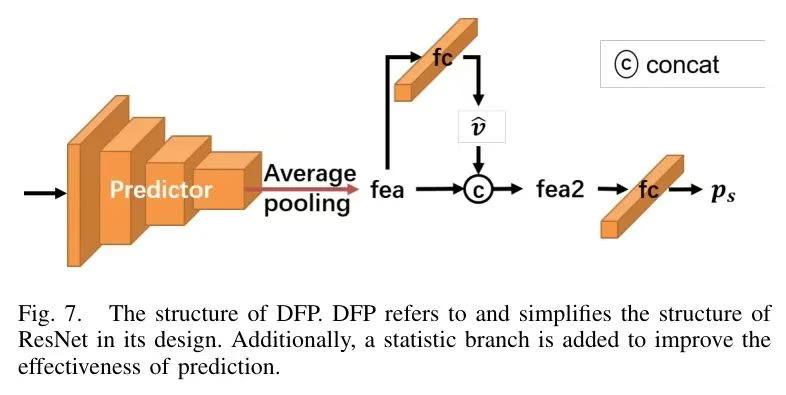

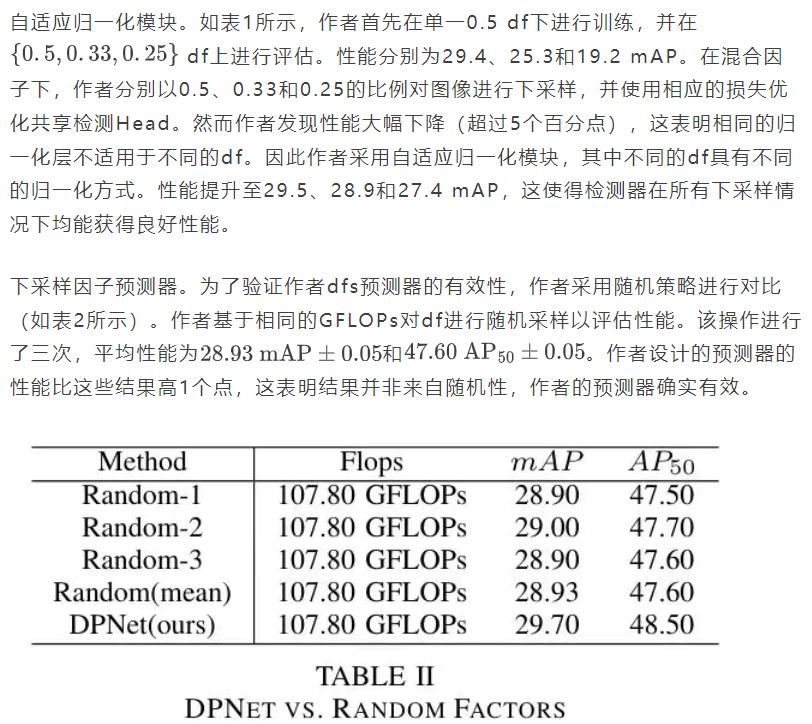

3. 引入下采样因子预测器(DFP):通过轻量级预测器预测每个输入图像的最佳 df,并设计引导损失来监督预测器的训练,实现动态分配计算资源。

-

4. 首次将动态神经网络思想应用于检测任务:通过动态调整下采样因子,在保持检测性能的同时显著降低计算成本。

结果相较于以前的方法有哪些提升

-

1. 显著降低计算成本:在TinyCOCO数据集上,DPNet可以节省超过35%的GFLOPs,同时保持相当的检测性能。

-

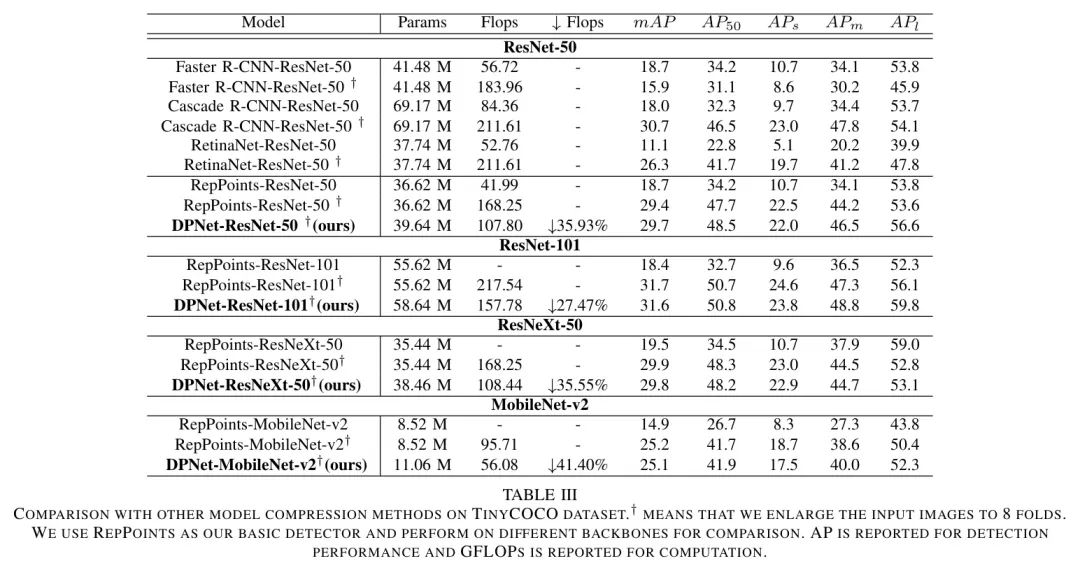

2. 更高的检测精度:在TinyPerson数据集上,DPNet的 AP_tiny 达到52.33,优于其他Baseline方法(如RetinaNet-S- alpha 和RetinaNet-SM)。

-

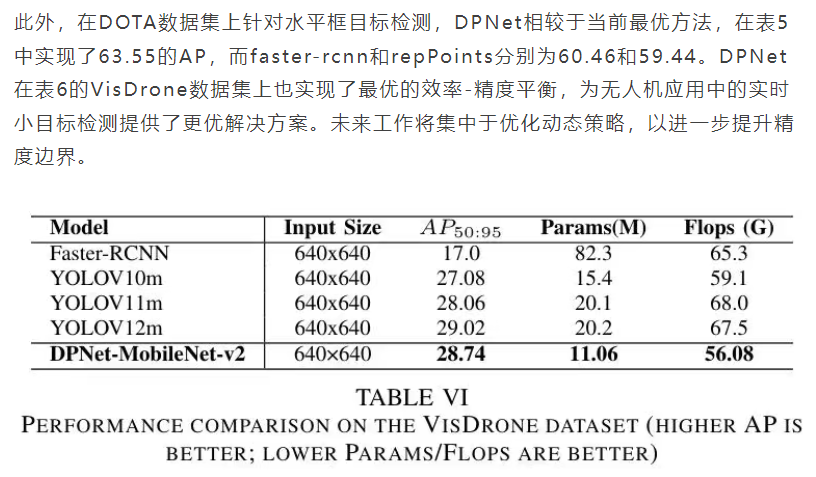

3. 广泛的适用性:DPNet不仅适用于ResNet等常规Backbone网络,还能与轻量级模型(如MobileNet-v2)协同工作,进一步减少计算量。

-

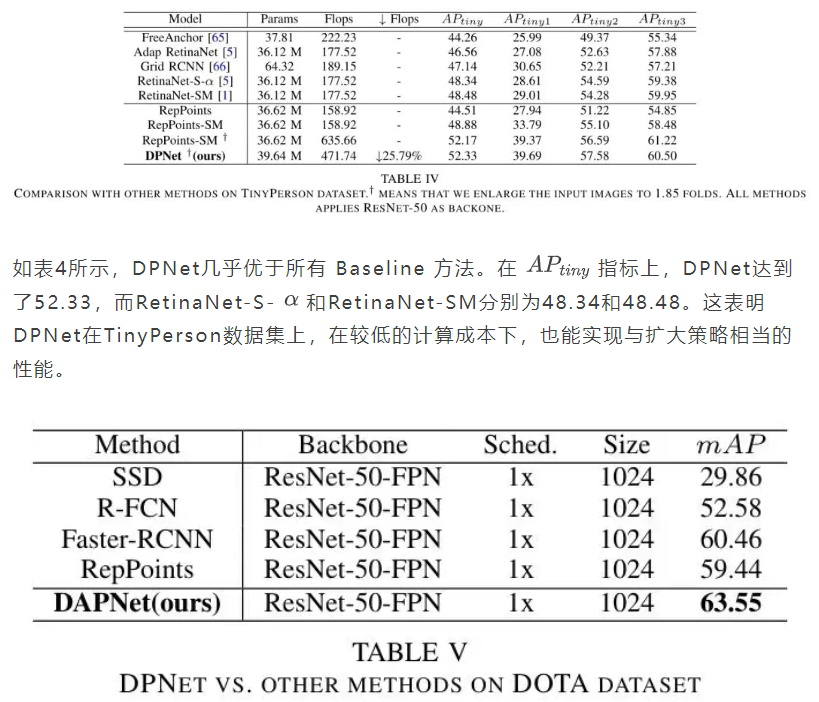

4. 实时性与精度的平衡:在VisDrone数据集上,DPNet实现了最优的效率-精度平衡,为无人机应用中的实时小目标检测提供了更优解决方案。

局限性总结

-

1. 依赖于候选df的选择:DPNet的性能在一定程度上依赖于预先设定的离散df值集合,若候选值不够全面,可能会影响最终效果。

-

2. 额外的训练开销:由于需要训练DFP和ANM,DPNet的整体训练过程比传统检测器更加复杂,增加了训练时间。

-

3. 对特定场景的适配性有限:尽管DPNet在多个数据集上表现出色,但对于极端条件下的微小目标(如极度低分辨率或高噪声环境),仍可能存在漏检问题。

-

4. 引导损失的设计依赖性强:引导损失的有效性高度依赖于检测器的原始损失函数,可能在某些特殊任务中表现不佳。

通过以上总结可以看出,DPNet在微小目标检测领域取得了重要突破,但在实际应用中仍需进一步优化以适应更多复杂场景。

深入阅读版本

在无人机系统中,特别是在复杂环境中,精确检测微小物体至关重要。调整图像大小是提高检测精度的常用策略,尤其对于小物体而言。然而,单纯放大图像会显著增加计算成本和负样本数量,严重降低检测性能并限制其适用性。

本文提出了一种动态池化网络(DPNet)用于微小目标检测,以缓解这些问题。DPNet通过引入一个因子df,将特征图的固定下采样过程转化为可调节的过程,从而采用灵活的下采样策略。此外,作者设计了一个轻量级预测器来预测每个输入图像的df,用于降低 Backbone 网络中特征图的分辨率。

因此,作者实现了输入感知的下采样。作者设计了一个自适应归一化模块(ANM),使统一检测器能够与不同的df良好兼容。同时,作者还设计了一个引导损失来监督预测器的训练。通过这种方式,DPNet实现了计算资源的动态分配,以在检测精度和效率之间进行权衡。在TinyCOCO和TinyPerson数据集上的实验表明,DPNet分别可以节省超过35%和25%的GFLOPs,同时保持相当相当的检测性能。代码将公开提供。

1. 引言

微目标检测(Tiny Object Detection, TOD)[1], [2], [3], [4], [5], [6], [7], [8], [9], [10]长期以来一直是目标检测领域具有挑战性的研究方向。TOD旨在准确检测尺寸微小且信噪比低的物体。由于真实场景中存在大量微目标,微目标检测具有广阔的应用前景。它在自动驾驶[11], [12]、智能医疗[13]、缺陷检测[14]以及航空图像分析[15], [16], [17], [18], [19]等众多领域发挥着不可或缺的作用,特别是在无人机系统图像识别与分析中。近年来,深度学习为微目标检测研究注入了新的活力。

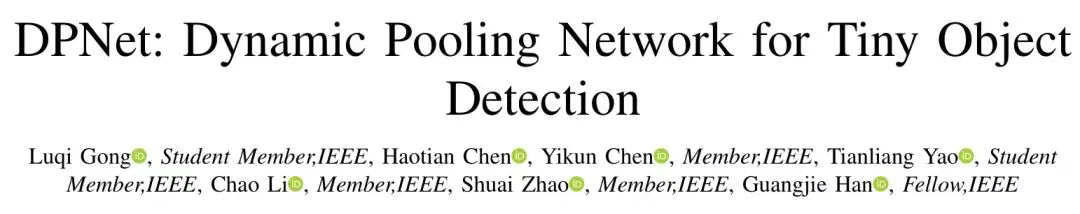

随着深度卷积神经网络(CNNs)的快速发展,目标检测器[20], [21], [22], [23]的研究取得了显著进展。对于与MS-COCO[24]中物体相比尺寸极其微小的目标,一种常见的方法是将预训练目标缩放到微目标尺寸,例如Scale Match(SM)[1]及其增强版SM+[3]所展示的方法。然而,这些方法在图像下采样时会造成信息损失。另一种常见方法是放大图像尺寸以使微目标变大[6], [2]。以图1为例,当作者对输入图像进行下采样时,检测器能够更好地检测小目标。因此,适当放大输入图像或减少下采样操作可以提高检测器对微目标的性能。然而,放大图像也带来了一些缺点:1)增加计算成本;2)产生更多负样本;3)冗余,如图2所示(对于某些物体,没有必要将图像放大)。

为了在速度和性能之间取得平衡,并消除因放大所有图像而引起的冗余,作者设计了一种具有可变深度降采样因子(用 df 表示)的动态神经网络,称为动态池化网络(DPNet)。与传统的(静态)神经网络[25], [26], [27], [28]不同,后者在测试时对所有输入图像使用相同的降采样参数进行推理,作者的DPNet在 df 方面应用自适应推理。

总之,作者的核心贡献如下:

-

• 作者提出了动态池化网络(DPNet),据作者所知,这是首次尝试将动态神经网络引入目标检测任务,以实现检测性能与计算量的平衡。

-

• 作者设计了自适应归一化模块(ANM)以解决混合尺度训练(MST)方案带来的尺度变化加剧问题。采用下采样因子预测器(DFP)在推理过程中自适应选择df,并设计了一个引导损失来监督其训练。

-

• 作者的DPNet能够在TinyCOCO数据集上保持相当检测性能的同时,将计算成本降低超过35%。不同 Backbone 网络上的实验验证了DPNet的有效性。

2. 相关工作

微目标检测是目标检测领域广泛关注的问题,吸引了越来越多的研究。目标尺度会影响检测性能。因此,许多研究工作集中于目标检测中的尺度问题。动态神经网络能够自适应地调整模型或输入,这有助于实现计算与性能的权衡。此外,为了减少计算量,使模型轻量化是一种传统思路。DPNet是一种新范式,可以与轻量化模型方法协同工作。

A. 微型目标检测

针对微目标检测,从多个方面进行了广泛的研究。低分辨率、弱信号和高噪声增加了微目标检测的难度,限制了其研究和应用。为了获取可靠的微目标特征表示,Yu等人[1]和Jiang等人[3]采用了使预训练数据集和目标数据集的尺度分布对齐的方法。Gong等人[5]设计了FPN[20]中相邻层之间有效的融合因子。

一些方法通过超分辨率(SR)技术恢复低分辨率目标的信息。EFPN[29]利用大规模SR特征,将原始FPN扩展到专门用于小尺寸目标检测的高分辨率 Level 。为了获取超分辨率特征,Noh等人[30]将高分辨率目标特征作为监督信号,匹配输入和目标特征的相应感受野。[31]提出了基于高斯感受野的标签分配(RFLA)策略,用于微目标检测。

基于尺度的检测

目标尺度对检测任务的准确性具有重要影响,因此也必须在DPNet设计过程中加以考虑。因此,接下来需要讨论针对尺度问题的目标检测方法。目标实例间的大尺度变化是目标检测中的一个挑战性问题。处理这一问题可以提高检测器处理不同尺度目标检测任务的能力,特别是对于极端尺寸的目标,例如微小目标。改进检测方法的一种常见策略是多尺度图像金字塔[32][33]。

基于该方案,SNIP[34]和SNIPER[35]将尺度正则化方法应用于多尺度训练,这保证了不同分辨率图像中目标的尺寸落入固定的尺度范围。另一种归一化方法TridentNet[36]构建具有不同感受野的并行多分支来生成尺度特定的特征图。这些特征图具有统一的表征能力。SSD[37]和MS-CNN[38]不使用多分辨率输入图像和感受野卷积核,而是利用多空间分辨率特征图来检测不同尺度的目标。他们将小目标分配给分辨率高的底层,将大目标分配给分辨率低的顶层。为了增强底层Low-Level特征的语义表征能力,TDM[39]和FPN[20]进一步引入自顶向下的通路和横向连接,将深层和浅层进行融合。在FPN的基础上,PANet[33]增加了一个自底向上的通路,并提出自适应特征池化来增强特征层的表征能力。

C. 动态神经网络

动态神经网络作为深度学习领域的新兴课题,具有高效性、强适应性及强大的表征能力等特点。为满足不同的计算资源需求,文献[40]、[41]、[42]、[43]通过动态网络深度进行推理,允许在浅层退出时输出"简单"样本而无需执行深层网络。文献[44]、[45]在Transformer[46]上实现停止方案,以在自然语言处理任务中达到动态网络深度。Yu等人[47]、[48]提出了可切换的批量归一化和原位蒸馏方法,用于训练可在不同宽度下运行的神经网络。根据设备端基准测试和计算资源限制,所训练的网络(命名为可缩放神经网络)能够动态调整其宽度。DS-Net[49]也是一种具有可变宽度的网络,通过学习可缩放超网络和动态门控机制,实现对不同样本的动态路由。RANet[50]在深度卷积神经网络中实现分辨率自适应学习,以高效地执行分类任务。DRNet[51]动态调整输入图像的分辨率进行分类,以实现效率与分类精度的权衡。DPNet首先将这些动态神经网络思想应用于检测任务,以实现更广泛的应用。

轻量级模型

高效的轻量级CNN模型,如MobileNet [52], [53]和ResNeXt [54],被广泛应用于目标分类任务,可作为目标检测器的 Backbone 网络。众所周知,特征提取的 Backbone 网络占据了检测器的大部分计算量,因此轻量级 Backbone 网络是高效网络的主要研究热点。MobileNet-v1 [52]采用深度可分离卷积来减少参数和计算量,同时不损失检测性能。MobileNet-v2 [53]引入了倒残差块和线性 Bottleneck 来进一步提升性能。ResNeXt [54]引入了聚合变换,通过并行堆叠具有相同拓扑结构的块来替代ResNet [55]的残差结构。这些模型通过简化网络来节省计算量,而DPNet通过动态控制输入特征图的大小来减少计算量,可以与这些轻量级模型协同工作。

3. 动态池化网络

在本节中,作者首先介绍DPNet的整体架构。接下来,作者分别详细阐述训练过程、自适应归一化模块(ANM)和下采样因子预测器(DFP)。

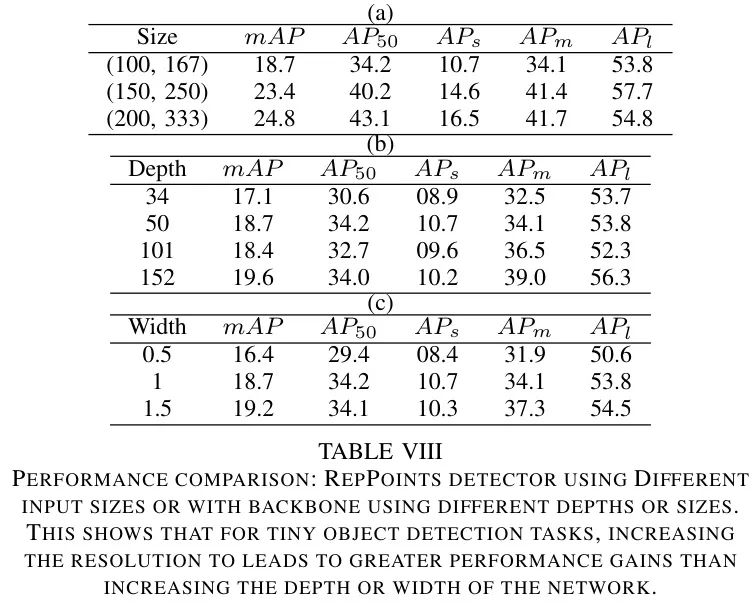

放大图像可以显著提升微小目标检测的整体性能,如表8 (a)(第 IV-E 节)所示,并在文献 [2]、[6] 中有所描述,但同时也会带来巨大的计算成本。因此,在本文中,作者选择放大后的图像作为检测器的输入,以利用放大带来的信息优势。然后,作者对检测器主干网络的特征图进行自适应下采样处理,在保留必要信息的同时减少冗余计算。

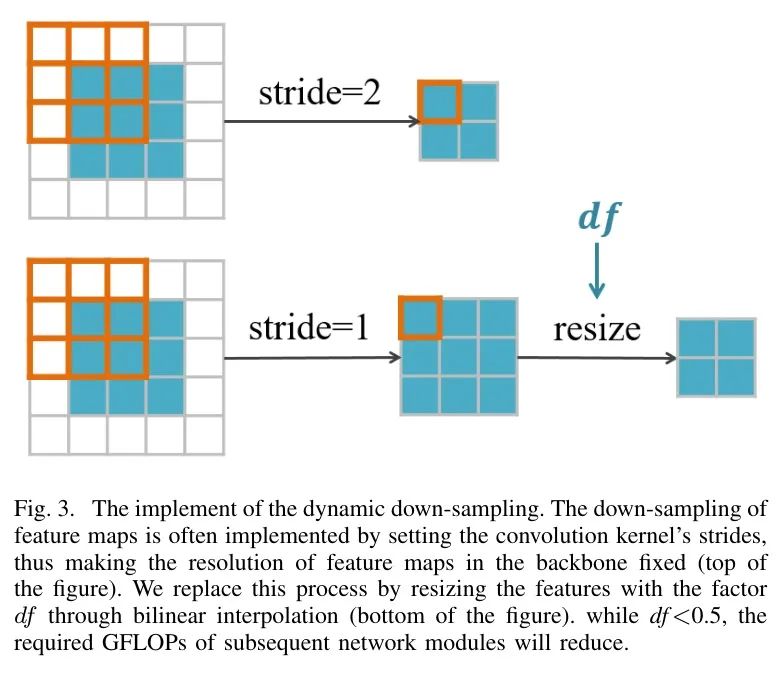

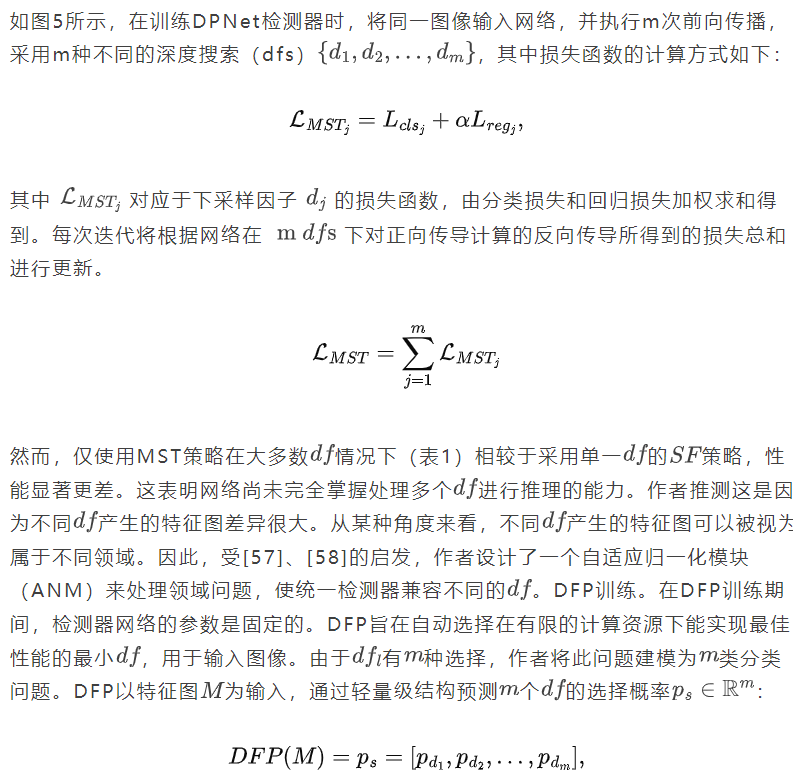

如图3 所示,传统静态网络结构中的下采样因子是固定的(df=0.5) ,通过步长为 i=2 的卷积或池化层实现。为了实现任意 df_l 的下采样,作者对具有给定下采样因子 df 的特征图进行双线性插值。由于后续网络模块的计算复杂度与输入特征图的分辨率高度相关,使用不同的 df 可以控制网络中的计算成本。

此外,不同图像中检测目标的难度和所需的最小分辨率也不同。对于某些图像(例如,内部目标尺寸微小),只有在高分辨率特征图上才能获得良好结果,因此作者使用较大的 df(例如 0.5)。相反,对于某些图像(例如,内部目标尺寸较大),在低分辨率特征图上也能获得良好性能,这意味着存在一定的计算冗余,因此作者使用较小的 df(例如 0.25)。因此,通过根据输入图像动态选择下采样因子 ,作者可以在性能和计算成本之间取得平衡。

整个工作可以分为两个任务:

-

1. 训练一个能够良好处理多个下采样因子(dfs)的检测器,这意味着它能够对所有不同的df实现高检测性能。为此,作者采用混合下采样因子训练策略(详见第三节A)并设计了一个自适应归一化模块(ANM,详见第三节B),以使统一的检测器兼容不同的df。

-

2. 选择最小的df,在有限的计算资源下,该df仍能使检测器在给定输入图像上实现强大的检测性能。为此,作者构建了一个轻量级预测器(详见第三节C),嵌入到检测器中以根据输入图像自适应选择适当的df,以降低特征图分辨率。

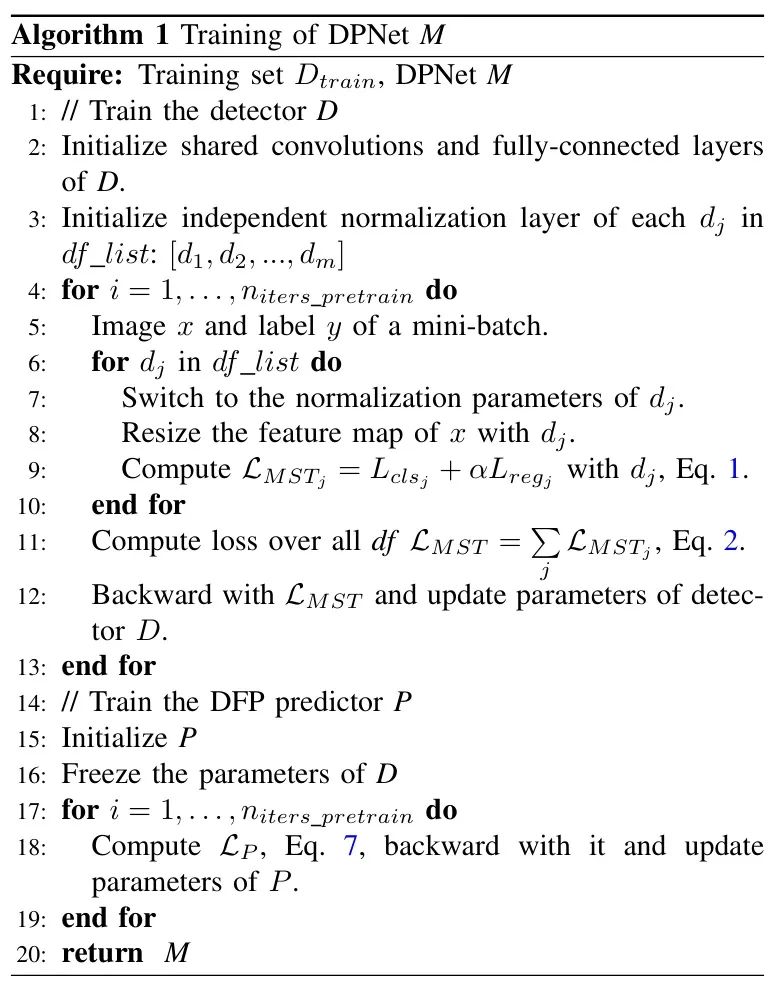

在本节中,作者将介绍训练流程。如图4所示,作者的DPNet主要由两个组件构成,即基于CNN的检测器(如RepPoints [56])和插件式DFP。为了获得更好的性能,作者逐一优化了基础检测网络和预测器,具体如算法1所示。

混合下采样因子训练 (MST)

A. DPNet 训练

B. 自适应归一化模块

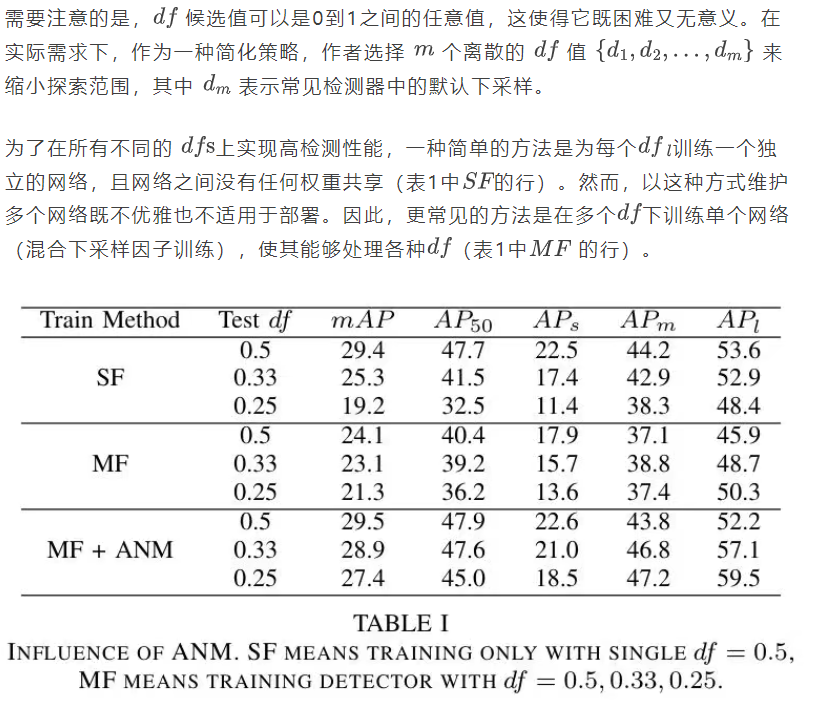

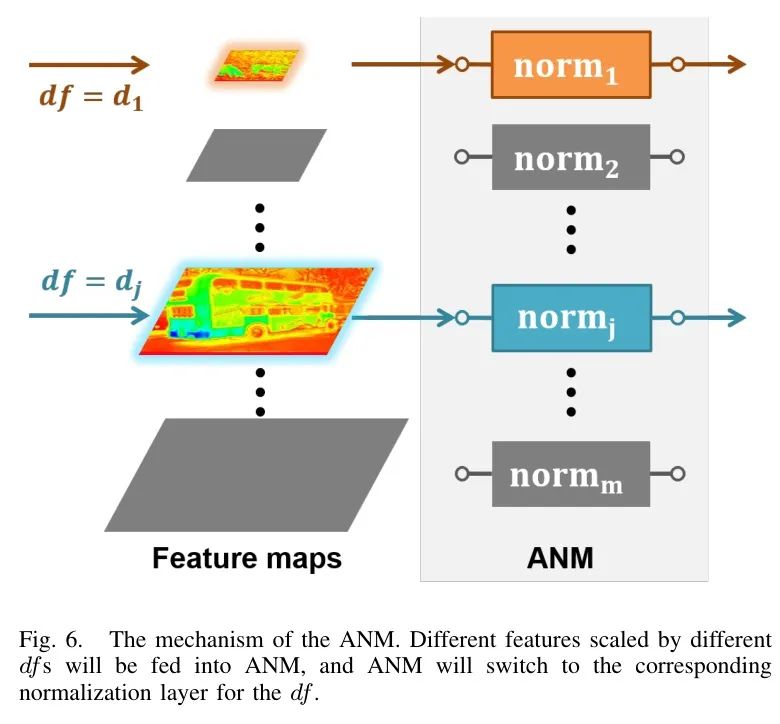

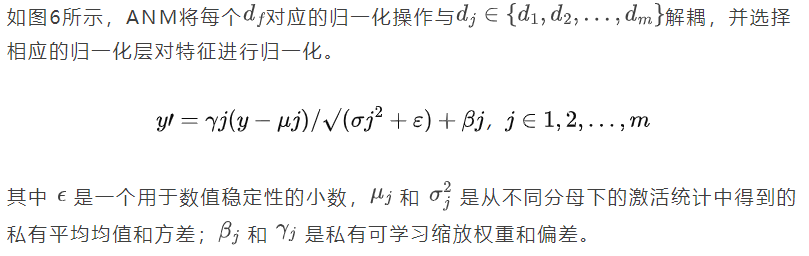

考虑到计算资源的限制,作者采用MST策略训练一个共享检测器。该检测器可以在不同的 dfs 下进行推理,使其能够适应不同设备上的推理计算负载。为了处理由不同df引入的特征图分布差异,受[57],[58]的启发,作者为不同的df设置不同的归一化层,并使用给定的df自动切换这些层,该模块命名为自适应归一化模块(ANM)。

归一化在解决深度神经网络学习中的内部协变量偏移问题中发挥着重要作用[60]。它可以编码条件信息到特征表示中[61][62]。通过重新中心化和重新缩放来归一化输入特征,它还可以加速收敛并提高稳定性[63]。

为了训练具有可变dfs的网络,ANM为联合网络中的每个交换机私有化所有归一化层。它通过在测试过程中独立归一化特征均值和方差来解决不同交换机之间特征聚合不一致的问题。ANM中的缩放和偏置可能能够编码当前交换机df配置的条件信息。此外,与增量训练相比,使用ANM作者可以联合训练不同dfs的所有交换机;因此所有权重被联合更新以实现更好的性能。

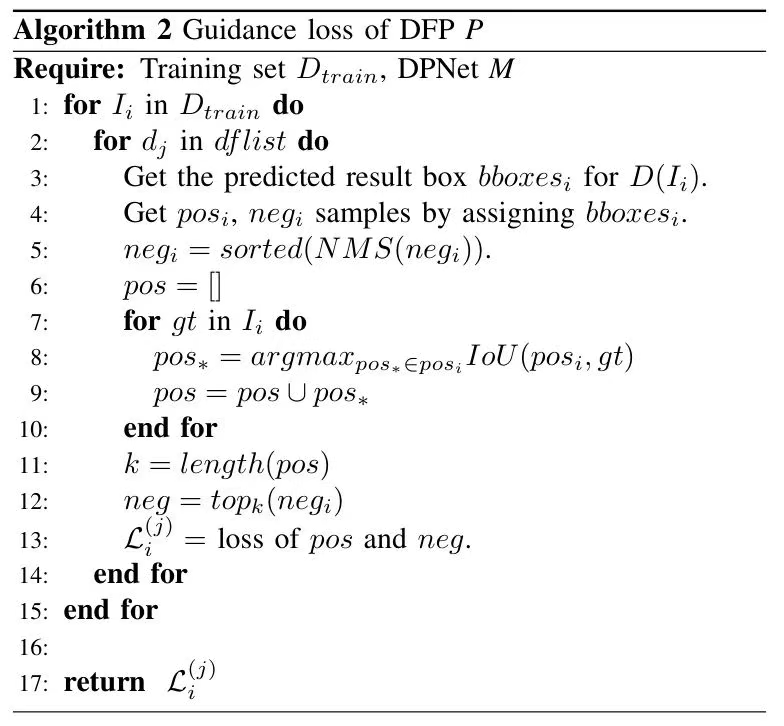

C. 下采样因子预测器

4. 实验

A. 实验设置

数据集。TinyCOCO数据集(MS-COCO 2017)[24]是用于评估微小目标检测任务检测性能的广泛使用的基准,包含118k张训练图像、5k张验证图像和20k张测试图像,分为80个类别。所有研究均在验证集上进行。TinyCOCO是COCO100 [1]的变体,将每张图像的较短边调整为100,同时保持高宽比不变。TinyCOCO中目标尺寸的平均值与[1]中对微小目标的定义相同。TinyPerson是一个常用的微小目标检测数据集,专门设计用于无人机航拍场景。该数据集从高质量的无人机视频和在线图像中收集,包含72,651个低视觉分辨率的标注人体目标,总共25,945张图像裁剪为640x512的大小,旨在验证模型在基于无人机的目标识别任务中的适用性。

B. 消融研究

C. 性能比较

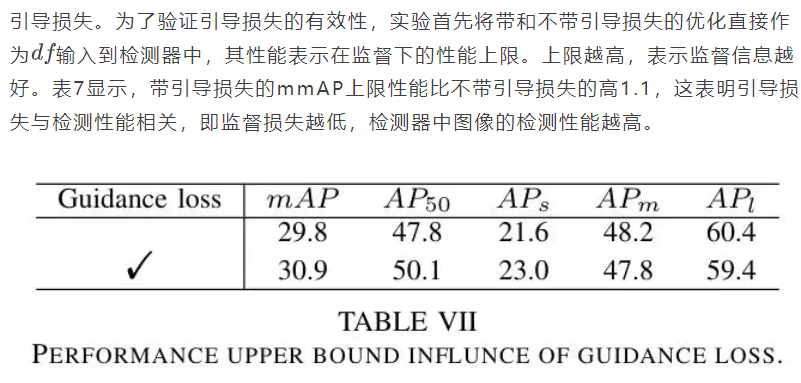

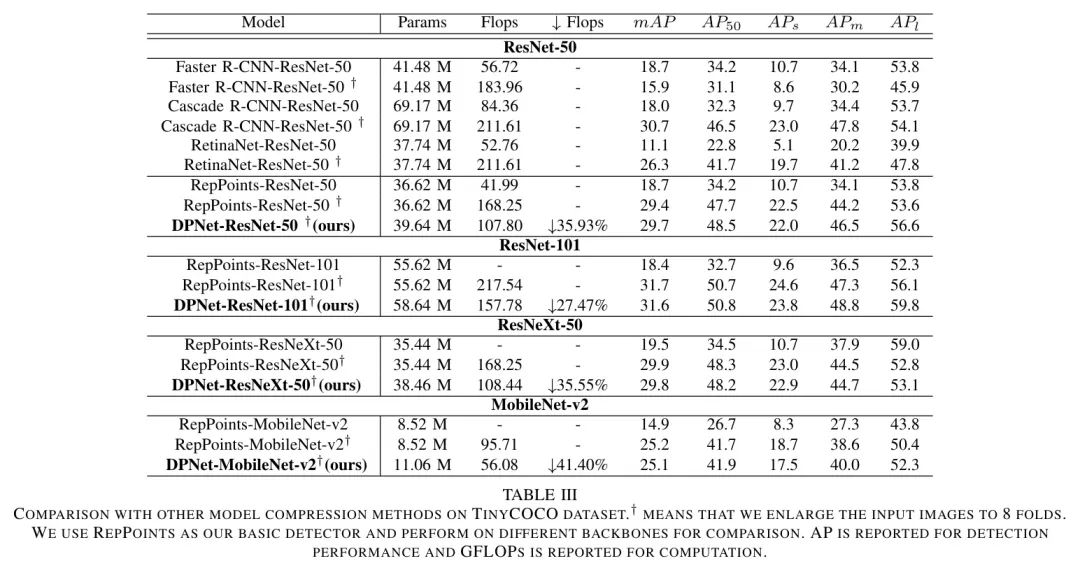

作者在TinyCOCO数据集上对比了之前的网络与作者的DPNet。如表3所示,作者对比了不同 Backbone 网络,特别是像ResNeXt和MobileNet等轻量级网络。这些对比验证了DPNet并非轻量级模型的替代品,而是与这些模型结合以节省计算量。轻量级模型主要通过减少模型结构的复杂度来节省计算量。DPNet从另一个方面减少计算量:自适应调整输入大小。 Baseline 表示性能基于TinyCOCO(COCO100),而放大性能是在输入重置为800时进行的,这带来了性能提升。这表明放大图像可以提高检测性能,特别是对于微小物体。第三行的性能代表DPNet,其中图像被放大(重置为800),并使用动态下采样进行检测。作者的基本 Backbone 网络是ResNet50,该方法性能为mAP 29.7。作者使用更大的ResNet-101来验证方法的稳定性,结果表明DPNet能有效减少计算量。

与此同时,作者在TinyPerson数据集上进一步将DPNet与当前最先进的方法进行了基准测试,该数据集是微目标检测任务中流行的数据集。作者增加了另外三种微目标检测任务中的代表性方法,即RetinaNet-S- alpha 和RetinaNet-SM。

C. 性能比较

作者在TinyCOCO数据集上对比了之前的网络与作者的DPNet。如表3所示,作者对比了不同 Backbone 网络,特别是像ResNeXt和MobileNet等轻量级网络。这些对比验证了DPNet并非轻量级模型的替代品,而是与这些模型结合以节省计算量。轻量级模型主要通过减少模型结构的复杂度来节省计算量。DPNet从另一个方面减少计算量:自适应调整输入大小。 Baseline 表示性能基于TinyCOCO(COCO100),而放大性能是在输入重置为800时进行的,这带来了性能提升。这表明放大图像可以提高检测性能,特别是对于微小物体。第三行的性能代表DPNet,其中图像被放大(重置为800),并使用动态下采样进行检测。作者的基本 Backbone 网络是ResNet50,该方法性能为mAP 29.7。作者使用更大的ResNet-101来验证方法的稳定性,结果表明DPNet能有效减少计算量。

与此同时,作者在TinyPerson数据集上进一步将DPNet与当前最先进的方法进行了基准测试,该数据集是微目标检测任务中流行的数据集。作者增加了另外三种微目标检测任务中的代表性方法,即RetinaNet-S- 和RetinaNet-SM。

D. 可视化

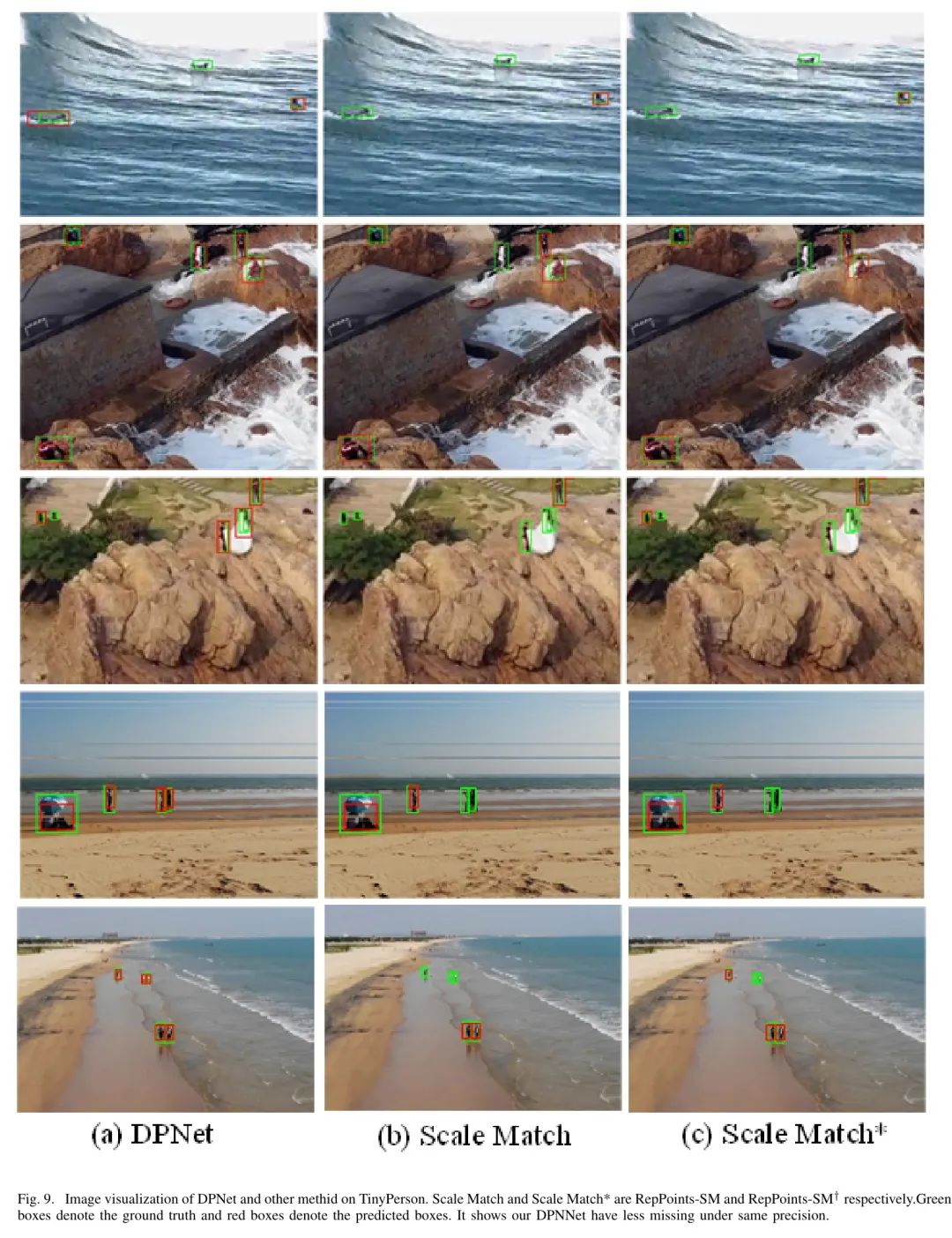

DFP的预测结果在图8中进行了可视化。占据图像大部分区域且尺寸较大或前景明显的七个图像被预测为0.25 df。中间七个图像中,物体较小或轻微模糊,被预测为0.33 df。底部七个图像具有非常小的物体,其隐藏的前景几乎与背景融合;因此选择了最大的df。尽管“简单”和“困难”的示例对人类和机器可能有所不同,但这些结果与人类感知系统相兼容。如图9所示,作者在TinyPerson数据集(一个真实场景)上,使用调整大小(放大)的输入,对DPNet、小物体域方法Scale Match以及Scale Match*的可视化结果进行了比较。结果表明,在相同的精度下,DPNet的漏检数量更少。

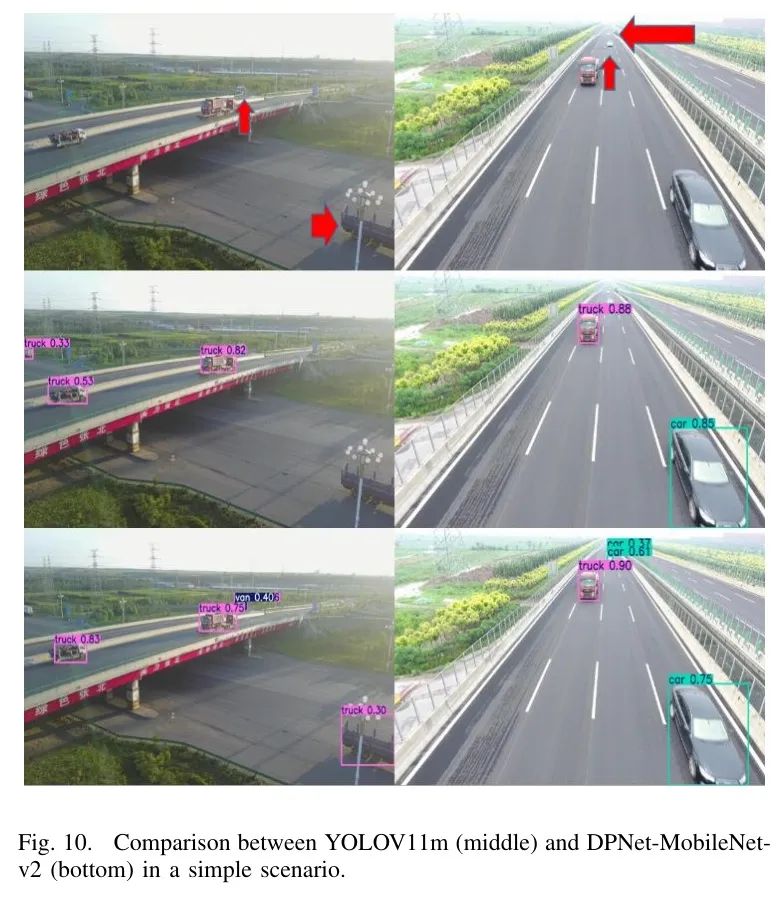

作者展示了DPNet在低计算场景下进行小目标检测的可视化结果,并证明了其相较于 Baseline YOLOv11m模型的优势。所有图像均来自VisDrone数据集的测试集。在目标较少的场景中,特别是对于简单且常见的小目标,作者依次比较了原始图像、YOLOv11m检测结果以及DPNet-MobileNet-v2检测结果,如图10所示。

左侧,YOLOvl1m未能检测到右下角的卡车,而DPNet-MobileNet-v2成功识别。中间,YOLOv11m错过的极小目标被DPNet检测。右侧,上中部附近的两辆微型汽车目标被YOLOv11m遗漏,但被DPNet-MobileNet-v2准确检测,同时捕捉到类别和位置。

可视化结果清晰地展示了DPNet的优越性能。与 Baseline 方法相比,DPNet在一般目标检测中表现出更高的准确率,且误报率更低。对于飞机,DPNet提供了更紧凑的边界框。同时,它在检测船舶和建筑物方面也表现出色,提供了更精确且位置正确的边界框。总体而言,DPNet在各种目标类型上实现了更高的准确率和精确度,突显了其相较于 Baseline 方法的有效性。

E. 分析

为什么是下采样因子?动态神经网络的构建方式有很多种,例如动态网络深度、宽度、参数或特征图比例。作者通过一系列实验来简单分析哪个因素对检测任务更为重要。表8 显示,当网络深度和宽度发生变化时,检测器的性能在一个狭窄的范围内波动,而调整输入图像的大小,性能将显著提高。这也是作者关注动态下采样的原因。

5. 结论

本文对扩大输入图像以检测微小物体的优势进行了视觉分析。此外,作者提出了一种新的DPNet,用于自适应地选择特征图中最合适的df。ANM旨在通过将联合网络中每个df切换的所有归一化层私有化来解决不同df切换之间特征聚合不一致的问题。引导损失通过根据图像中每个实例的大小重新调整其损失权重的方式,更好地优化 Backbone 网络中每个df下的检测器性能。

DPNet中的DFP预测df的概率分布,有助于为每张图像选择性能充分且成本高效的df。因此,它可以显著降低计算成本,并增强无人机系统中的应用识别。作为首个适用于检测任务的动态神经网络,DPNet可以为该领域的更多研究行人提供启发。

参考

[1]. DPNet: Dynamic Pooling Network for Tiny Object Detection

THE END !

文章结束,感谢阅读。您的点赞,收藏,评论是我继续更新的动力。大家有推荐的公众号可以评论区留言,共同学习,一起进步。

1366

1366

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?