摘要

卷积神经网络(CNN)是深度学习领域中一种重要的神经网络架构,广泛应用于图像识别、视频处理、自然语言处理等领域。本文将详细介绍CNN的基本概念、架构设计、训练过程、应用场景以及开发中需要注意的问题。通过理论讲解、代码示例和实际应用案例,帮助读者全面掌握CNN的核心技术和实践方法。

一、卷积神经网络的概念讲解

(一)定义

卷积神经网络(CNN)是一种深度神经网络架构,主要用于处理具有网格结构的数据,如图像和视频。CNN通过卷积层(Convolutional Layer)、池化层(Pooling Layer)和全连接层(Fully Connected Layer)等结构,能够自动提取数据的特征,并进行分类或回归任务。

(二)核心概念

-

卷积层(Convolutional Layer)

-

卷积层是CNN的核心部分,通过卷积核(Filter)对输入数据进行卷积操作,提取局部特征。

-

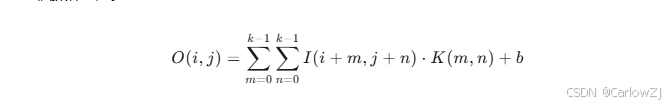

卷积操作公式:

其中,I 是输入矩阵,K 是卷积核,b 是偏置项。

-

-

池化层(Pooling Layer)

-

池化层用于降低特征图的空间维度,减少计算量,同时保留重要特征。

-

常见的池化方法包括最大池化(Max Pooling)和平均池化(Average Pooling)。

-

-

全连接层(Fully Connected Layer)

-

全连接层将卷积层和池化层提取的特征进行分类或回归。

-

全连接层的每个神经元都与前一层的所有神经元相连。

-

(三)CNN的优势

-

自动特征提取:CNN能够自动从原始数据中提取特征,无需人工设计特征。

-

局部感知能力:卷积层通过卷积核捕捉局部特征,适合处理具有局部相关性的数据。

-

参数共享:卷积核在输入数据上滑动时,参数共享减少了模型的复杂度。

二、CNN的架构设计

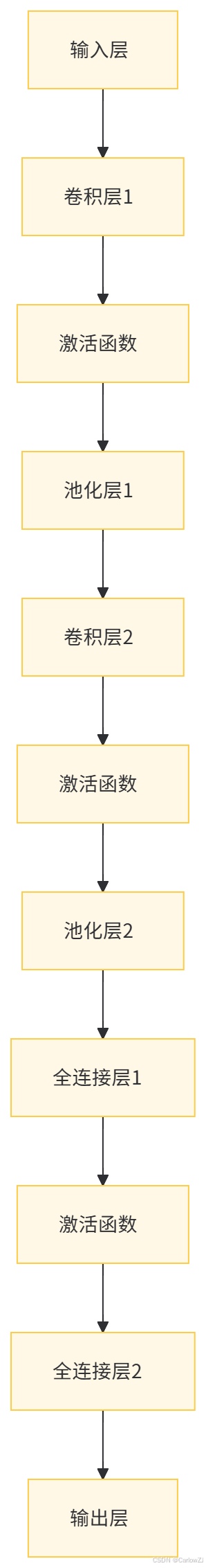

(一)架构图

(二)各层的作用

-

输入层:接收原始数据,如图像。

-

卷积层:提取局部特征。

-

激活函数:引入非线性,常用的激活函数包括ReLU、Sigmoid等。

-

池化层:降低特征图的维度,保留重要特征。

-

全连接层:将提取的特征进行分类或回归。

三、CNN的训练过程

(一)前向传播

-

输入数据通过卷积层、激活函数、池化层和全连接层,最终得到输出结果。

-

前向传播公式:

O=σ(W⋅X+b)其中,W 是权重,X 是输入,b 是偏置,σ 是激活函数。

(二)损失函数

-

损失函数用于衡量模型的预测结果与真实标签之间的差异。

-

常见的损失函数包括交叉熵损失(Cross-Entropy Loss)和均方误差损失(Mean Squared Error Loss)。

(三)反向传播

-

通过计算损失函数对每个参数的梯度,更新网络的权重和偏置。

-

反向传播公式:

∂W∂L=∂O∂L⋅∂W∂O

(四)优化算法

-

常用的优化算法包括SGD(随机梯度下降)、Adam等。

四、CNN的代码示例

(一)使用TensorFlow实现CNN

import tensorflow as tf

from tensorflow.keras import layers, models

# 构建CNN模型

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 打印模型结构

model.summary()

(二)训练CNN模型

# 加载数据集

(train_images, train_labels), (test_images, test_labels) = tf.keras.datasets.mnist.load_data()

# 数据预处理

train_images = train_images.reshape((60000, 28, 28, 1)).astype('float32') / 255

test_images = test_images.reshape((10000, 28, 28, 1)).astype('float32') / 255

# 训练模型

model.fit(train_images, train_labels, epochs=5, batch_size=64)

# 评估模型

test_loss, test_acc = model.evaluate(test_images, test_labels)

print(f'Test accuracy: {test_acc}')

五、CNN的应用场景

(一)图像识别

CNN在图像分类、目标检测和图像分割等领域表现出色。例如,AlexNet、VGGNet、ResNet等经典CNN架构在ImageNet竞赛中取得了优异的成绩。

(二)视频处理

CNN可以用于视频分类、动作识别等任务。通过将视频帧作为输入,CNN能够提取视频中的时空特征。

(三)自然语言处理

CNN也可以应用于自然语言处理任务,如文本分类和情感分析。通过将文本嵌入为矩阵,CNN能够提取文本的局部特征。

(四)医学图像分析

CNN在医学图像分析中具有重要应用,如CT图像分析、MRI图像分割等,能够辅助医生进行疾病诊断。

六、CNN开发的注意事项

(一)数据预处理

-

数据归一化:将输入数据归一化到[0, 1]或[-1, 1]范围内。

-

数据增强:通过旋转、裁剪、翻转等操作扩充训练数据。

(二)网络设计

-

合理选择卷积核大小和数量。

-

使用批量归一化(Batch Normalization)加速训练过程。

(三)过拟合问题

-

使用Dropout技术防止过拟合。

-

使用正则化方法(如L2正则化)约束模型复杂度。

(四)性能优化

-

使用GPU加速训练过程。

-

优化网络结构,减少计算量。

七、总结

卷积神经网络(CNN)是深度学习中一种非常重要的神经网络架构,广泛应用于图像识别、视频处理和自然语言处理等领域。通过本文的介绍,读者可以全面了解CNN的基本概念、架构设计、训练过程、应用场景以及开发中需要注意的问题。希望本文能够为读者提供有价值的参考,帮助读者更好地理解和应用CNN。

1199

1199

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?