目录

假设 model_output_probabilities 是模型输出的概率分布列表(按概率从高到低排序)

假设 model_output_probabilities 是模型输出的概率分布列表

根据调整后的概率分布进行采样(可结合其他采样方法如 Top - k 或 Top - p)

摘要

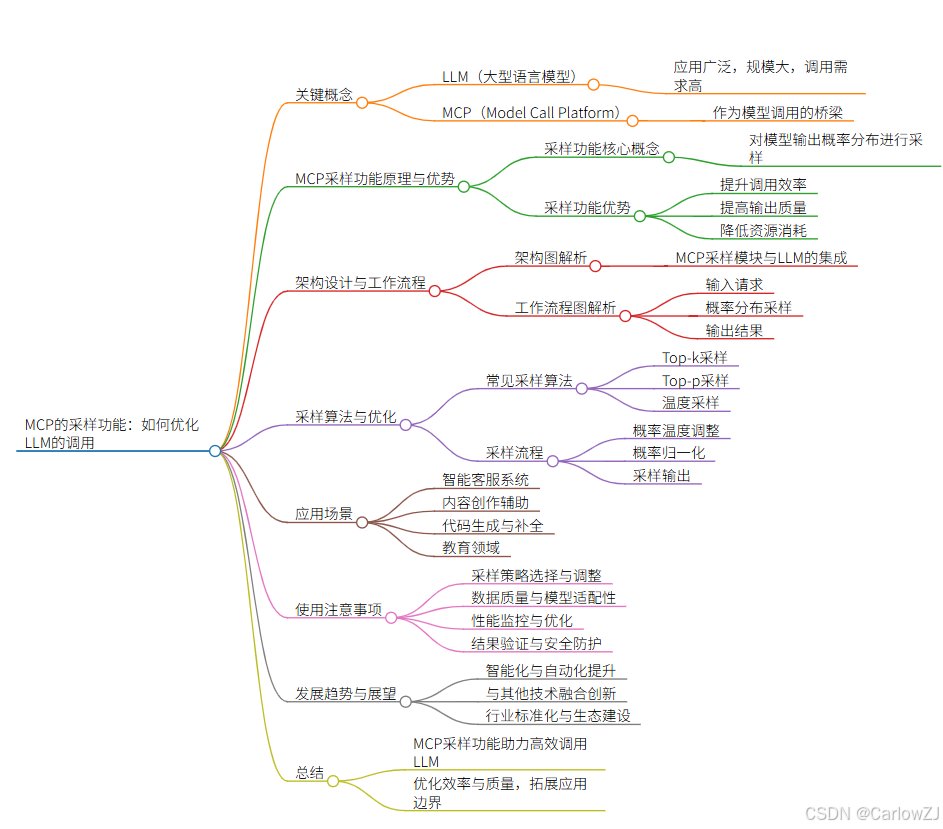

在当今人工智能快速发展的时代,大型语言模型(LLM)正以前所未有的速度改变着我们的生活与工作,其应用场景遍布各个领域。然而,随着模型规模的不断扩大和应用场景的日益复杂,如何高效、精准地调用LLM成为了一个亟待解决的问题。本文将聚焦于MCP(Model Call Platform)的采样功能,深入探讨其如何优化LLM的调用过程,提升效率与质量。文章内容涵盖概念讲解、代码示例、应用场景、注意事项等多个方面,辅以精心绘制的图片、架构图和流程图,力求为读者呈现一个全面、清晰且实用的知识体系,助力大家在实际项目中更好地运用这一关键技术。

订阅专栏 解锁全文

订阅专栏 解锁全文

1067

1067

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?