前言

在之前的一篇中,我们谈到在flink中如何读取来自kafka指定topic的数据,在实际生产环境中,比较常见的场景是,kafka作为数据源,flink程序读取到kafka的数据后,进行初步的处理后,再将数据会写到kafka的另一个topic中,供后面的应用读取使用

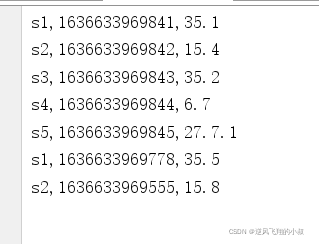

本例模拟从外部文件中读取数据,然后写入到kafka的指定topic中

环境准备

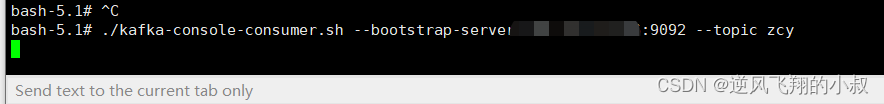

启动kafka服务,并通过控制台启动kafka指定topic的消费端窗口,这里我们还是使用之前那个 "zcy"的topic,使用下面的命令启动消费端窗口

./kafka-console-consumer.sh --bootstrap-server IP:9092 --topic zcy

我们仍然读取下面的文件数据

核心代码编写

本文介绍如何在Flink中读取外部文件数据,经过处理后写入到Kafka的特定topic。首先启动Kafka服务和消费者端,接着演示读取文件并写入到Kafka的代码实现,最终验证数据成功写入。

本文介绍如何在Flink中读取外部文件数据,经过处理后写入到Kafka的特定topic。首先启动Kafka服务和消费者端,接着演示读取文件并写入到Kafka的代码实现,最终验证数据成功写入。

订阅专栏 解锁全文

订阅专栏 解锁全文

1065

1065

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?