前言

由于毕设是要对股票的新闻报道进行情感分析,所以爬取所有股票的个股资是必要的前提工作了。一开始准备直接在

[东方财富网](http://quote.eastmoney.com/stocklist.html)上爬取所有的个股资讯,但是在获得个股资讯列表的时候要模拟事件。

前提工作

1. 安装python3

([下载地址](https://www.python.org/downloads/)),在安装的时候选择添加到环境变量,如果没有选择,可以通过【右键我的电脑】->【属性】->【高级系统设置】->【环境变量】->【path】将安装的Python3的路径添加到path中。

2. 通过命令行安装requests库:

>pip install requests

3.安装 lxml

>pip install lxml

4.安装pyquery

>pip install pyquery

使用详情见[静觅](https://cuiqingcai.com/) » [Python爬虫利器六之PyQuery的用法](https://cuiqingcai.com/2636.html)

5.安装pymysql

前提是先安装好mysql,然后同样采用

>pip install pymysql

爬取数据

1. 爬取所有股票代码

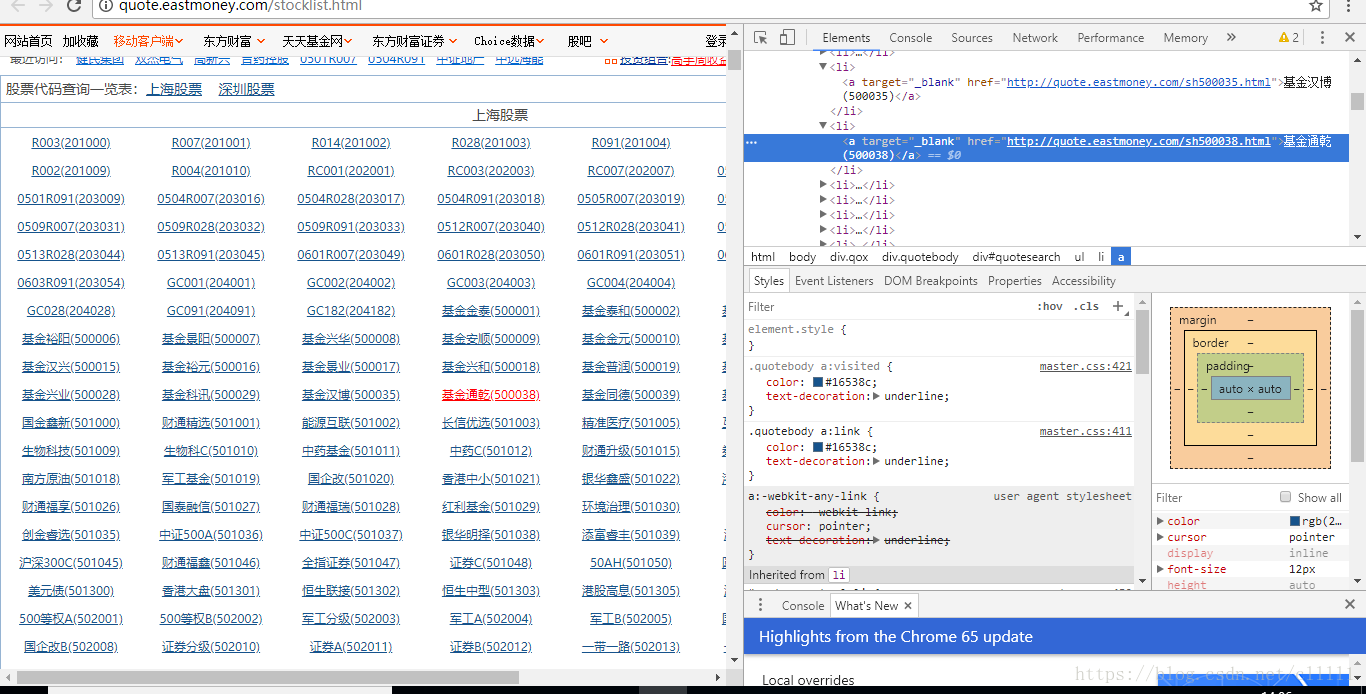

url为东方财富网的股票代码查询一览表(http://quote.eastmoney.com/stocklist.html)。这是一个静态的网页,爬取比较简单.

分析网页的结果,由图片可知,股票代码为target为_blank的a标签的文本括号中的文字,股票名称为括号前的文字。因此对获得的text利用split函数进行处理得到股票代码和股票名称。

de

本文介绍了如何使用Python爬虫获取所有股票的新闻报道,包括安装必要的库、爬取股票代码、处理网页编码问题以及将数据插入数据库的步骤。

本文介绍了如何使用Python爬虫获取所有股票的新闻报道,包括安装必要的库、爬取股票代码、处理网页编码问题以及将数据插入数据库的步骤。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

925

925

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?