最近研究GPT,深入的从transfomer的原理和代码看来一下,现在把学习的资料和自己的理解整理一下。

- 这个文章写的很通俗易懂,把transformer的来龙去脉,还举例了很多不错的例子。

Transformer通俗笔记:从Word2Vec、Seq2Seq逐步理解到GPT、BERT_v_JULY_v的博客-优快云博客

- 有了原理还需要进行代码实践,这篇文章从0开始讲解了一个简易的Transformer版本和真实版本的代码注释,值得详细读一下。

从零实现Transformer的简易版与强大版:从300多行到3000多行_写transformer-优快云博客

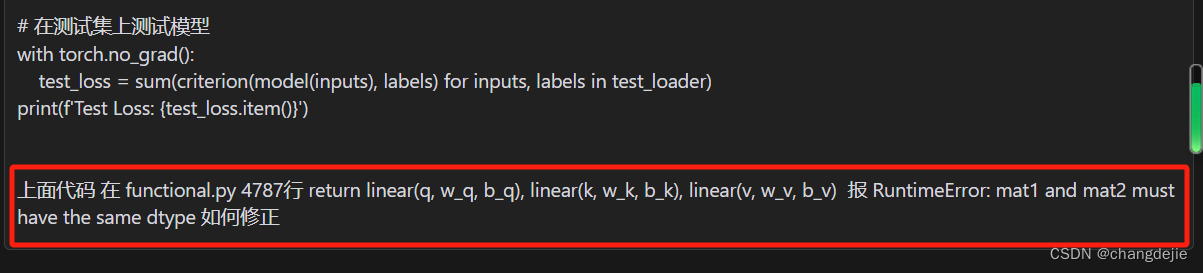

- 另外,给大家推荐一下自己动手写代码实践一下,代码模块可以丢给文心一言,GPT4,这些写代码的能力相当的不错,甚至运行出了问题,直接把问题输入给它,还能自己改正。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?