这两个月来,国产 AI 的发展势头可以用四个字概括:势如破竹。

上个月,智谱开源的GLM-4.1V-Thinking一炮而红,直接冲上HuggingFace趋势榜榜首,下载量迅速突破13万次。

上周,又推出了旗舰多模态模型 GLM-4.5 和轻量版 GLM-4.5-Air,技术圈瞬间沸腾。

这周,智谱再次扔下“核弹”——基于 GLM-4.5-Air 架构,训练出更强大的视觉推理模型 GLM-4.5V,并且毫不犹豫地 全量开源。

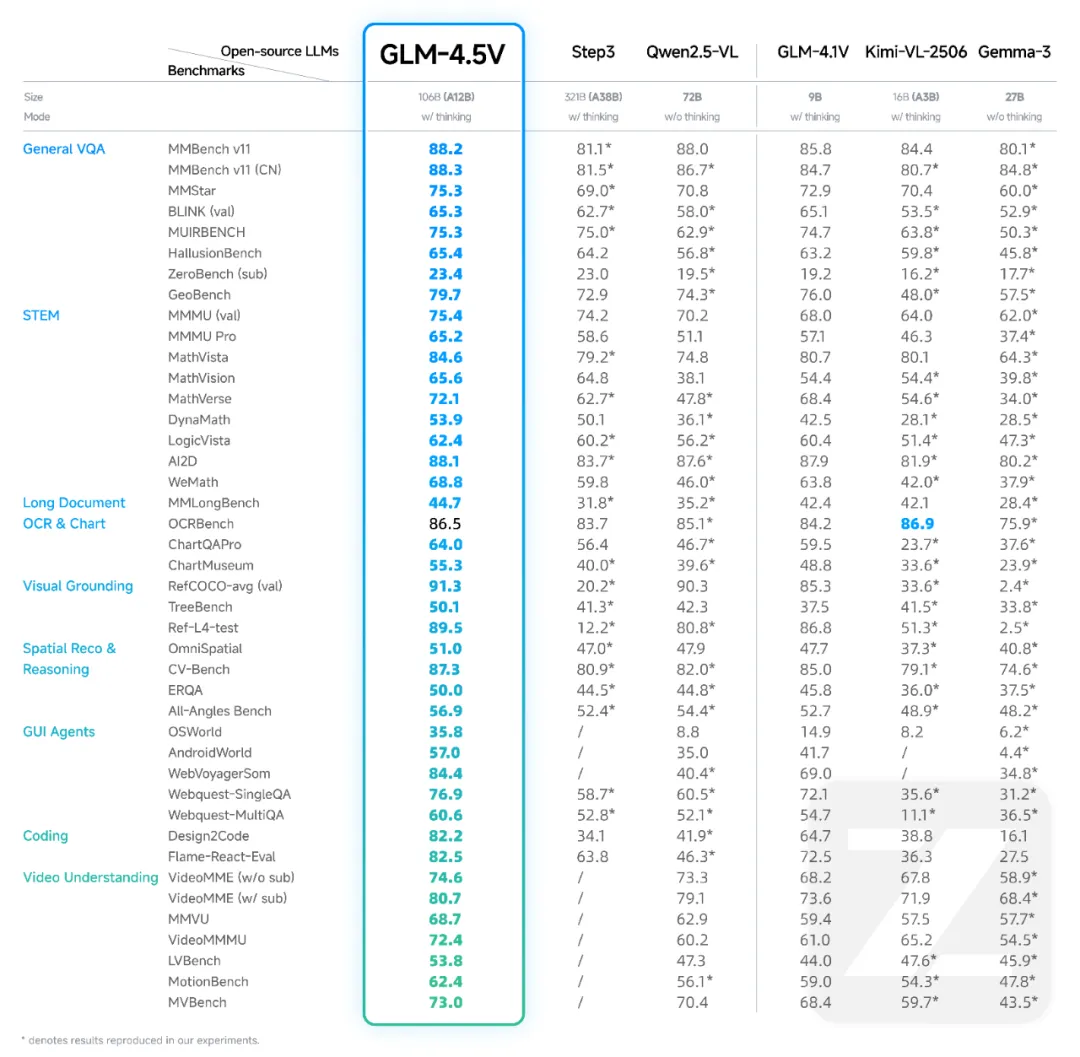

更夸张的是,在 42 个权威多模态榜单 中,GLM-4.5V 拿下了 41 项 SOTA(全球最佳)。 一句话:在开源视觉推理领域,它几乎是无敌的存在。

01 GLM-4.5V 究竟强在哪?

如果说普通的视觉模型只是“看得清”,那 GLM-4.5V 则是“看得懂、想得通、还会自己动手”。

它的三个核心能力,让它不只是个识图工具,而更像一个拥有视觉和常识的大脑:

① 多模态融合推理

能同时理解图像、文字、视频等多种信息,并在一个上下文中推理,这意味着它不仅能识别图片,还能结合文字背景得出更准确的结论。

类比一下,这就像一个工程师看图纸时,不仅看到了线条,还理解了设计目的,并能立即判断可行性。

② 长上下文记忆

可以连续处理数十张图片、几分钟视频或长文档,并保持逻辑一致,不会出现“前一句和后一句不沾边”的问题。 这对长流程的任务(比如视频内容分析、长文档解析)非常关键。

③ Grounding 精准定位

不只是说“这是一个猫”,而是能告诉你它在画面中的精确坐标,甚至能直接生成可用的标注文件,让 AI 从“感知”走向“可操作”。

02 模型规格:真正的 100B 级视觉推理猛兽

-

总参数:106B

-

激活参数:12B

-

输入类型:图像 / 文本 / 视频

📂 GitHub:https://github.com/zai-org/GLM-V📂 Hugging Face:https://huggingface.co/zai-org/GLM-4.5V

03 能力覆盖面有多广?

-

图像推理:场景理解、多图分析、位置识别

-

视频理解:长视频分镜、事件识别

-

GUI 任务:前端页面复刻、桌面操作辅助

-

图表与文档解析:结构化提取、自动标注

-

Grounding 定位:精准框选视觉元素

简单来说,它既能帮你看懂一份复杂的财报图表,也能复刻一个网页 UI,甚至能像人类助手一样操作电脑界面。

04 桌面助手:多模态能力落地的“利器”

为了让开发者更快上手,智谱还同步开源了 GLM-4.5V 桌面助手,支持:

-

实时截屏并分析

-

获取屏幕信息

-

基于视觉推理执行自动化任务

写在最后

从 GLM-4.1V-Thinking 到 GLM-4.5V,智谱用一波接一波的开源操作证明: 国产大模型,不只是能打,还能 打到世界第一。

未来的多模态 AI 或将超越单纯的“工具”角色,成为能够理解、推理与协作的数字伙伴。 它们正在用另一种方式,重塑我们的工作和生活。

推荐阅读:

从零开始打造AI测试平台:文档解析与知识库构建详解

Qwen3-32B国产大模型本地应用实战:LangChain + vLLM 打造企业级智能体核心引擎

AI术语详解:从新手到专家的43个核心概念指南

2025大模型平台选择指南:从个人助手到企业智能体,解读五大场景

精选文章:

MCP、LLM与Agent:企业AI实施的新基建设计方案

2025大语言模型部署实战指南:从个人开发到企业落地全栈解决方案

10分钟无痛部署!字节Coze开源版喂饭教程

学社精选:

- 测试开发之路 大厂面试总结 - 霍格沃兹测试开发学社 - 爱测-测试人社区

- 【面试】分享一个面试题总结,来置个顶 - 霍格沃兹测试学院校内交流 - 爱测-测试人社区

- 测试人生 | 从外包菜鸟到测试开发,薪资一年翻三倍,连自己都不敢信!(附面试真题与答案) - 测试开发 - 爱测-测试人社区

- 人工智能与自动化测试结合实战-探索人工智能在测试领域中的应用

- 爱测智能化测试平台

- 自动化测试平台

- 精准测试平台

- AI测试开发企业技术咨询服务

技术平台与工具

自研工具与开放资源

人工智能测试开发学习专区

- 人工智能/AI/为什么测试工程师需要掌握AI_哔哩哔哩_bilibili

- 人工智能在音频、视觉、多模态领域的应用_哔哩哔哩_bilibili

- 从0到1打造AI工作流:测试用例/测试架构图/测试报告/简历/PPT全自动生成

929

929

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?