网络资讯

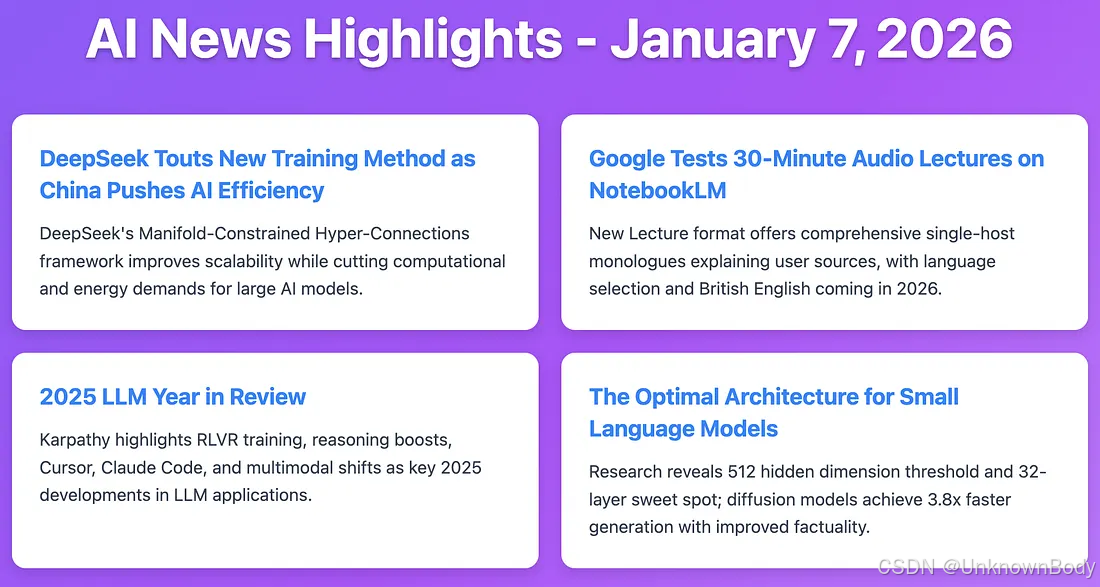

深度求索提出全新训练方法,助力中国人工智能能效提升 深度求索发布一篇关于流形约束超连接(Manifold-Constrained Hyper-Connections) 的论文,该训练框架可提升大型人工智能模型的可扩展性,同时降低算力与能耗需求。研究团队基于字节跳动2024年的技术成果,对参数量从30亿到270亿不等的模型展开测试。此项研究先于深度求索备受期待的R2模型问世,分析人士指出,即便面临美国的芯片限制,该模型仍有望再度颠覆全球人工智能领域格局。

谷歌在NotebookLM平台测试30分钟音频课程功能 谷歌正在其NotebookLM平台测试一项名为“课程”的音频概述新功能,该功能以30分钟单人独白的形式,对用户上传的资料内容进行阐释与串联。NotebookLM还为这类音频课程提供了语言选择功能,并计划于2026年推出英式英语旁白选项,目标用户群体为需要通过音频形式梳理晦涩文档的学生、研究人员及专业人士。

网络指南

2025年大语言模型年度回顾 安德里杰·卡帕西发布的2025年度回顾报告指出,基于验证奖励的强化学习(RLVR) 已成为大语言模型训练的全新核心环节,它借助可验证的奖励机制提升模型的推理能力,将算力投入从预训练阶段转移至长期的强化学习训练

订阅专栏 解锁全文

订阅专栏 解锁全文

637

637

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?