文章主要内容和创新点

主要内容

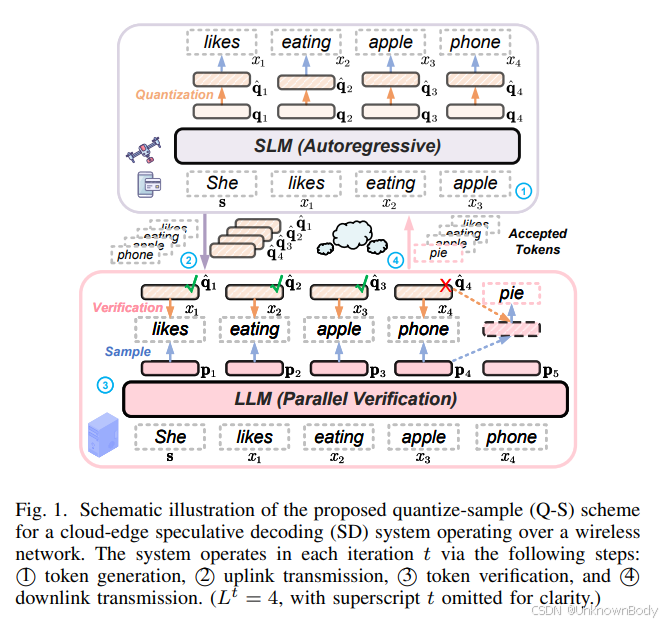

本文聚焦于边缘-云协作的大语言模型(LLM)推测解码(SD)系统,旨在解决边缘设备与云端之间通信带宽有限及动态信道条件下的解码效率问题。该系统通过边缘的小语言模型(SLM)生成草稿token,由云端的LLM并行验证,以提升token生成吞吐量。文章提出了“量化-采样-验证(Quantize-Sample-and-Verify)”策略,通过先量化SLM的概率分布再采样token的方式,确保边缘-云系统输出分布与LLM一致;同时构建了吞吐量模型,结合强化学习设计动态资源分配机制,根据语义不确定性和信道条件自适应调整草稿长度和量化精度,最终通过仿真验证了该方法在吞吐量和输出一致性上的优势。

创新点

- 量化-采样(Q-S)策略:与现有“采样-量化(S-Q)”策略不同,Q-S先对SLM生成的概率分布进行量化,再从量化后的分布中采样token,可证明地保持与LLM的输出分布一致,解决了现有方法输出分布偏移或通信过载的问题。

- 基于格的量化方法:采用基于格的量化算法,将概率向量压缩到V维概率单纯形的离散子集,比均匀量化更高效,且量化复杂度低(O(V log V))。

- 动态吞吐量优化机制:明确建模边缘-云通信延迟(包括上行和下行传输

订阅专栏 解锁全文

订阅专栏 解锁全文

2440

2440

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?