文章主要内容

本文聚焦于多模态大语言模型(MLLMs)在周期性任务中的性能提升,针对现有模型在时间建模和长短周期冲突方面的不足,提出了Period-LLM模型。该模型采用“由易到难”的训练范式,先从文本任务起步,逐步过渡到视觉和多模态任务,同时引入“抵抗逻辑遗忘”(RLO)优化策略,以在语义对齐过程中保留周期性推理能力。实验结果表明,Period-LLM在动作计数、生理信号估计等周期性任务上显著优于现有MLLMs。

文章创新点

- 首个多模态周期性模型:提出基于MLLM的Period-LLM,构建涵盖文本、视频等多模态的周期性任务基准。

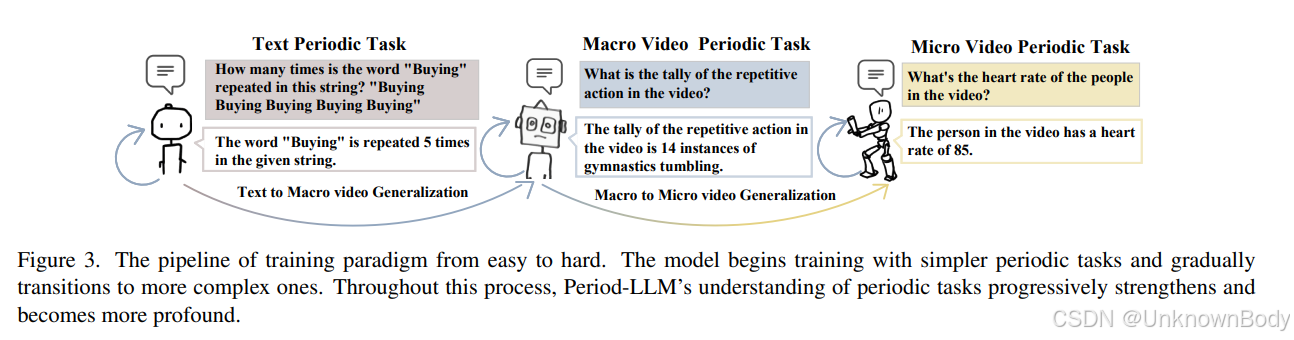

- 由易到难训练范式:从简单文本任务逐步过渡到复杂多模态任务,助力模型分阶段习得跨模态周期性感知能力。

- 抵抗逻辑遗忘策略(RLO):通过动态调整梯度更新权重,平衡周期性推理与语义对齐,避免模型遗忘已学逻辑。

- 跨模态性能优势:在Countix-QA、rPPG-QA等多模态数据集上,Period-LLM的MAE等指标显著优于Video-LLaMA等基线模型。

摘要(Abstract)

周期性或准周期性现象揭示了各种自然过程

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?