文章主要内容总结

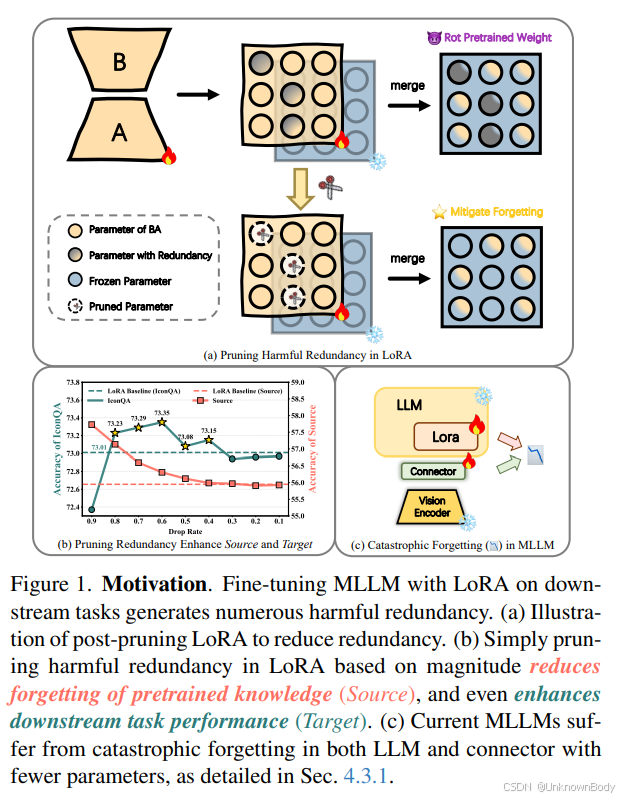

本文提出了LoRASculpt框架,旨在解决多模态大语言模型(MLLMs)在微调过程中出现的灾难性遗忘问题。传统的低秩适应(LoRA)方法在注入下游任务知识时会引入大量冗余参数,导致模型同时损害通用知识和特定任务性能。LoRASculpt通过以下两个核心创新点实现知识协调:

-

稀疏化LoRA以减少冗余

- 在LoRA训练中引入稀疏更新,通过理论证明低秩矩阵乘积的稀疏性,并提出动态剪枝策略去除冗余参数。

- 实验表明,即使在极高稀疏度(≤5%)下,模型仍能保持性能。

-

正则化LoRA以缓解知识冲突

- 提出冲突缓解正则化器,利用预训练模型的参数重要性(基于参数幅度)引导LoRA更新方向,避免干扰关键通用知识。

- 理论分析和实验验证了该方法对优化轨迹的校准作用。

此外,论文还针对MLLMs中的连接器模块提出了适应性调整,通过软稀疏正则化进一步提升跨模态对齐能力。实验结果表明,LoRASculpt在VQA和图像描述任务上显著优于现有基线,同时有效

订阅专栏 解锁全文

订阅专栏 解锁全文

2540

2540

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?