文章主要内容

- 背景与问题:大语言模型(LLMs)在多种任务中表现出色,但在特定任务上仍有提升空间。微调LLMs成本高昂,且对于闭源或仅通过API访问的模型不可行。虽然利用有用经验可提升LLMs性能,但寻找合适经验困难,现有自动寻找经验的方法难以保证有效性。

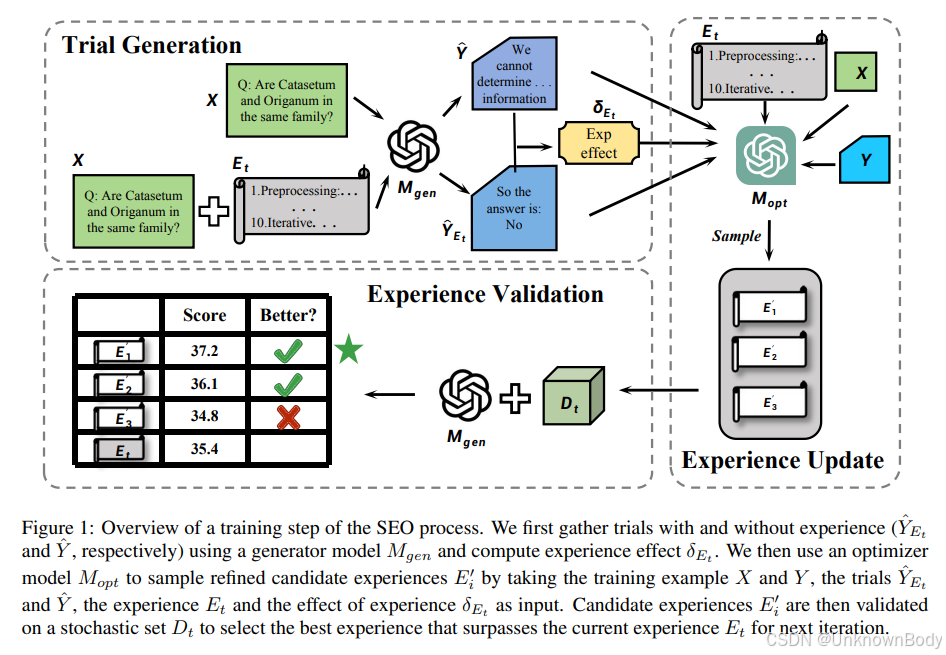

- 随机经验优化(SEO)框架:提出SEO,通过自然语言中的经验更新来寻找优化的特定模型经验,无需修改模型参数。该框架包含试验生成、经验更新和经验验证三个主要步骤,使用生成器模型和优化器模型,在每次训练步骤中迭代优化经验。

- 实验设置与结果:在多跳问答、机器翻译和文本分类三个任务上,使用三个LLMs,在七个数据集上进行实验。结果表明,SEO能稳定提升各种LLMs在不同任务上的性能,优于直接回答、应用初始经验以及CLIN和ExpeL等基线方法。

- 分析:研究了初始经验的影响,发现不同初始化对性能影响不同,SEO可优化多种初始经验提升性能。通过手动分析错误类型,发现SEO经验提升性能主要源于生成更多正确答案和更好的答案格式。此外,SEO优化的经验在分布外数据和跨语言场景中具有泛化能力,消融实验验证了SEO各组件的重要性。

文章创新点

- 自动经验优化

订阅专栏 解锁全文

订阅专栏 解锁全文

1106

1106

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?