摘要

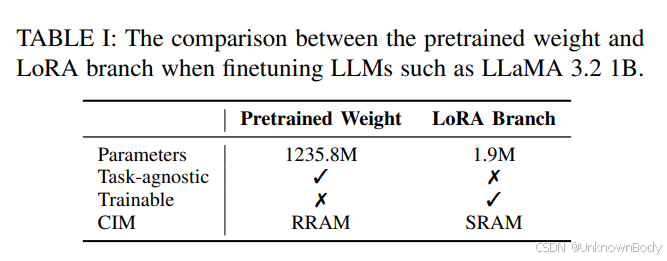

低秩自适应(LoRA)是一种主流的参数高效微调方法,用于使大语言模型(LLMs)适应下游任务。在本文中,我们首次提出将LoRA微调后的大语言模型部署在混合内存计算(CIM)架构上(即,预训练权重存储在RRAM中,LoRA存储在SRAM中)。为了解决RRAM固有噪声导致的性能下降问题,我们设计了一种新颖的硬件感知低秩自适应(HaLoRA)方法,旨在通过对齐理想和噪声条件下的训练目标,训练出既稳健又准确的LoRA分支。对LLaMA 3.2 1B和3B模型进行微调的实验证明了HaLoRA在多个推理任务中的有效性,在不同噪声水平下保持稳健性的同时,平均得分提高了22.7。

引言

大语言模型(LLMs),如GPT-4、LLaMA和Qwen,在各种自然语言处理(NLP)任务中展现出了出色的性能。然而,这种主要由大量模型参数驱动的成功,在实际应用中带来了两个关键挑战。第一,通过全模型微调使大语言模型适应下游任务需要巨大的计算资源。第二,模型推理需要大量的能源消耗,限制了这些模型的广泛部署。

为了解决适应性限制问题,人们提出了各种参数高效微调(PEFT)方法。其中,低秩自适应(LoRA)因其简单有效而越来越受欢迎,它只需更新一个额外的低秩矩阵,同时保留原始的预训练权重。与此同时,为了提高推理效率,内存计算(CIM)架构直接在内存阵列中进行计算,通过阵列级并行计算实现高能效。电阻式随机存取存储器(RRAM)和静态随机存取存储器(SRAM)是用于CIM

订阅专栏 解锁全文

订阅专栏 解锁全文

877

877

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?