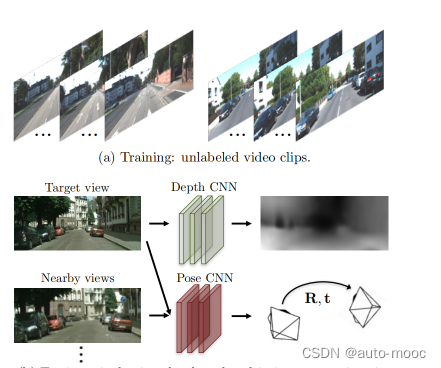

基于自监督学习的单目深度+位姿估计的经典框架,成为最基本的自监督学习的范式。后来提出的许多自监督方法都以此为基础。

提出了一个无监督的学习框架,用于任务的单眼深度和摄像机运动估计的非结构化视频序列。我们使用端到端学习方法,以视图合成作为监督信号。与之前的工作相比,我们的方法是完全无监督的,只需要单眼视频序列进行训练。我们的方法使用单视图深度和多视图姿态网络,基于使用计算 的深度和姿态扭曲附近的视图到目标的损失。因此,网络在训练过程中被损失耦合,但可以在测试时独立应用 。对KITTI数据集的经验评估证明了我们的方法的有效性 :

1)单眼深度与使用地面真实姿态或深度进行训练的监 督方法进行比较;

2)在类似的输入设置下,姿态估计的 性能优于已建立的SLAM系统。

人类在估计自身运动和场景的三维结构方面有出色的能力;但是几何计算机视觉的研究,在非刚性的、闭塞的或者缺乏纹理的真实场景上无法创造类似于人类能力的模型。

为什么人类能表现的如此出色呢?

一种假设是,我们通过过去的视觉经验对世界形成了丰富的、结构化的理解,这主要包括四处移动和观察大量场景,并对我们的观察形成一致的模型。

在数百万次这样的观察中,我们认识着世界的规律——道路是平的,建筑物是直的,汽车是在道路上行驶的等等。我们可以将这些知识应用到感知一个新场景时,甚至是从一个单目图像中。

我们通过训练图像序列的模型来模拟这种方法,预测可能的相机运动和场景结构来解释看到的图像序列。

我们采用端到端方法,允许模型直接从输入像素映射到 自我运动场景结构。

只有当几何视图合成系统对于场景几何和相机位姿的估计符合真实情景,才能稳定地有好的表现。

因此,我们的目标是将整个视图合成的过程表述为卷积神经网络的推理过程。

通过训练大规模视频数据的网络来完成视图合成的“元”任务,迫使网络学

文章提出了一种无监督学习框架,用于单眼视频中的深度和摄像机运动估计。通过端到端的视图合成损失,网络在训练中学习深度和姿态,但在测试时可独立应用。实验显示方法在单眼深度和姿态估计上表现有效,但仍有动态、遮挡估计及未知相机内参等问题待解决。未来工作可能涉及动态场景建模、3D体积学习以及表示学习的深入研究。

文章提出了一种无监督学习框架,用于单眼视频中的深度和摄像机运动估计。通过端到端的视图合成损失,网络在训练中学习深度和姿态,但在测试时可独立应用。实验显示方法在单眼深度和姿态估计上表现有效,但仍有动态、遮挡估计及未知相机内参等问题待解决。未来工作可能涉及动态场景建模、3D体积学习以及表示学习的深入研究。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2565

2565

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?