Ollama框架启动教程

Ollama是⼀个开源的⼤语⾔模型服务⼯具,专注于简化本地模型的创建、管理和部署流程。它可以帮 助开发⼈员和数据科学家轻松地在本地或私有环境中使⽤⼤语⾔模型,⽽不必依赖于云服务,从⽽保 证了数据隐私和灵活性

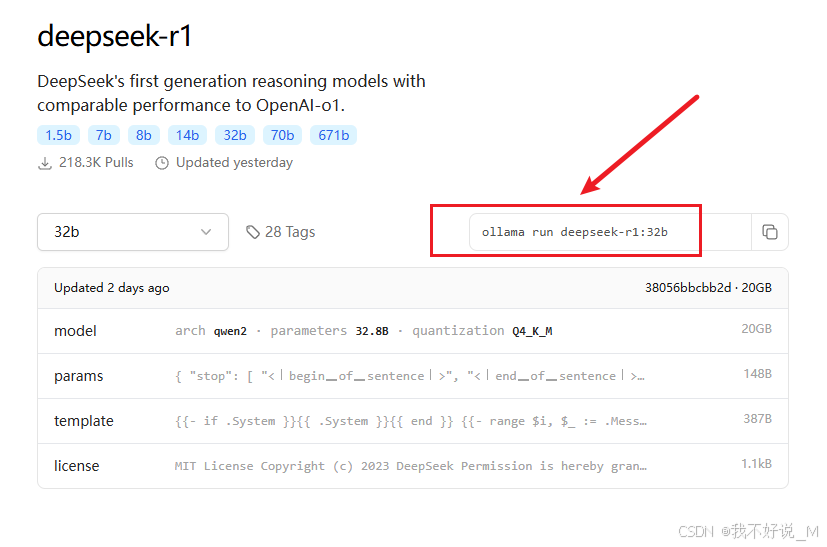

在官⽹可以看到Ollama⽀持的模型列表:library

先安装ollama

curl -fsSL https://ollama.com/install.sh | sh启动ollama

ollama serve通过以下指令可以,检查ollama可运⾏的模型列表

ollama list下载模型(在library中找到你要部署的本地模型,运行后面的代码)

ollama run deepseek-r1:32b如何退出

在对话框中输入

/bye就能返回到命令行中

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?