目录

问题描述

Trying to backward through the graph a second time, but the saved intermediate results have already been freed. Specify retain_graph=True when calling .backward() or autograd.grad() the first time.

出现此问题的原因

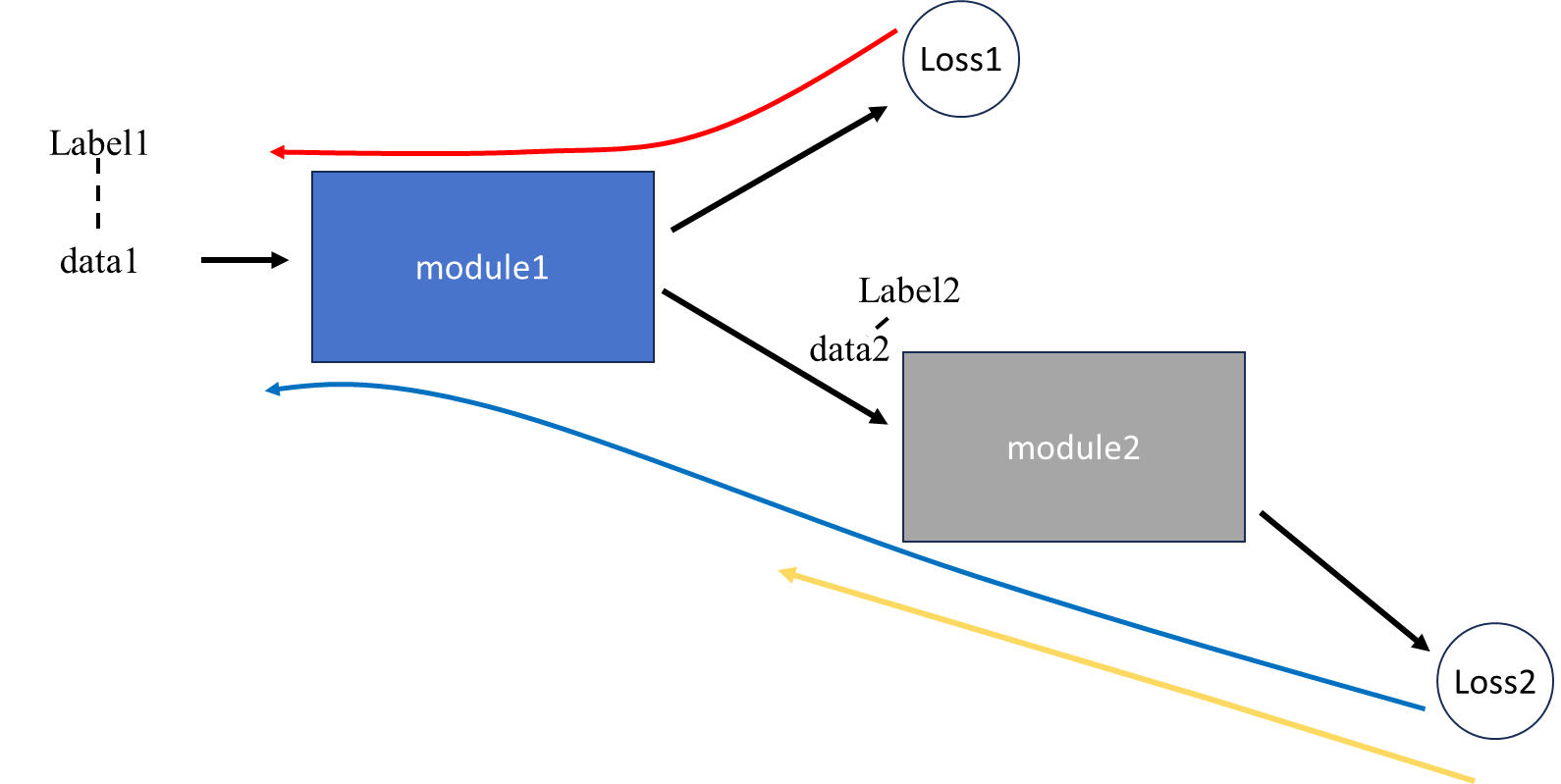

举例来说,假如上图所示,你的模型中包含多个组成部分,比如生成对抗网络这种的或者其它。

你的训练过程是

步骤1、根据 loss1 更新 module1

步骤2、根据loss2 更新 module2

这时,在更新过程中你的代码可能是如下这样

loss_1 = Loss1(module1(data1), Label1)

module1.zero_grad()

loss_1.backward()

optimizer1.step() # 假如这个是module1的优化器

loss_2 = Loss2(module(data2), Label2)

module2.zero_grad()

loss_2.backward()

optimizer2.step() # 假如

文章讲述了在深度学习训练过程中,由于多模块间的依赖导致梯度丢失的问题。重点介绍了如何通过设置retain_graph=True和使用detach()函数来解决loss_2计算时对module1梯度的误用,以确保反向传播的正确性。

文章讲述了在深度学习训练过程中,由于多模块间的依赖导致梯度丢失的问题。重点介绍了如何通过设置retain_graph=True和使用detach()函数来解决loss_2计算时对module1梯度的误用,以确保反向传播的正确性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2244

2244