1.结构

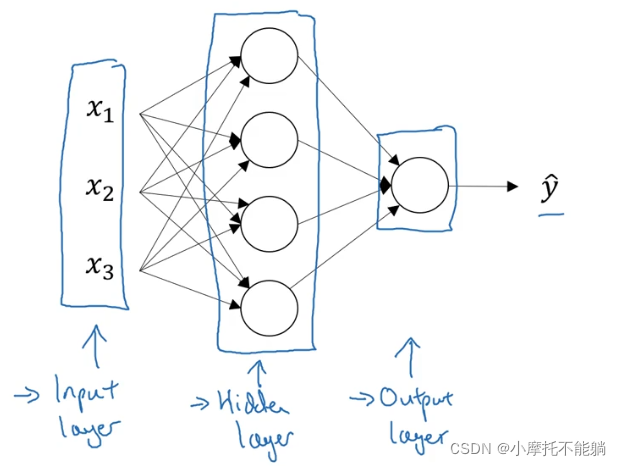

从左到右依次是输入层、隐藏层、输出层

从左到右依次是输入层、隐藏层、输出层

神经网络的层数从隐藏层算起,输入层为第零层,所以上图是双层神经网络。隐藏层和输出层是带有参数的。

2.输出计算

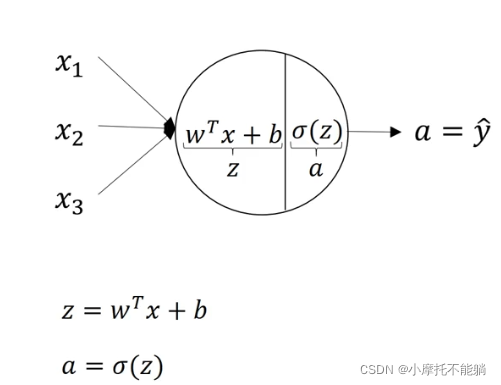

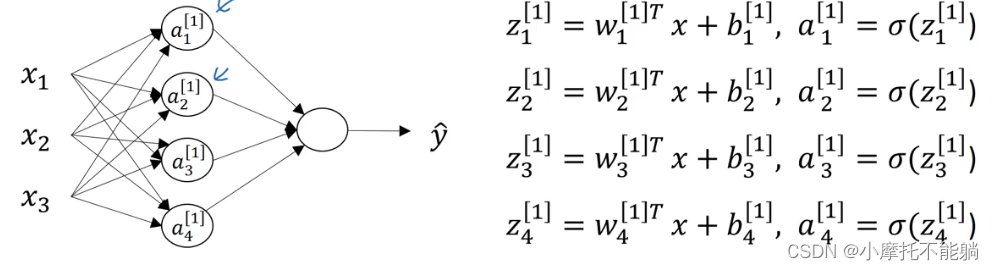

隐藏层中的每个节点都进行这这种计算,先计算Z,再计算激活函数。例如下图中的隐藏中的四个节点:

隐藏层中的每个节点都进行这这种计算,先计算Z,再计算激活函数。例如下图中的隐藏中的四个节点:

3.激活函数

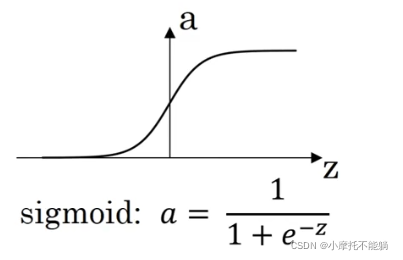

σ函数

除非二元分类要用,其它场合几乎不用。

除非二元分类要用,其它场合几乎不用。

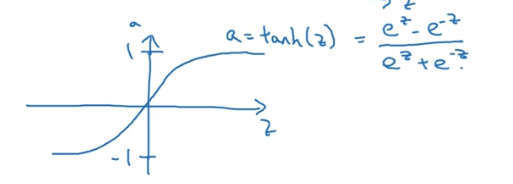

tanh函数:

不同层的激活函数可以不一样。tanh函数可以使用于几乎所有场合,它的效果比σ函数要好,但如果输出要求y是0或1这种二元分类情况时,应使用σ函数。

不同层的激活函数可以不一样。tanh函数可以使用于几乎所有场合,它的效果比σ函数要好,但如果输出要求y是0或1这种二元分类情况时,应使用σ函数。

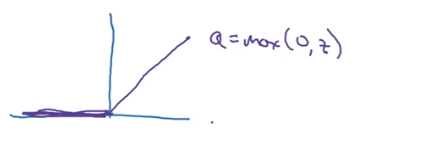

ReLu函数:

Z为正时,斜率为1;z为负时,斜率为0.最常用的激活函数。

Z为正时,斜率为1;z为负时,斜率为0.最常用的激活函数。

经验法则:如果在做二元分类,输出层的激活函数选用σ函数,其它层激活函数选用ReLu函数。

4.激活函数的导数

σ函数的导数:

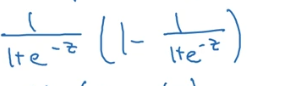

tanh函数的导数:

tanh函数的导数:

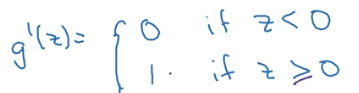

ReLu函数的导数:

ReLu函数的导数:

神经网络详解:结构、激活函数与导数

神经网络详解:结构、激活函数与导数

本文深入探讨了神经网络的结构,包括输入层、隐藏层和输出层,强调隐藏层和输出层的参数重要性。介绍了激活函数的作用,如σ函数、tanh函数和ReLu函数,并给出了它们的导数公式。对于神经网络的设计,建议在二元分类时使用σ函数作为输出层激活函数,其他层则推荐使用ReLu函数。

本文深入探讨了神经网络的结构,包括输入层、隐藏层和输出层,强调隐藏层和输出层的参数重要性。介绍了激活函数的作用,如σ函数、tanh函数和ReLu函数,并给出了它们的导数公式。对于神经网络的设计,建议在二元分类时使用σ函数作为输出层激活函数,其他层则推荐使用ReLu函数。

1290

1290

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?