之前使用Ollama基于顺序调用的场景比较了3090和4090的显卡性能:

同时,又基于3090显卡比较了Ollama和vLLM在顺序调用和多并发推理场景下的性能差异:

这里再使用vLLM测试下大模型并发推理场景下3090和4090两张显卡的性能表现,看下4090是否在高并发场景下具备更高的扩展性。

在GPU算力租用平台 晨涧云 分别租用3090显卡和4090显卡的vLLM云容器进行测试。

大模型选择

选择 Qwen3的模型进行测试,考虑到都是24GB的显存,选择的是FP16精度的qwen3:8b模型进行测试。

借助DeepSeek 生成测试脚本,调整脚本控制变量:

-

使用复杂度近似的N个prompts;

-

MAX_TOKENS配置256,让每次请求需要一定的生成时长便于采样显卡的使用指标,减少波动; -

选择

[1, 4, 8, 16]4种BATCH_SIZES测试不同并发度下的性能表现; -

每轮测试执行3次推理,指标取平均;

-

同时需要模型预热,消除第一次推理响应延时过大的问题。

然后执行推理性能测试脚本,查看输出结果。

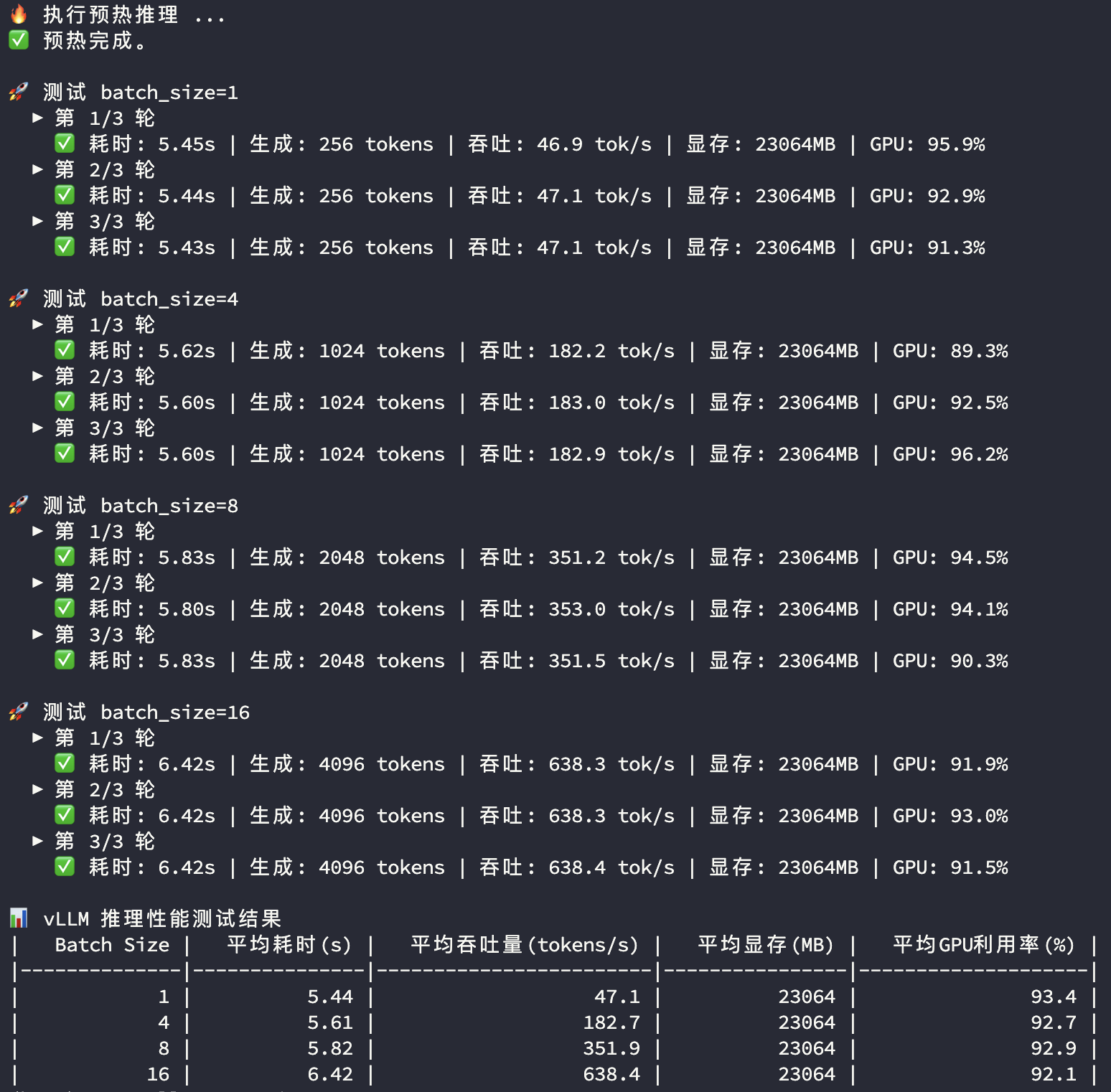

3090推理性能

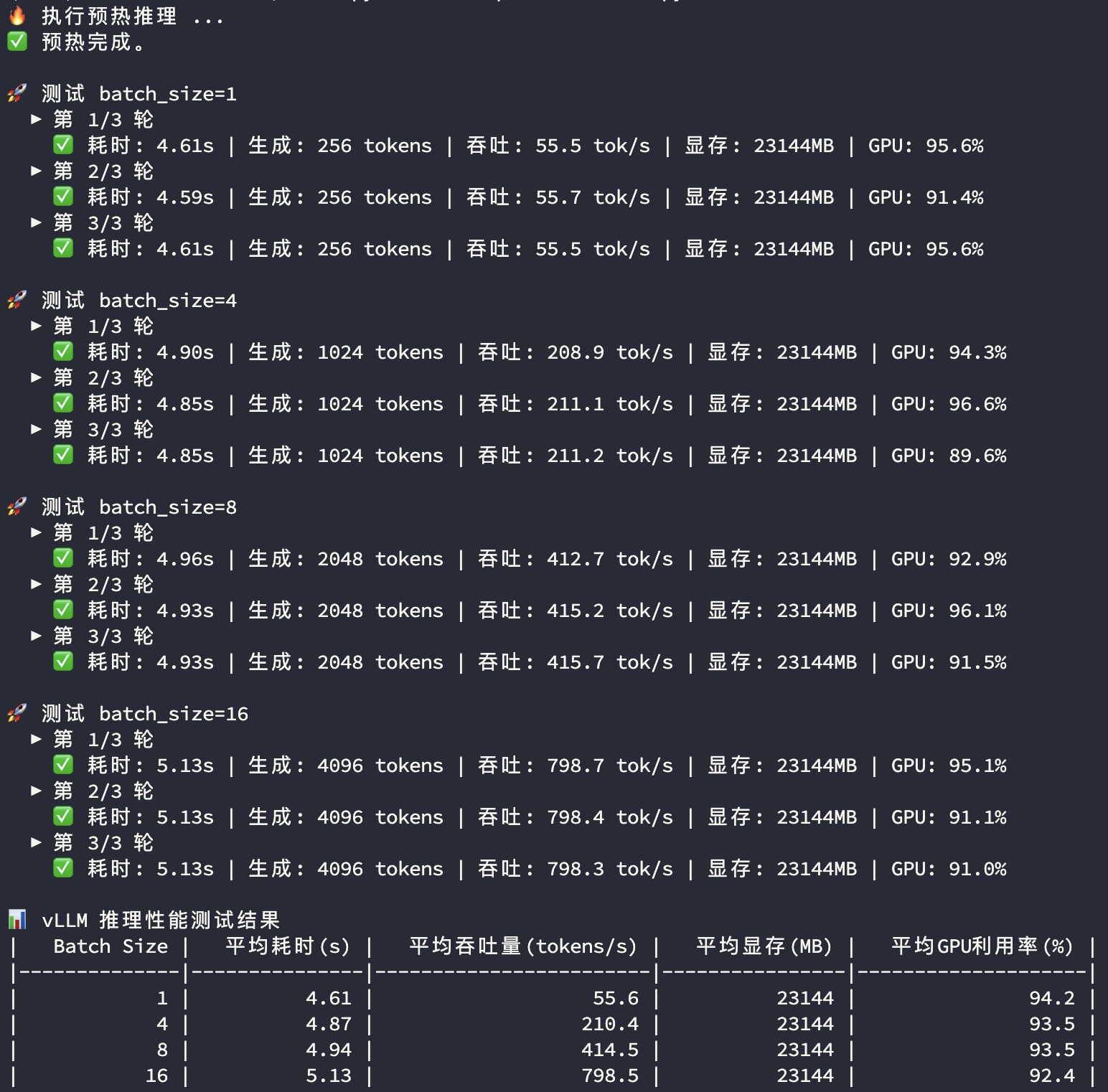

4090推理性能

测试结果解释

-

Batch Size:一次推理调用的并发prompt数量

-

平均耗时 (s):多次推理平均响应时长

-

平均吞吐量 (tokens/s):多次推理平均Token生成速度

-

平均显存 (MB):多次推理平均显存使用量

-

平均GPU使用率(%):多次推理平均GPU使用率

3090显卡和4090显卡在模型推理过程中的显存和GPU使用率都比较接近,主要看平均耗时及平均吞吐量两个指标:

| Batch Size | RTX 3090 | RTX 4090 | 对比 | |

|---|---|---|---|---|

| 1 | 平均耗时(s) | 5.44 | 4.61 | |

| 1 | 平均吞吐量(tokens/s) | 47.10 | 55.60 | 118.0% |

| 4 | 平均耗时(s) | 5.61 | 4.87 | |

| 4 | 平均吞吐量(tokens/s) | 182.70 | 210.40 | 115.2% |

| 8 | 平均耗时(s) | 5.82 | 4.94 | |

| 8 | 平均吞吐量(tokens/s) | 351.90 | 414.50 | 117.8% |

| 16 | 平均耗时(s) | 6.42 | 5.13 | |

| 16 | 平均吞吐量(tokens/s) | 638.40 | 798.50 | 125.1% |

1~8并发度场景下,3090和4090的推理性能均保持稳定,4090比3090高17%左右;在16并发度下3090开始遇到性能瓶颈,而4090显然较3090有更充足的剩余性能空间。

1686

1686

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?