DenseNet 笔记

1. Densenet vs Resnet

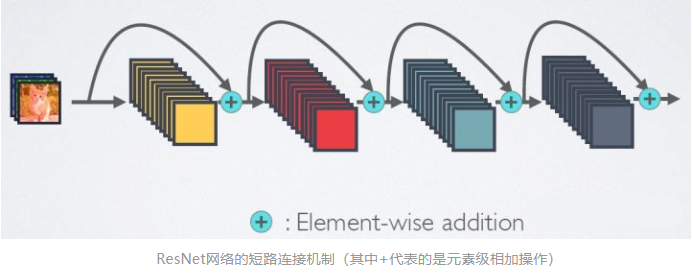

ResNet:每个层与前面的某层(一般是2~3层)短路连接(shortcuts、skip connection)在一起,连接方式是通过元素级相加(element-wise addition)。

DenseNet:每个层都会与前面所有层在 channel 维度上连接(channel-wise concatenation/特征重用)在一起(各个层的特征图大小是相同的),并作为下一层的输入。

传统的网络, l 层的输出为:

ResNet,增加了来自上一层输入的identity函数:

DenseNet,连接前面所有层作为输入:

其中,上面的 $H_l(\cdot)$ 代表是非线性转化函数(non-liear transformation),它是一个组合操作,其可能包括一系列的BN(Batch Normalization),ReLU,Pooling及Conv操作。注意这里 l 层与 l-1 层之间可能实际上包含多个卷积层。

DenseNet的前向过程如下图所示,可以更直观地理解其密

本文详细介绍了DenseNet与ResNet的区别,DenseNet的网络结构包括DenseBlock和Transition,其中DenseBlock通过growth rate和bottleneck layer实现特征重用。DenseNet的优势在于强梯度流、参数和计算效率、多样化特征以及保持低复杂度特征,尤其适合小样本学习。

本文详细介绍了DenseNet与ResNet的区别,DenseNet的网络结构包括DenseBlock和Transition,其中DenseBlock通过growth rate和bottleneck layer实现特征重用。DenseNet的优势在于强梯度流、参数和计算效率、多样化特征以及保持低复杂度特征,尤其适合小样本学习。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1314

1314

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?