2.1 CNN

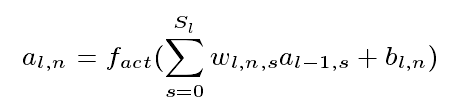

这项工作的重点是监督学习,其目标是找到一个函数g(xi),它近似于映射xi→yi ∀i,其中{xi,yi}是一个输入/输出对,称为训练样例。 多层感知器是一种人工神经网络,其神经元在多层中排列,神经元将前一层的所有神经元的输出作为输入。 在数学上,全连接网络的第l层中nth神经元的输出al,n计算如下:

其中wl,n,s是 lth层中sth突触与nth神经元的输入相连的的权重,bl,n是偏置项,fact是激活函数,S1是连接到lth层中每个神经元的突触数。

流行的激活函数包括:双曲正切函数,fact(a)= tanh(a); 和整流线性单位(ReLU),fact(a)= max(0,a)。 此外,我们只研究推理问题,假设认为参数w已经被学习了。

卷积神经网络(CNN)是多层感知器的变体,其中,前一层仅接收来自前一层的小接收场的输入。 这种方法大大减少了所涉及的参数数量,但仍能找到局部特征(例如:边缘,角落)。

神经网络中的基本2D卷积层类似于全连接层,除了以下的不同外:

a)每个神经元接收的图像为 输入,生成的图像作为其输出(而不是标量);

b)每个突触学习一小部分(卷积窗口的大小)权重;

c)输出图像中的每个像素是由所有突触权重和相应图像之间的卷积的总和得到的。

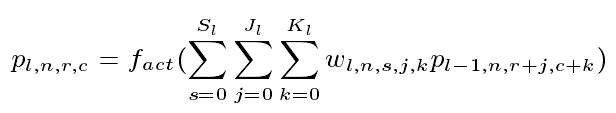

lth卷积层的输出,需要输入Sl个尺寸为Rl×Cl的图像,(r,c)位置上的像素、pl,n,r,c,nth图像输出计算如下:

其中Jl×Kl是卷积窗口的大小。2D卷积层可以减少到矩阵乘法,然后再进行是元素激活函数运算,在后面会对此进行更加详细的介绍。

CNN拓扑结构由几个常见的基元组成:卷积层,池化层和全连接层

本文介绍了卷积神经网络(CNN)的基本原理,如全连接层、2D卷积层和常见的CNN拓扑结构。此外,探讨了二值神经网络(BNN)的优势,包括减少参数冗余和提高硬件效率。最后,概述了神经网络在FPGA和ASIC上的硬件实现策略,如收缩阵列、流式架构、矢量处理器和神经突触处理器,并讨论了BNN在FPGA映射的潜力。

本文介绍了卷积神经网络(CNN)的基本原理,如全连接层、2D卷积层和常见的CNN拓扑结构。此外,探讨了二值神经网络(BNN)的优势,包括减少参数冗余和提高硬件效率。最后,概述了神经网络在FPGA和ASIC上的硬件实现策略,如收缩阵列、流式架构、矢量处理器和神经突触处理器,并讨论了BNN在FPGA映射的潜力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2524

2524