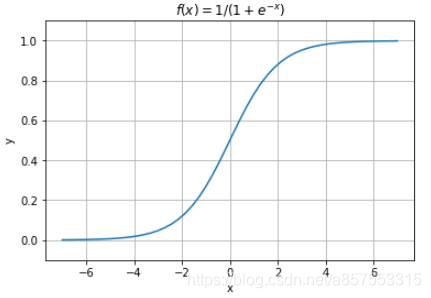

1.sigmoid

import numpy as np

from matplotlib import pyplot as plt

# sigmoid

x = np.linspace(-7, 7, 50)

y = 1 /(1 + np.exp(-x))

plt.figure(1)

plt.xlabel("x")

plt.ylabel("y")

plt.ylim(-0.1, 1.1)

plt.title(r"$f(x) = 1 /(1 + e^{-x})$")

plt.plot(x,y)

plt.grid()

plt.show()

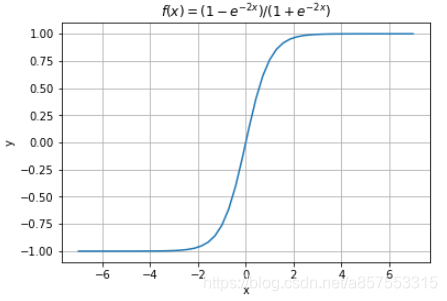

2.tanh

# tanh

x = np.linspace(-7, 7, 50)

y = (1 - np.exp(-2 * x)) /(1 + np.exp(-2 * x))

plt.figure(1)

plt.xlabel("x")

plt.ylabel("y")

plt.ylim(-1.1, 1.1)

plt.title(r"$f(x) = (1 - e^{-2x}) /(1 + e^{-2x})$")

plt.plot(x,y)

plt.grid()

plt.show()

如果把sigmoid和tanh函数图形画在一起你会发现它们形状很相似,然后再观察他们的函数式,就会发现,其实:

tanh = 2sigmoid(2x)-1

不妨动手推导一下

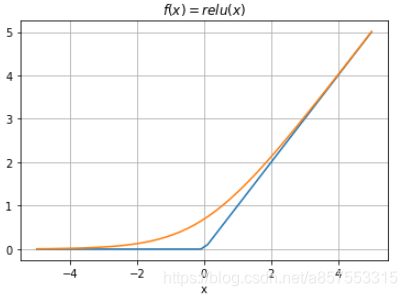

3.softplus和relu

# relu和softplus画在一张图上

x = np.linspace(-5, 5, 50)

y1 = [max([0, xpoint]) for xpoint in x]

y2 = np.log(1 + np.exp(x))

plt.figure(1)

plt.xlabel("x")

plt.ylabel("y")

plt.title(r"$f(x) = relu(x)$")

plt.plot(x,y1)

plt.plot(x,y2)

plt.grid()

plt.show()

博客提及sigmoid、tanh、softplus和relu函数。将sigmoid和tanh函数图形绘制在一起,形状相似,可通过观察函数式进行推导。

博客提及sigmoid、tanh、softplus和relu函数。将sigmoid和tanh函数图形绘制在一起,形状相似,可通过观察函数式进行推导。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?