目录

前言

HitNet是2023年2月份发表在AAAI的一篇文章,作者受到图像超分辨率反馈网络的启发,以迭代反馈的方式通过高分辨率特征来细化低分辨率表示,打破了伪装目标检测的性能瓶颈。

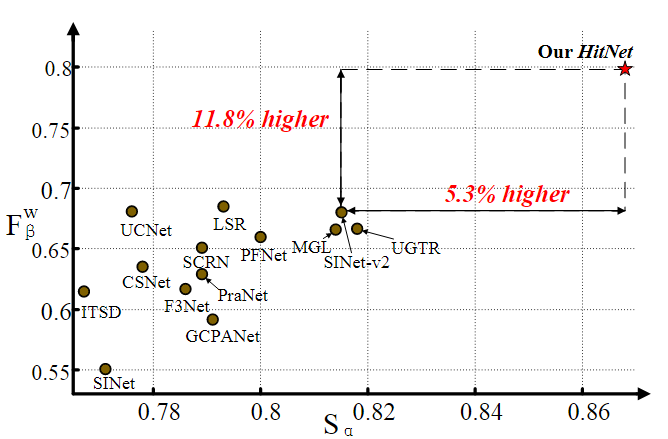

如下图,本文的方法与目前的29种SOTA方法在COD10k Test数据集上的性能比较。HitNet的 F β w F_{\beta}^w Fβw为0.798,比排名第二的LSR高16.5%。

并且,在CHAMELEON数据集上,HitNet实现了0.018的平均MAE误差,比SINet-v2提高了40%,优于 T 2 N e t T^2Net T2Net的0.023。

1. 模型的特点

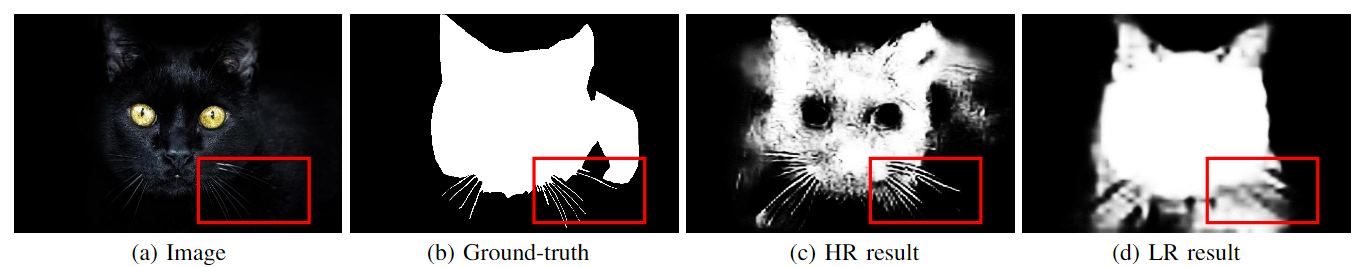

作者提出高分辨率的输入图片对于伪装目标的边缘和边界检测至关重要,而现有的大多数方法都对高分辨率输入进行下采样操作来平衡计算资源和性能,这种从高分辨率(HR)到低分辨率(LR)的输入退化,导致视觉模糊,模型无法捕捉到精细结构。

作者分析,造成图像退化的原因有两个方面:

- 输入图像缺乏高分辨率信息

- 缺乏有效的加强低分辨率特征的机制

因此,如何在不牺牲实时性的前提下,保持高分辨率信息的输入水平,增强低分辨率特征,是一个值得探索的课题。

超分辨率的迭代反馈机制允许网络以更高的分辨率矫正更低的分辨率,论文Feedback Network for Image Super-Resolution中提出了一种图像超分辨率反馈网络,通过勾勒边缘和轮廓,同时抑制平滑区域,利用HR信息来细化LR表示。受此启发,作者构建了基于Transformer的高分辨率迭代反馈网络来解决伪装目标检测问题。

如下图所示,使用在LR图像上训练好的SINet分别对高分辨率(HR)输入和低分辨率(LR)输入进行分割。可以发现一个有趣的现象:同一个模型,表现出了不同的效果,HR的分割结果比LR的分割结果有更多的猫胡子等细节。

2. 模型结构

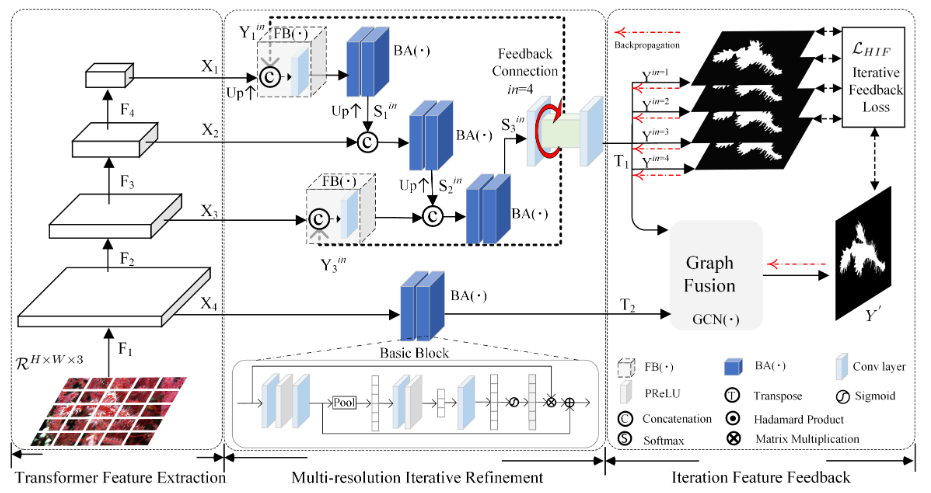

HitNet主要包含三个模块:

- 基于Transformer的特征提取模块(TFE)

- 多分辨率迭代细化模块(RIR)

- 迭代特征反馈模块(IFF)

为了降低HR特征图的计算成本,采用PVT作为图像特征编码器。

然后,利用RIR模块通过全局和跨尺度反馈策略递归地细化从TFE提取的LR特征。

为了保证反馈特征更好地聚合,使用迭代特征反馈(IFF)对反馈特征流进行约束。

2.1 基于Transformer的特征提取

Transformer相比于CNN往往需要占用更大的GPU内存,而处理高分辨率图像(HR)将进一步放大这个问题。

PVT作为特征提取模块可以提取多尺度特征,而且因其渐进收缩策略和空间缩减注意机制,可以用较小的内存成本处理相对较高分辨率的特征图。

得到多尺度特征图 ( X 1 , X 2 , X 3 , X 4 ) (X_1,X_2,X_3,X_4) (X1,X2,X3,X4),分辨率分别是原图的 ( 1 32 , 1 16 , 1 8 , 1 4 ) (\frac{1}{32},\frac{1}{16},\frac{1}{8},\frac{1}{4}) (321,161,81,41)

2.2 多分辨率反馈细化(特征融合细化)

如结构图中所示,从Transformer主干提取的多尺度分辨率特征 X X X被馈送到一个基本块BA( ⋅ \cdot ⋅)中,

B A ( X i ) = C 2 ( X i ) + C b ( C 2 ( X i ) ) ⋅ X i BA(X_i)=C_2(X_i)+C_b(C_2(X_i)) \cdot X_i BA(Xi)=C2(Xi)

HitNet是一种新提出的伪装目标检测模型,它通过结合Transformer和迭代反馈机制,有效地利用高分辨率信息,提高检测性能。模型包括基于Transformer的特征提取、多分辨率反馈细化和迭代特征反馈模块。在COD10kTest和CHAMELEON数据集上,HitNet显著超越了当前的SOTA方法。其创新点在于保持高分辨率输入并强化低分辨率特征,解决了输入退化问题,提升了边缘和边界检测的准确性。

HitNet是一种新提出的伪装目标检测模型,它通过结合Transformer和迭代反馈机制,有效地利用高分辨率信息,提高检测性能。模型包括基于Transformer的特征提取、多分辨率反馈细化和迭代特征反馈模块。在COD10kTest和CHAMELEON数据集上,HitNet显著超越了当前的SOTA方法。其创新点在于保持高分辨率输入并强化低分辨率特征,解决了输入退化问题,提升了边缘和边界检测的准确性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

13万+

13万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?