英文题目:

Adaptive Sparse Convolutional Networks with Global Context Enhancement for

Faster Object Detection on Drone Images

摘要:在资源受限的无人机平台上,低时延的无人机图像目标检测是一个重要但是具有挑战的任务。本文研究了基于稀疏卷积的检测头优化,这已被证明宰检测准确性和效率方面是有效的。但是在微小物体上下文信息整合上存在不足以及存在不同尺度前景的情况下对掩码比率控制是不足的。为了解决上述问题,我们提出了一种新颖的上下文增强自适应稀疏卷积网络(CEASC)。首先开发了一种上下文增强的分组归一化(CE-GN)层,通过用全局上下文替换基于稀疏采样特征的统计,然后设计了一种自适应多层掩码策略,来生成不同尺度下的最佳掩码比率,实现紧凑的前景覆盖,从而提高准确率和效率。当将CEASC插入到典型的最先进的检测框架,可以显著减少GFLOPs并加速推理过程。代码在

https://github.com/Cuogeihong/

CEASC获取。

1. 引言

现在设计的复杂模型在高分辨率无人机图像上达到微小物体的高精度,但是在计算上消耗较大。另一方面,无人机配备的硬件通常资源受限,迫切需要轻量级部署模型来实现推理和低时延。

为了解决准确性和效率之间的矛盾,在通用目标检测上,基本集中在减少骨干网络的复杂度。但是未考虑到检测器中常用的检测头,仍然具有改进的空间。以ResNet作为主干网络,输入通道为512的RetinaNet采用一个检测头,占用了整体GFLOPs的82.3%。模型的剪枝和结构重设计在加速推理方面是有效的,但是剪枝在计算量大幅度减少时,性能急速下降。结构重设计主要是针对低分辨率输入进行优化,难以适配高分辨率的航空图像。

稀疏卷积(

稀疏卷积 Sparse Convolution Net-优快云博客)是另外一种有希望的替代方案,但是在航空图像中由于前景区域的尺度会随着飞行高度和观察视角的变化而变化,而且不适当的掩码会消耗更多不必要的计算,会同时降低效率和精度。

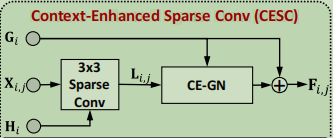

本文提出:全局上下文增强自适应卷积( CEASC),开发一种叫上下文增强稀疏卷积(CESC)捕获全局信息并增强焦点特征。

本文提出:全局上下文增强自适应卷积( CEASC),开发一种叫上下文增强稀疏卷积(CESC)捕获全局信息并增强焦点特征。

3. 方法

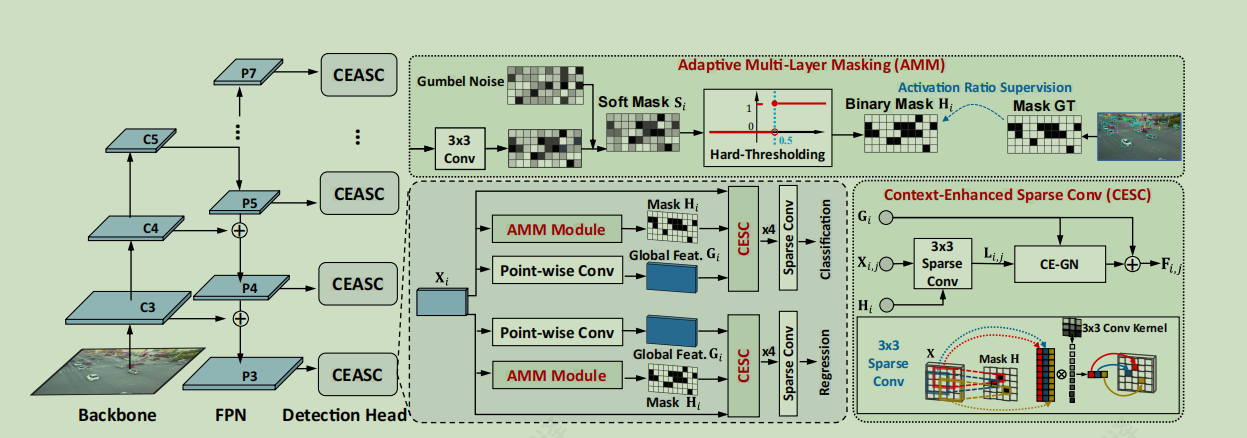

图1

如图1所示:给定一个基础检测器,整个CEASC网络通过CESC来优化FPN不同层的检测头,CESC包括轻量级卷积模块和一个上下文增强组归一化层(CE-GN)将焦点信息与全局上下文相结合。设计自适应多层掩码(AMM)模块,使得模型能够自适应生成具有适当掩码比例的掩码,在精度和效率之间达到更好的平衡。

3.1 CESC

3.1.1 SC

大多数用于无人机图像的检测器都需要使用密集检测头,在整个特征图上进行卷积。尽管充分探索视觉线索有助于检测微小物体,但是密集头部需要进行更多的计算,在资源受限的无人机平台上并不适用。

稀疏卷积(SC)通过稀疏掩码来学习在前景区域操作,并在各种视觉任务上的推理加速加速阶段是有效的,基于此,基于SC进行网络的构建,对于FPN中i层的特征图

SC采用一个由共享核

组成的掩码网络,基于Wmask在Xi上进行卷积,生成一个软特征

组成的掩码网络,基于Wmask在Xi上进行卷积,生成一个软特征

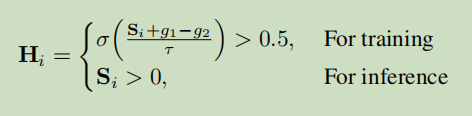

,然后对Si使用Gumbel-Softmax将其进一步转化为掩码矩阵

,然后对Si使用Gumbel-Softmax将其进一步转化为掩码矩阵

g1和g2分别表示两个随机Gumbel噪声,

表示Sigmod函数,

表示Sigmod函数,

表示Gumbel-Softmax中的相应温度参数。

表示Gumbel-Softmax中的相应温度参数。

这个过程就是图1中的过程。

由Hi的计算公式,在推理过程中,只有掩码数值为1的区域参与卷积,从而降低了整体的计算成本。由于基础检测器在检测框架中具有分类头部和回归头部,在每个头部都引入一个掩码网络,因为它们通常关注于不同区域,每个检测头部采用四个 sc-GN-ReLU和一个单独的卷积层进行预测,将传统的卷积层替换为SC。

3.1.2 全局上下文增强

在上下文线索(背景环绕目标)中,上下文线索有助于目标检测;但是SC仅在前景执行卷积,放弃了包含有用信息的背景,可能会降低整体的准确性。为了解决这个问题,尝试通过插值恢复周围的上下文,提出一种叫CESC的模块,利用焦点信息和全局上下文进行增强,同时提高后续计算的稳定性,对特征图Xi进行点卷积,生成全局上下文特征Gi,由于SC只处理Xi中的少量元素,Gi在多次SC之后变得稳定,无需额外的计算成本。

图1的这个过程

图1的这个过程

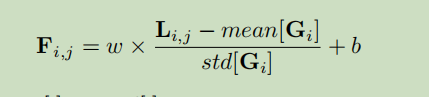

作为SC的重要组成部分,将Gi嵌入到SC-GN-ReLU中,该层以特征图Xi,j,掩码Hi以及全局特征Gi作为输入,j表示第j个SC-GN-ReLU层。与传统SC中用激活函数计算组归一化不同,采用Gi的标准差进行归一化,旨在补偿缺失的上下文。

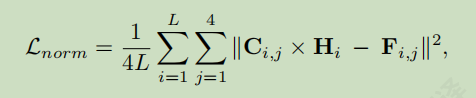

假设Li,j是应用SC于Xi,j后的输出特征图,则通过CE-GN获得的上下文增强特征Fi,j可以表示为:

为了进一步减轻SC中信息损失并使训练过程更加稳定,在训练阶段使用SC外,害额外使用正常密集卷积,生成一个在完整输入特征图上卷积的特征图Ci,j,然后使用Ci,j优化MSE损失来增强稀疏训练图Fi,j:

在最终激活层之前通过添加Gi到Fi,j,即使用残差结构Fi,j=Fi,j+Gi,加强了上下文保留。

3.2 AMM

这部分不在进行表述。

总结:本文的逻辑还是比较清晰的,大家可以学习论文的写作方法,我个人觉得如果你的研究方向是和小目标检测,轻量化相关的,可以进行自己的实验。

1570

1570

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?