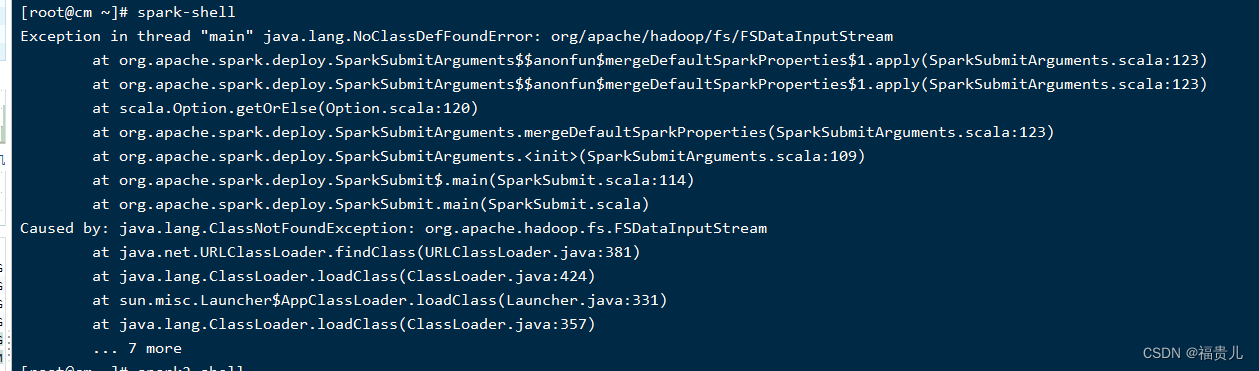

1.问题描述

[root@cm ~]# spark-shell

Exception in thread "main" java.lang.NoClassDefFoundError: org/apache/hadoop/fs/FSDataInputStream

at org.apache.spark.deploy.SparkSubmitArguments$$anonfun$mergeDefaultSparkProperties$1.apply(SparkSubmitArguments.scala:123)

at org.apache.spark.deploy.SparkSubmitArguments$$anonfun$mergeDefaultSparkProperties$1.apply(SparkSubmitArguments.scala:123)

at scala.Option.getOrElse(Option.scala:120)

at org.apache.spark.deploy.SparkSubmitArguments.mergeDefaultSparkProperties(SparkSubmitArguments.scala:123)

at org.apache.spark.deploy.SparkSubmitArguments.<init>(SparkSubmitArguments.scala:109)

at org.apache.spark.deploy.SparkSubmit$.main(SparkSubmit.scala:114)

at org.apache.spark.deploy.SparkSubmit.main(SparkSubmit.scala)

Caused by: java.lang.ClassNotFoundException: org.apache.hadoop.fs.FSDataInputStream

at java.net.URLClassLoader.findClass(URLClassLoader.java:381)

at java.lang.ClassLoader.loadClass(ClassLoader.java:424)

at sun.misc.Launcher$AppClassLoader.loadClass(Launcher.java:331)

at java.lang.ClassLoader.loadClass(ClassLoader.java:357)

... 7 more

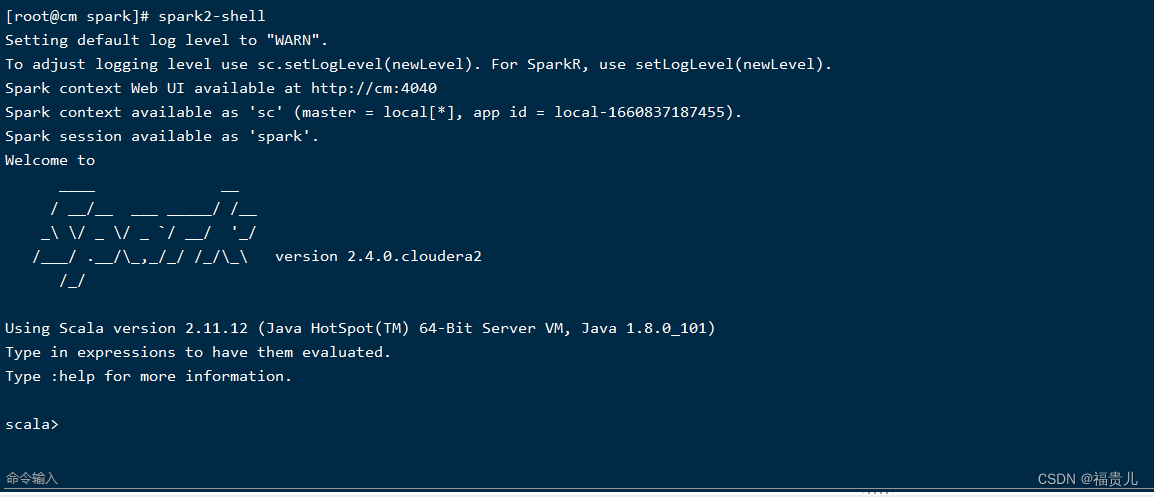

2. 解决方案

第一步:拷贝文件

cp /opt/cloudera/parcels/CDH/etc/spark/conf.dist/* /opt/cloudera/parcels/SPARK2/etc/spark2/conf.dist/第二步:配置spark-env.sh文件

vim /opt/cloudera/parcels/SPARK2/etc/spark2/conf.dist/spark-env.sh第三步:指定文件目录

export SPARK_DIST_CLASSPATH=$(hadoop classpath) //指定hadoop class文件目录

export HADOOP_CONF_DIR=/etc/hadoop/conf //指定hadoop配置文件目录3. 解决

6818

6818

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?