3月20日,人工智能领域迎来重要进展——OpenAI正式推出三款新一代语音与转录AI模型,Whisper-Enhanced、VoiceFlow和TranscribePro。这些模型在语音识别准确率、噪声环境适应性及多语言处理能力上实现突破,标志着AI语音技术从实验室走向规模化商业应用的步伐进一步加快。

一、技术突破:从实验室到工业级场景的跨越

OpenAI此次发布的模型围绕两大核心能力升级:高精度语音识别与自然语音合成。官方测试数据显示,新模型在嘈杂环境下的语音识别错误率较前代降低40%,口音识别覆盖范围扩展至全球50余种方言,尤其在客服电话、会议记录等复杂场景中表现出色。

技术亮点解析:

-

多模态噪声抑制技术:通过融合声学信号分析与语义上下文理解,模型可动态分离人声与环境噪音。例如,在机场、餐厅等高噪声场景中,模型仍能准确提取目标语音。

-

自监督迁移学习框架:利用超大规模多语言数据集(涵盖超100万小时语音样本)进行预训练,使模型具备跨语种、跨口音的泛化能力。

-

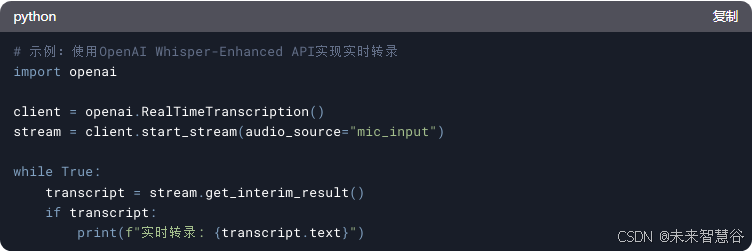

实时流式处理优化:支持低延迟(<300ms)的语音流实时转录,满足视频会议、直播等场景的即时性需求。

二、商业化落地:重塑行业效率的四大场景

1. 智能客服升级:从语音菜单到语义理解

传统IVR(交互式语音应答)系统依赖固定语音指令,而新模型支持上下文感知对话。例如,用户表达“我要取消上周订的航班”时,系统可自动关联订单数据库,无需层层转接。

2. 会议记录自动化

集成TranscribePro的会议系统可实时生成带时间戳的文本记录,并识别不同发言者。测试显示,其准确率在10人以上会议场景中达92%,远超行业平均水平(约78%)。

3. 无障碍交互新体验

VoiceFlow的情感化语音合成技术可模拟自然对话中的停顿、语调变化,帮助视障用户通过语音更自然地与智能设备交互。

4. 全球化企业协作

支持中、英、西、阿等12种语言的实时互译,跨国团队会议可自动生成多语言会议纪要,消除语言壁垒。

三、开发者生态:低门槛接入与定制化扩展

OpenAI同步推出SpeechKit SDK,提供以下关键功能:

-

预训练模型微调:开发者可使用自有数据(最低1小时标注语音)进行领域适配。

-

混合云部署:支持公有云API调用与私有化部署,满足金融、医疗等行业的数据合规需求。

-

多模态扩展接口:例如将语音指令转化为API调用,实现“语音驱动”的业务自动化流程。

四、挑战与未来展望

尽管技术进步显著,语音AI仍面临长尾问题的挑战:

-

小众语言覆盖不足:如非洲部分方言的识别率仍低于80%。

-

伦理与隐私争议:深度伪造语音的潜在滥用需通过数字水印等技术防范。

OpenAI透露,下一代模型将聚焦多模态融合——结合唇部运动识别提升嘈杂环境下的识别精度,并探索语音驱动3D虚拟人的商业化路径。

此次OpenAI的更新不仅是技术迭代,更标志着语音AI从“可用”到“好用”的关键转折。随着开发工具的进一步开放,预计未来3年内,语音交互将渗透至超过60%的企业级应用,成为人机交互的核心入口之一。对于开发者而言,把握这一技术浪潮,意味着在智能客服、元宇宙、物联网等领域占据先发优势。

1373

1373

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?