文章目录

一、微调技术的底层逻辑

1.1 预训练与微调的关系

预训练模型如同在"知识海洋"中遨游的学者,在海量无监督数据(如互联网文本、百科知识等)里学习语言模式、语义理解、逻辑推理等通用能力。而微调,就是让这位"学者"进入特定"专业领域"(如医疗诊断、金融分析),通过少量标注数据"进修",将通用知识转化为专项任务的解决能力,实现从"博闻强识"到"术业专攻"的跨越。

1.2 核心目标:适配任务与数据

- 任务适配:让大模型理解特定任务的目标,比如文本分类要区分情感正负、命名实体识别要精准提取实体类型,微调通过调整模型参数,强化模型对任务指令的响应逻辑。

- 数据适配:不同领域的数据有独特的词汇、表述和分布,微调使模型学习到当前数据的特征模式,例如法律文本中的专业术语、医疗报告的严谨表述,让模型输出更贴合领域需求。

二、经典微调方法详解

2.1 全量微调(Full Fine-Tuning)

- 技术原理:对预训练模型的所有参数(包括 Transformer 层、嵌入层等)进行更新,利用下游任务的标注数据,重新调整模型的权重,使模型全方位适配新任务。

- 优缺点分析

- 优点:能最大程度利用任务数据,对模型参数进行全面优化,在充足标注数据支持下,可取得很高的任务精度,适合数据丰富、追求极致性能的场景,如大规模文本分类竞赛。

- 缺点:计算成本极高,需要强大的 GPU 算力支持,大模型全量参数更新耗时久;容易过拟合,尤其是数据量较少时,模型可能过度学习训练数据的细节,泛化性下降;还可能"遗忘"预训练阶段的部分通用知识(灾难性遗忘问题)。

2.2 冻结层微调(Layer-Freezing Fine-Tuning)

- 技术原理:冻结预训练模型的部分层(通常是底层,因底层更多学习通用语法、基础语义),仅对顶层(如输出层、部分高层 Transformer 层)参数进行微调。利用顶层的灵活性适配新任务,底层保留通用知识。

- 优缺点分析

- 优点:降低计算量与显存占用,训练效率提升,适合算力有限或数据量适中的场景;一定程度缓解灾难性遗忘,底层保留的通用知识更稳定。

- 缺点:适配效果依赖冻结层与微调层的划分,若划分不合理(如冻结过多关键层),会限制模型对任务的适配能力,需要反复调试层数配置。

2.3 参数高效微调(Parameter-Efficient Fine-Tuning, PEFT)

-

技术分支与原理

-

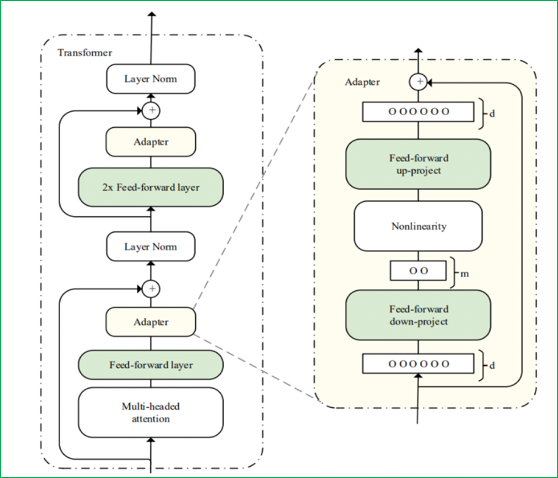

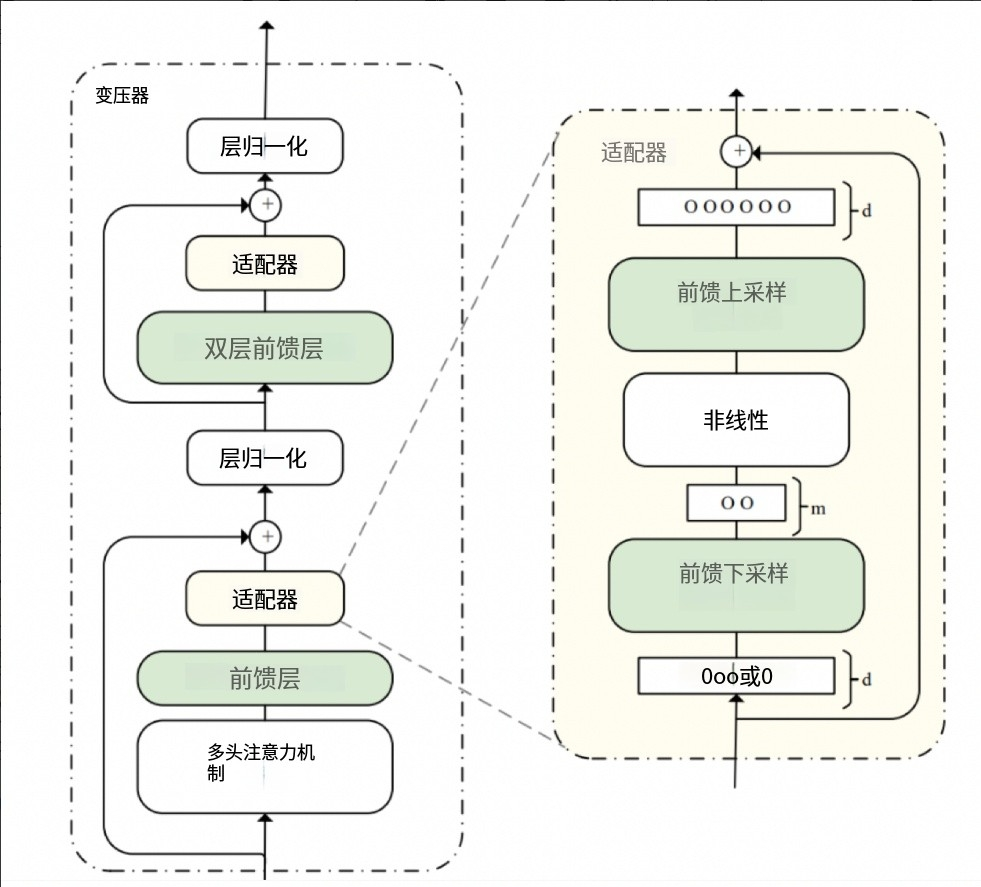

Adapter Tuning:在预训练模型中插入小型 Adapter 模块(如全连接层组成的瓶颈结构),仅训练 Adapter 的参数,模型主体参数冻结。Adapter 学习任务特定的特征转换,灵活适配任务。其结构通常包含down-project层(将高维度特征映射到低维特征)、非线性层和up-project结构(将低维特征映射回原来的高维特征),同时设计了skip-connection结构,确保在最差情况下能退化为identity(类似残差结构)。

-

LoRA(Low-Rank Adaptation):

数学原理:基于矩阵低秩分解理论,假设权重更新矩阵 ΔW 可分解为两个小矩阵的乘积:

Δ W = B × A ΔW = B × A ΔW=B×

-

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?