-

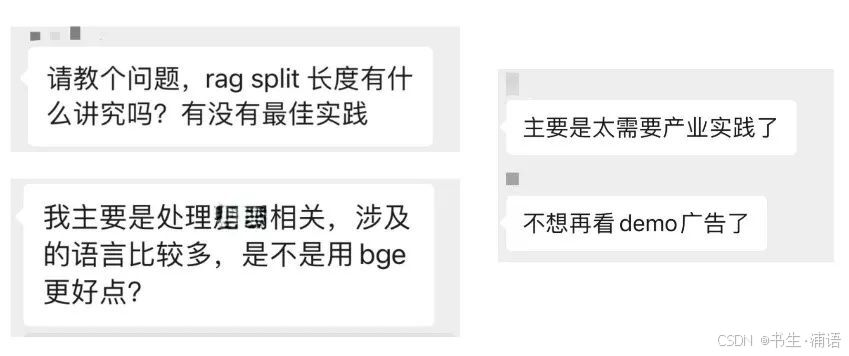

对 text2vec 来说,chunksize 选多大合适?

-

应该选择哪种 splitter ?

-

BCE 还是 BGE ?

面对这些 RAG 问题,本文根据 text2vec 模型原理做假设,并用 HuixiangDou 真实数据进行验证,最终给出 chunksize 上下界。

本文认为关键是让 tokenize 后的长度和模型输入(如 512)对齐,以发挥出模型完整编码能力。而 chunksize 只是 splitter 的附属选项。

相对于默认参数,精细调参可以改善约 2% 的 F1 指标;而用错 chunksize 可能导致 10% 下降。

相关测试数据、代码和说明文档已开源,如果对你有帮助,欢迎 star!

text2vec 和 autoencoder

现实世界中,很多数据是未标注、甚至无法标注的。我们希望神经网络同样能够理解这些数据,然后通过微调或调整结构“赋能”到下游任务。自编码器(autoencoder)就是这类无监督学习的一种范式。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

739

739

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?