引言

在现代机器学习中,梯度下降法(Gradient Descent)可谓无可替代的核心优化算法。它将连续函数的微积分思想与离散化的参数更新结合,实现了对海量模型参数的高效寻优。随着模型规模急剧扩大、硬件加速不断升级,梯度下降算法也不断演进,从最基础的批量梯度下降(BGD)到当下热门的自适应优化器( Adam、AdaGrad、RMSProp),再到分布式、二阶近似方法,其前沿研究和工业实践为 AI 发展提供了坚实支撑。本文将从核心原理、操作流程到经典代码及创新实现,全方位剖析梯度下降法的“根—干—枝”结构,并结合真实案例与行业数据进行对比与预测,为读者呈现一个既符合逻辑又充满超前思维的完整视角。

核心原理与操作流程

-

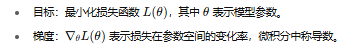

目标函数与梯度

-

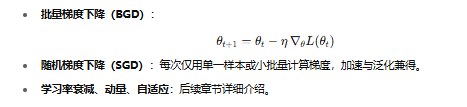

参数更新公式

-

-

操作流程

订阅专栏 解锁全文

订阅专栏 解锁全文

1945

1945

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?