来自 B 站刘二大人的《PyTorch深度学习实践》P8 的学习笔记

上一篇 PyTorch 加载数据集 中,我们实战了 MNIST 手写数据集的识别网络,那其实就是一个多分类问题(识别出 10 个类),这时候就要用 softmax,而不是 sigmoid 了。

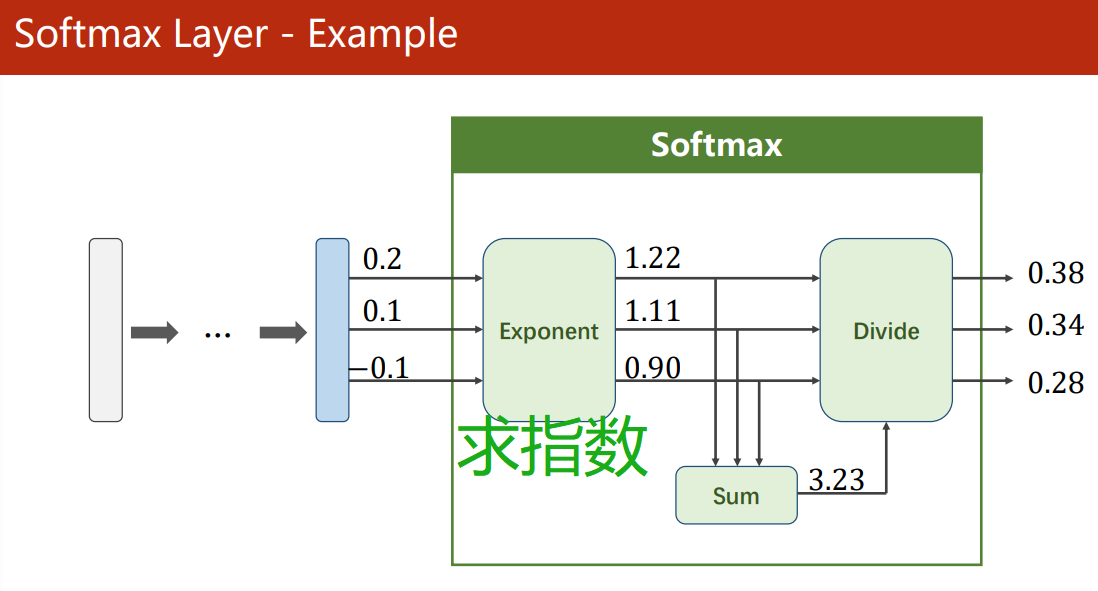

Softmax

Softmax 函数:

P ( y = i ) = e z i ∑ j = 0 K − 1 e z i , i ∈ { 0 , . . . , K − 1 } P(y = i) = \frac{e^{z_i}}{\sum^{K-1}_{j=0} e^{z_i}}, i \in \{ 0, ..., K - 1 \} P(y=i)=∑j=0K−1eziezi,i∈{

0,...,K−1}

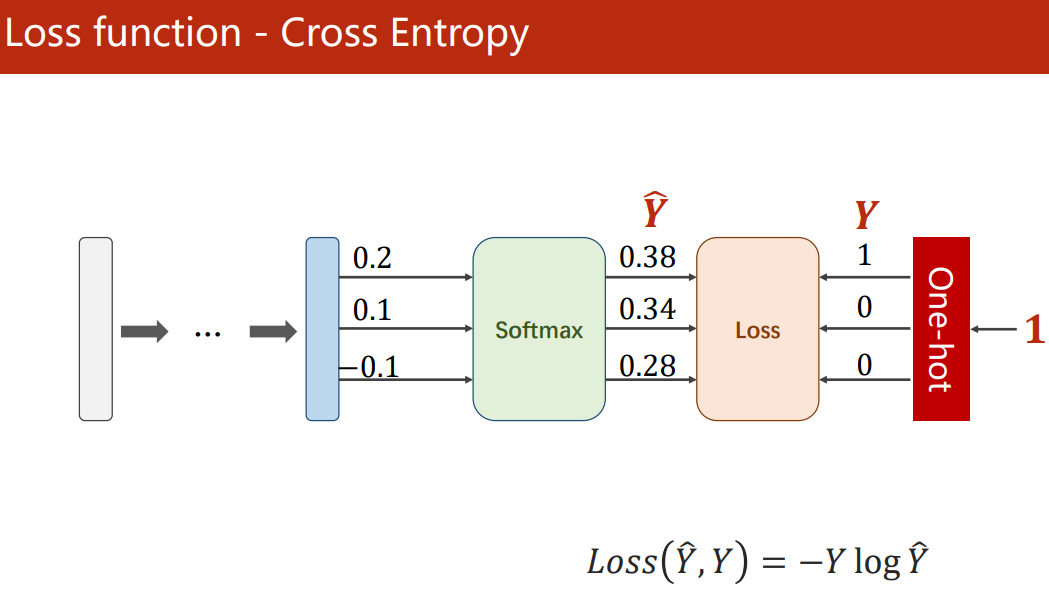

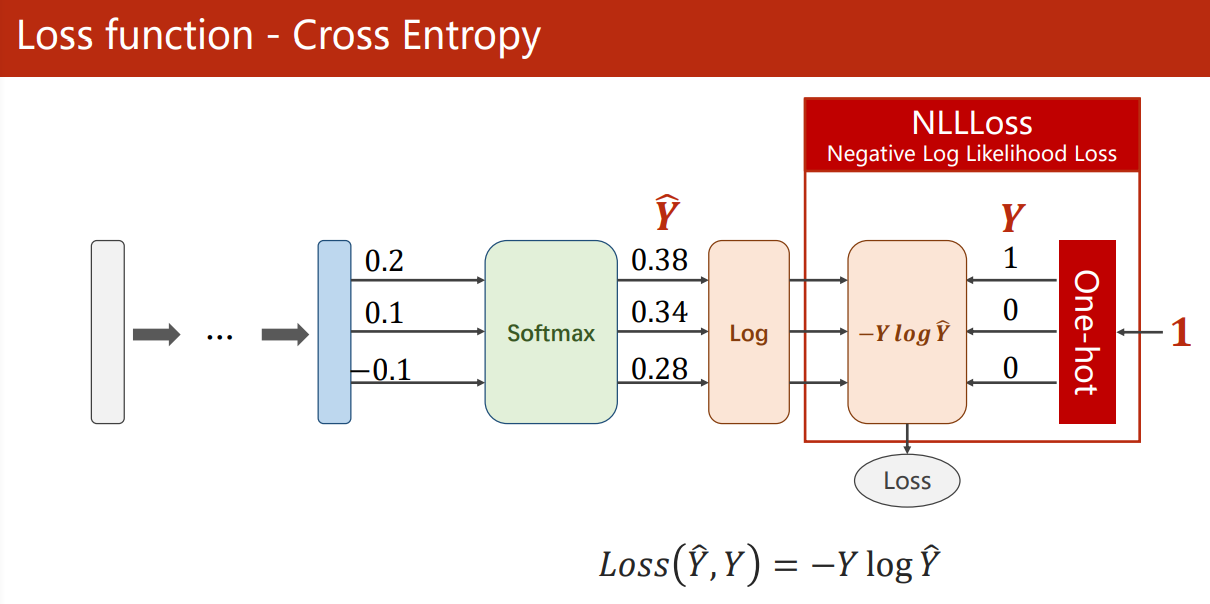

Cross Entropy

Cross Entropy:

Negative Log Likelihood Loss:

Cross Entropy in PyTorch:

这篇博客介绍了如何使用PyTorch进行深度学习实践,特别是针对MNIST数据集的预处理和CrossEntropyLoss在多分类问题中的应用。内容包括Softmax函数、CrossEntropy损失的计算以及数据预处理步骤,如PIL图像转换、N(0,1)归一化。此外,还展示了训练模型、测试模型和绘制预测结果的代码示例。

这篇博客介绍了如何使用PyTorch进行深度学习实践,特别是针对MNIST数据集的预处理和CrossEntropyLoss在多分类问题中的应用。内容包括Softmax函数、CrossEntropy损失的计算以及数据预处理步骤,如PIL图像转换、N(0,1)归一化。此外,还展示了训练模型、测试模型和绘制预测结果的代码示例。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4万+

4万+