论文链接:https://arxiv.org/abs/2102.09844

- 一种新模型来学习与旋转、平移、反射和排列等变的图神经网络,称为 E(n)-等变图神经网络 (EGNN)

尽管深度学习在很大程度上取代了手工制作的特征,但许多进步严重依赖于深度神经网络中的归纳偏差。(inductive bias)

将神经网络限制为和研究问题相关函数的一种有效方法是,利用问题的对称性、变换等变性(equivariance),通过研究某个对称组来简化当前问题的计算。

- CNN的卷积是等变形、池化是近似不变性;

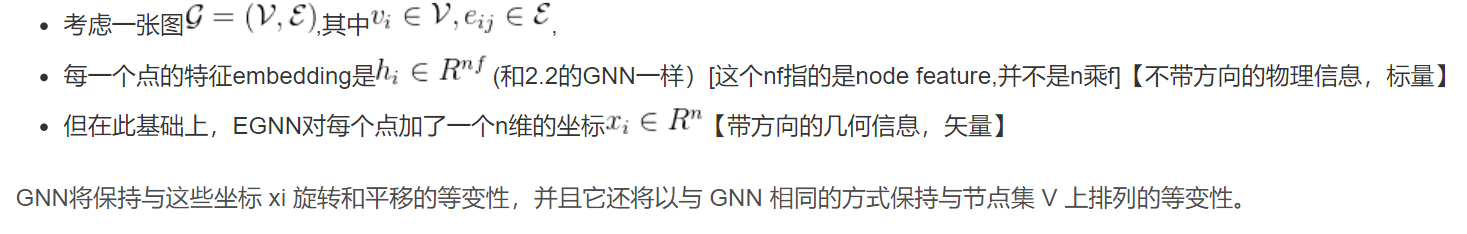

- GNN的点的排列顺序是等变性(不同点的排列对应不同的邻接矩阵,但是最终这张graph表达的信息是一样的)

许多问题都表现出 3D 平移和旋转对称性

- 这些对称操作的集合记为SE(3) ,如果包含反射,那么集合记为 E(3)。 通常希望对这些任务的预测相对于 E(3) 变换是等变的或不变的。

最近,已经提出了等变E(3) 或 SE(3) 的各种形式和方法。 其中许多工作在研究中间网络层的高阶表示类型方面实现了创新。 然而,这些高阶表示的转换需要计算成本高昂的系数或近似值。 此外,在实践中,对于许多类型的数据,输入和输出仅限于标量值(例如温度或能量,在文献中称为 type-0)和 3D矢量(例如速度或动量,在文献中称为 type-1)

它是平移、旋转和反射等变 (E(n)),以及关于输入点集的置换等变。 模型比以前的方法更简单,同时模型中的等变性不限于 3 维空间,并且可以扩展到更大的维空间,而不会显着增加计算量。

文章介绍了一种名为E(n)-等变图神经网络(EGNN)的新模型,该模型旨在处理旋转、平移、反射等变换。论文探讨了等变性和不变性的概念,特别是对于3D空间中的问题。EGNN模型比先前的方法更简单,且能扩展到高维空间。文章还讨论了不同类型的等变性,如平移、旋转和反射,以及置换等变性和不变性在图神经网络中的作用。此外,文章提到了基于不可约表示和正则表示的模型,如TFN和LieTransformer,以及它们在处理几何信息时的挑战和优势。

文章介绍了一种名为E(n)-等变图神经网络(EGNN)的新模型,该模型旨在处理旋转、平移、反射等变换。论文探讨了等变性和不变性的概念,特别是对于3D空间中的问题。EGNN模型比先前的方法更简单,且能扩展到高维空间。文章还讨论了不同类型的等变性,如平移、旋转和反射,以及置换等变性和不变性在图神经网络中的作用。此外,文章提到了基于不可约表示和正则表示的模型,如TFN和LieTransformer,以及它们在处理几何信息时的挑战和优势。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1502

1502

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?