OpenFOAMGPT团队 投稿

量子位 | 公众号 QbitAI

又一专业领域成功引入AI工程师!

而且还是基于DeepSeek、Qwen等国产大模型打造,国内研究人员都能用的那种。

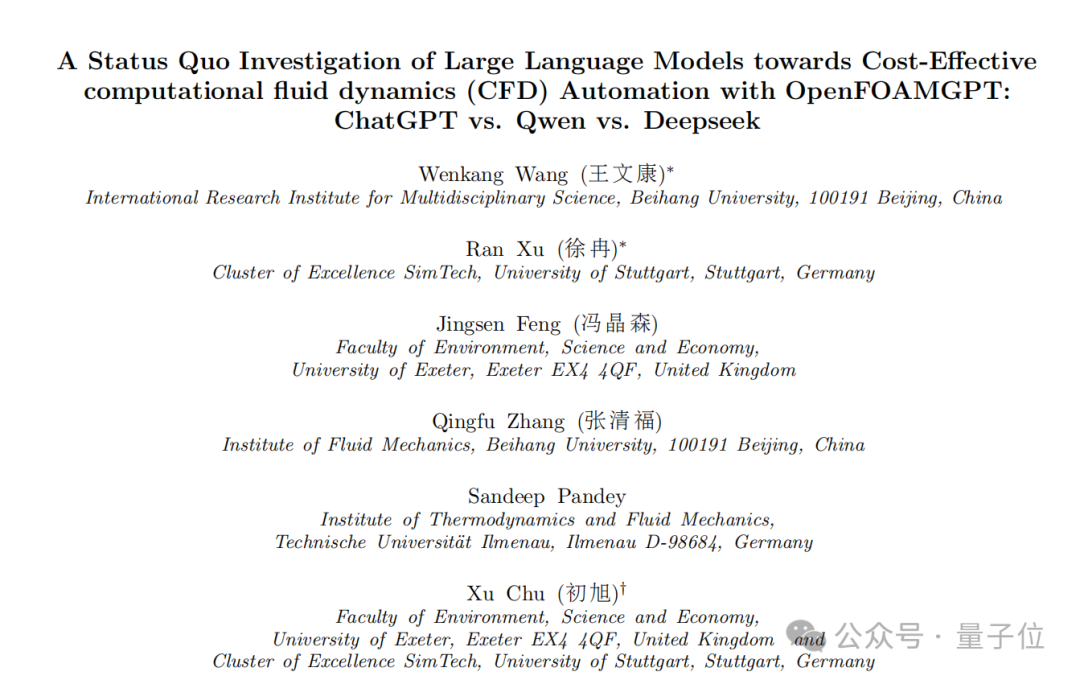

不卖关子了,这就是由英国埃克塞特大学初旭副教授团队与北航王文康副教授团队联合打造的OpenFOAMGPT,将AI工程师成功引入计算流体力学(CFD)领域。

作为一门介于数学、流体力学和计算机之间的交叉学科,CFD主要研究如何通过计算机和数值方法来求解流体力学的控制方程,对流体力学问题进行模拟和分析。

而两位华人副教授领衔的这项研究,主要贡献在于:通过使用国产模型将相关成本狠狠打下来了。

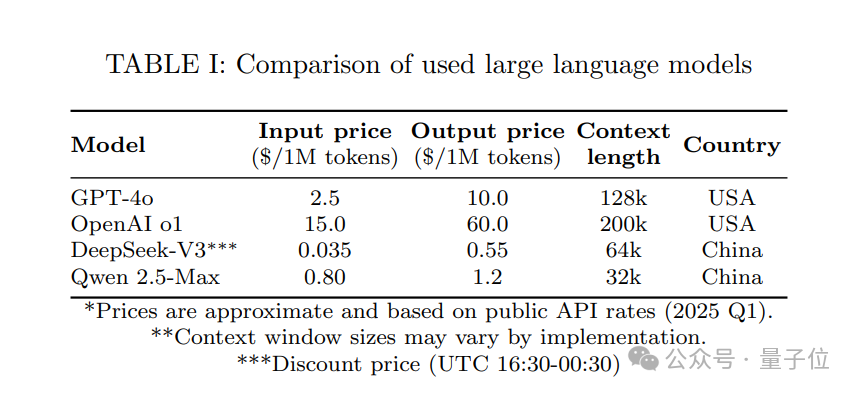

在保持相近性能的前提下,国产的DeepSeek V3和Qwen 2.5-Max与国外顶级商业模型相比,可实现高达100倍的成本节约。

并且还支持本地化部署,团队使用QwQ-32B模型成功实现了本地化运行。

具体咋回事儿?下面详细来看。

基于国产模型的AI CFD工程师

整体而言,在将AI工程师引入CFD领域这件事上,团队这次主要实现了“国产化替代”,并探索了在单GPU环境下的本地部署方案。

一切的一切,都是为了实现降低成本这一核心目标。

据了解,CFD领域的网格划分、边界条件设置、求解器选择等工作通常需要专业工程师投入大量时间,且操作过程中容错空间极小。

而在之前的研究中,初旭团队开发的OpenFOAMGPT已经能够实现,让研究者通过简单自然语言(如“构建三维湍流气泡上浮模型”或“将湍流模型从k-ε切换到LES”等),自动生成并修正相应的OpenFOAM代码。

这一方式显著降低了CFD仿真的使用门槛,不过当时OpenFOAMGPT使用的还是GPT-4o和o1模型,不仅价格昂贵,而且不便于国内研究者使用。

于是这次,两个团队联合推出最新版OpenFOAMGPT,成功整合了两款领先的国产大语言模型:

DeepSeek V3(671B)

Qwen 2.5-Max:通义千问旗舰版模型

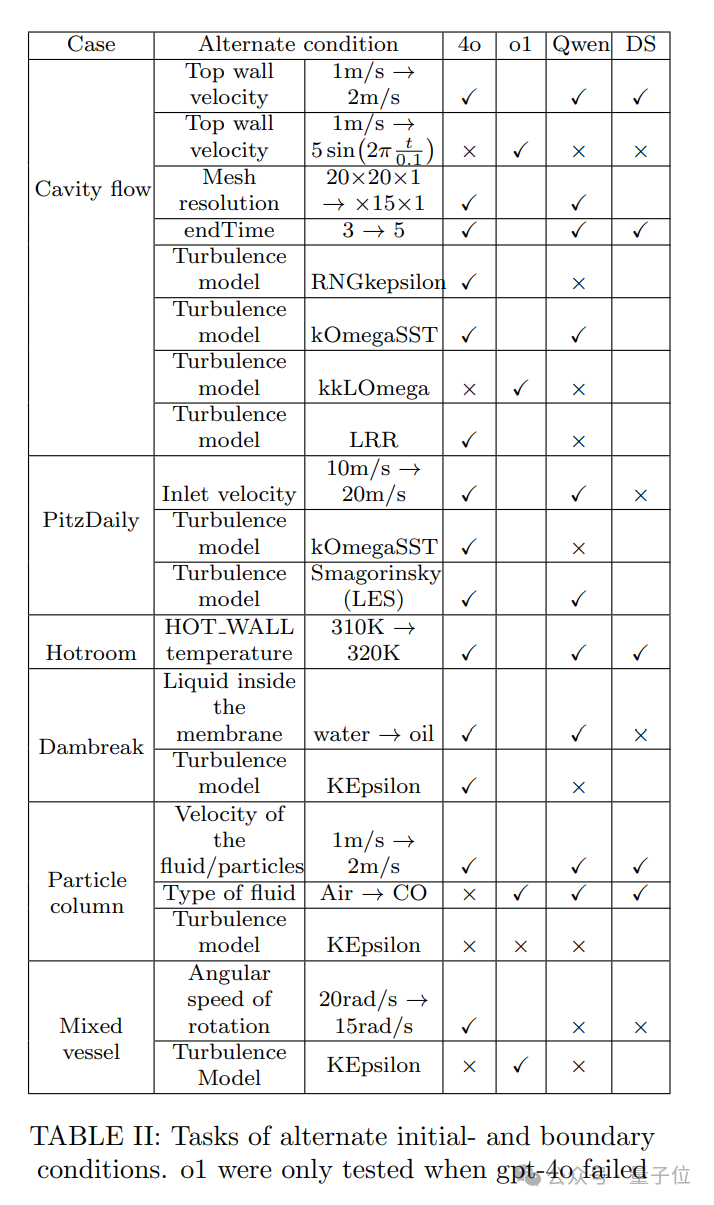

加上之前的GPT-4o和o1模型,团队接下来进行了一系列zero shot的CFD案例测试,包括falling droplets和rising bubble等经典复杂场景。

模型价格和实验表现如下:

研究结果表明,在保持相近性能的前提下,国产的DeepSeek V3和Qwen 2.5-Max与国外顶级商业模型相比,可实现高达100倍的成本节约,为科研机构与中小企业提供了更具经济性的技术选择。

此外,团队还成功尝试了本地部署方案,使用QwQ-32B模型实现本地化运行。

团队表示,虽然目前大语言模型在CFD自动化应用中仍面临挑战,但未来可从模型微调、多模态融合等方向改进,以实现更高效的CFD解决方案。

团队介绍

如开头所言,这项研究由英国埃克塞特大学初旭副教授与北航王文康副教授领衔,其余作者包括:

徐冉:初旭团队德国斯图加特大学博士生,共同第一作者

冯晶森:初旭团队埃克塞特大学博士生

张清福:北京航空航天大学流体力学研究所

Sandeep Pandey:初旭团队毕业博士

团队表示,这项研究的重要意义在于:

1、降低专业门槛:OpenFOAMGPT让非专业人员能够通过自然语言描述需求,无需深入学习复杂的OpenFOAM命令与参数,即可完成基础案例构建与优化调整。

2、成本与灵活性优化:不同规模的用户群体可根据精度需求、上下文要求和预算限制,灵活选择DeepSeek或Qwen模型,甚至可选择在本地环境部署小型模型进行试验。

3、跨领域应用前景:该技术框架有望与Ansys、COMSOL等主流CAE软件深度融合,进一步拓展AI在自动化仿真、并行参数调优和实时优化等领域的应用空间。

4、人机协作的价值:研究团队强调,鉴于CFD问题本身的物理复杂性和大语言模型生成内容的不确定性,专业人员的监督与审核仍是保障模拟准确性和数值稳定性的关键环节。

更多细节欢迎查阅原论文。

论文:

https://arxiv.org/abs/2504.02888

21

21

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?