诸神缄默不语-个人优快云博文目录

诸神缄默不语的论文阅读笔记和分类

论文名称:Adaptable and Interpretable Neural Memory Over Symbolic Knowledge

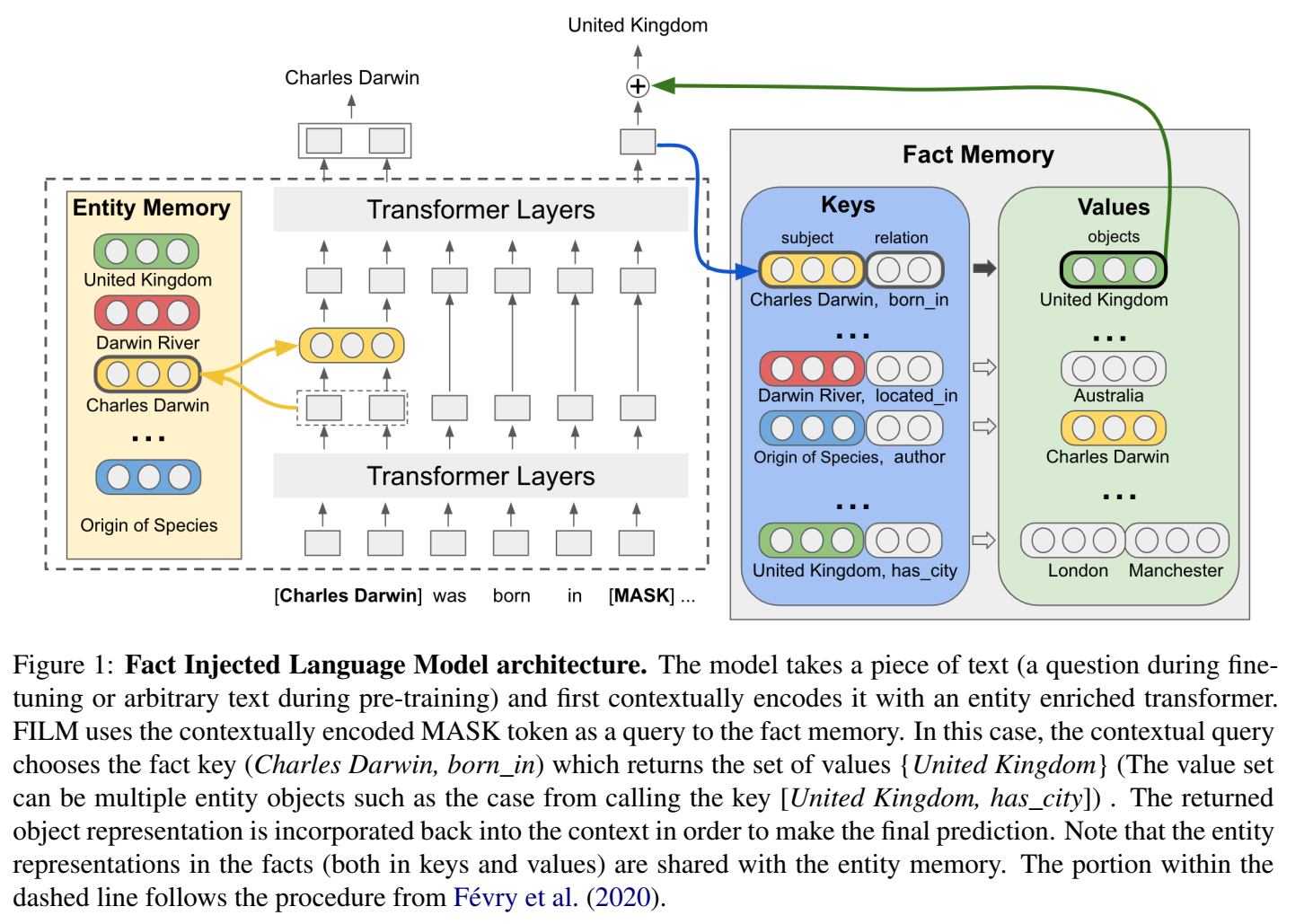

模型名称:Fact Injected Language Model (FILM)

NAACL版网址:https://aclanthology.org/2021.naacl-main.288/

本文是2021年NAACL论文,作者来自谷歌。

这篇论文解决的也是LM中信息更新难(需要改数据重新训练)的问题,提出了可解释的神经符号知识库fact memory,每个元素来自一个三向量组(每个向量对应一个知识库实体或关系)。

entity memory

FILM:masked LM

总之就是这种堆叠的模型……

这篇论文看起来太堆叠了,没什么值得我现在研究的trick,而且是谷歌论文(谷歌的论文普遍晦涩难懂),所以没有仔细看。

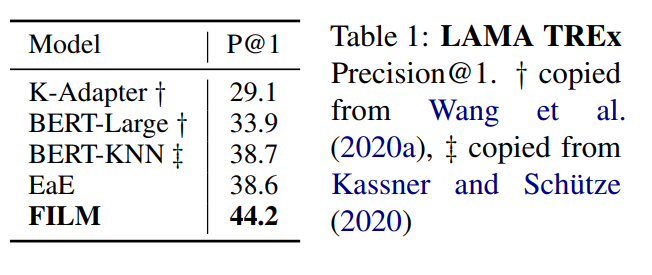

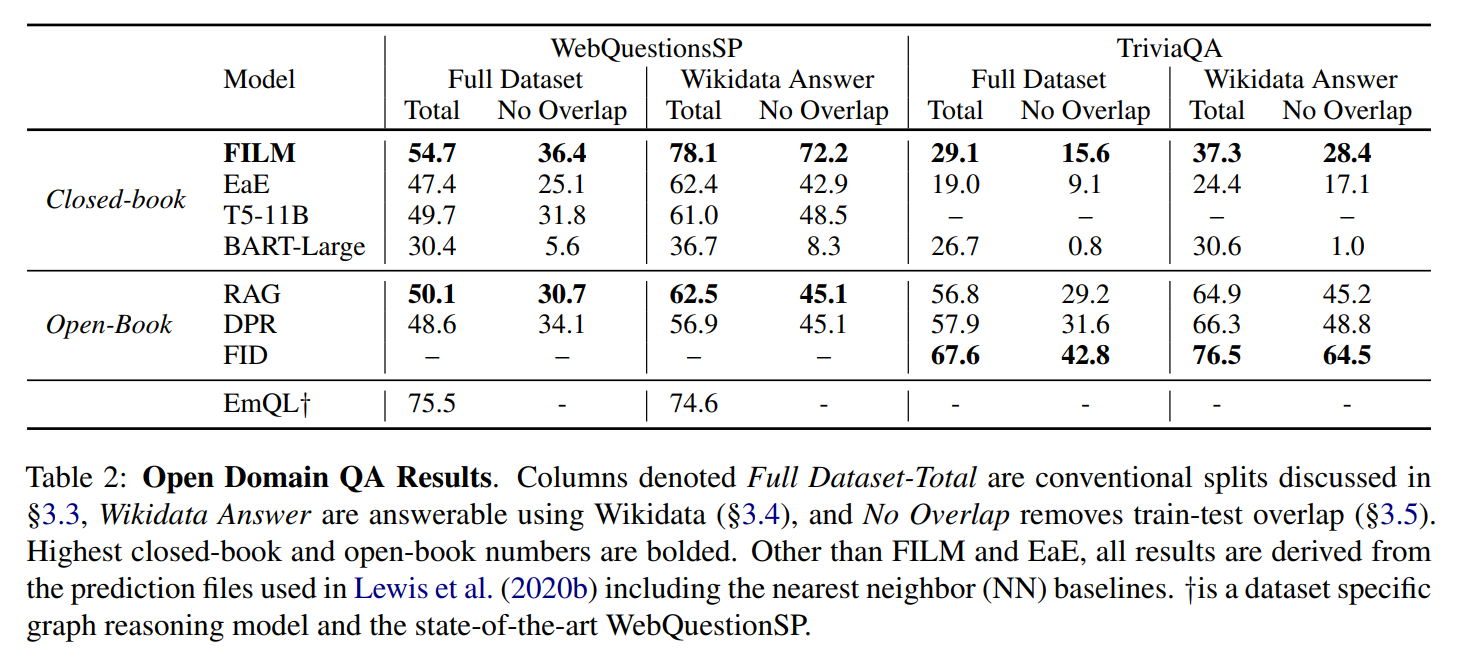

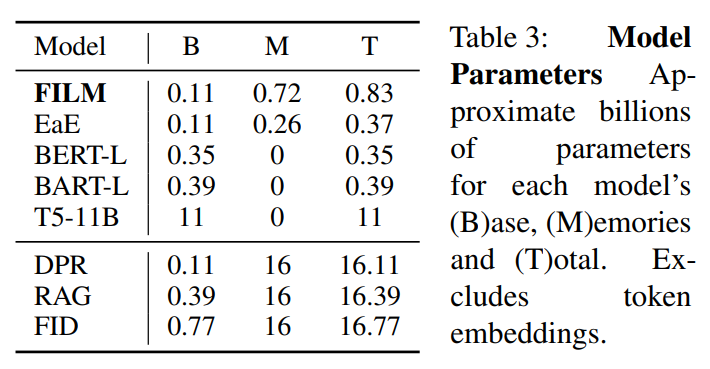

实验

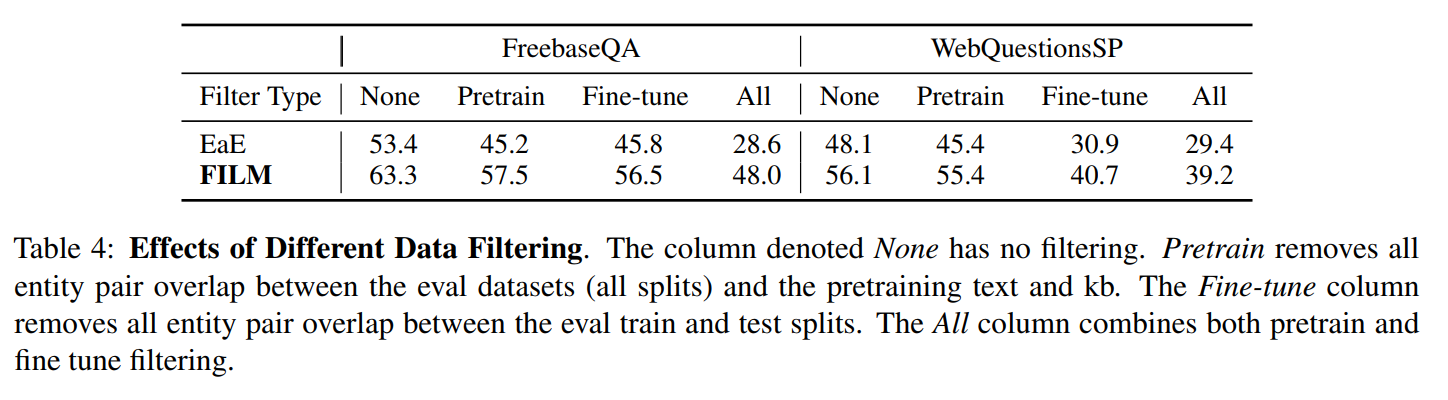

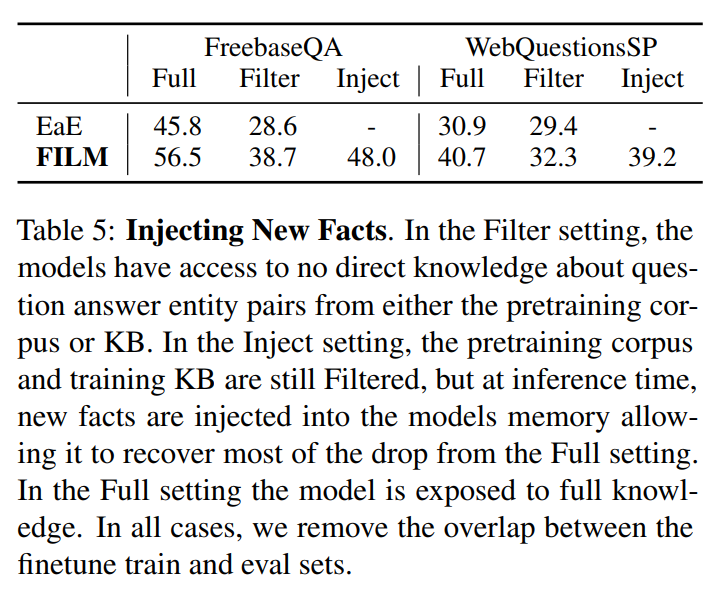

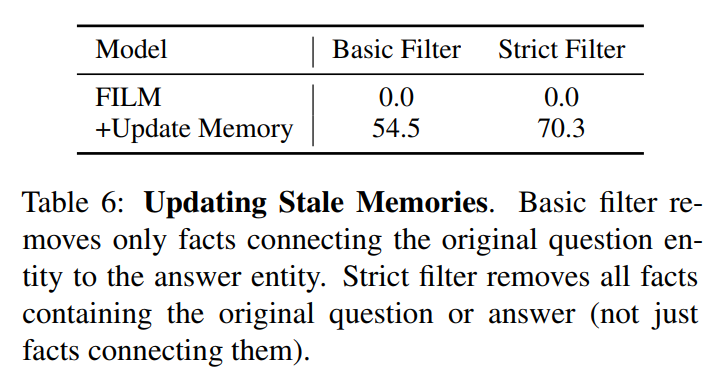

这个是考虑到训练集使用数据的问题:

这篇2021年NAACL的谷歌论文探讨了适应性和可解释性的神经记忆模型FILM,用于解决语言模型中信息更新的问题。论文提出了一种知识库结构,通过三向量组表示实体和关系,以提高模型的解释性。作者认为模型虽然复杂但缺乏新颖技巧,且谷歌论文通常难以理解,因此未深入研究。

这篇2021年NAACL的谷歌论文探讨了适应性和可解释性的神经记忆模型FILM,用于解决语言模型中信息更新的问题。论文提出了一种知识库结构,通过三向量组表示实体和关系,以提高模型的解释性。作者认为模型虽然复杂但缺乏新颖技巧,且谷歌论文通常难以理解,因此未深入研究。

1118

1118

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?