PyTorch官方教程网址:Welcome to PyTorch Tutorials — PyTorch Tutorials 1.11.0+cu102 documentation

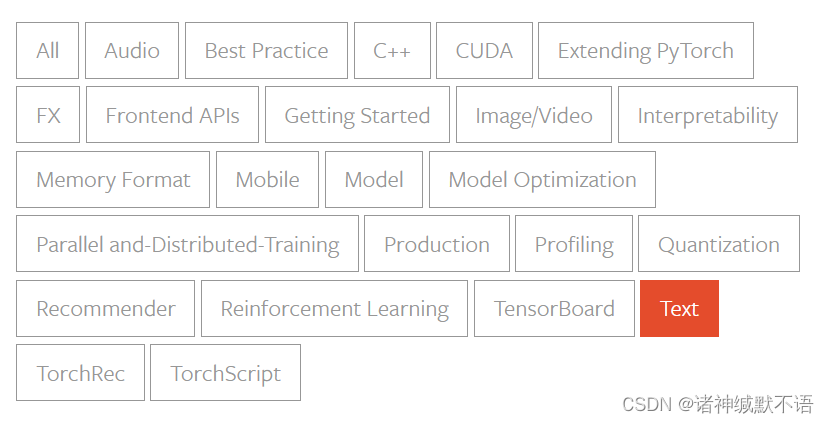

PyTorch官方教程首页可选Text(文本)主题:

该主题下的教程就是文本处理、自然语言处理领域的教程。

本文是对作者撰写各教程相应笔记所对应的目录。以下目录将随着写作过程更新笔记链接。

- 使用

nn.Transformer和torchtext建立seq2seq模型。原教程:Language Modeling with nn.Transformer and TorchText — PyTorch Tutorials 1.11.0+cu102 documentation - 使用character-level RNN实现名字分类模型。原教程:NLP From Scratch: Classifying Names with a Character-Level RNN — PyTorch Tutorials 1.11.0+cu102 documentation

- 使用character-level RNN实现名字生成模型。原教程:NLP From Scratch: Generating Names with a Character-Level RNN — PyTorch Tutorials 1.11.0+cu102 documentation

- 使用seq2seq网络和attention机制实现翻译模型。原教程:NLP From Scratch: Translation with a Sequence to Sequence Network and Attention — PyTorch Tutorials 1.11.0+cu102 documentation

- 使用torchtext库实现文本分类(情感分类)模型。原教程:Text classification with the torchtext library — PyTorch Tutorials 1.11.0+cu102 documentation

- 使用

nn.Transformer和torchtext实现翻译模型。原教程:Language Translation with nn.Transformer and torchtext — PyTorch Tutorials 1.11.0+cu102 documentation - 在LSTM-based next word-prediction model上应用dynamic quantization1。原教程:(beta) Dynamic Quantization on an LSTM Word Language Model — PyTorch Tutorials 1.11.0+cu102 documentation

- 在BERT上应用dynamic quantization1。原教程:(beta) Dynamic Quantization on BERT — PyTorch Tutorials 1.11.0+cu102 documentation

除PyTorch官方教程目录下文本主题的教程之外,还有torchtext包的官方教程:用XLM-RoBERTa模型进行SST-2二分类任务。原教程:SST-2 Binary text classification with XLM-RoBERTa model — torchtext 0.12.0 documentation

对dynamic quantization的介绍可参考我所撰写的对PyTorch官方教程的学习笔记:Dynamic Quantization PyTorch官方教程学习笔记_诸神缄默不语的博客-优快云博客 ↩︎ ↩︎

本文提供了一份PyTorch官方文本处理教程的目录,包括使用nn.Transformer和torchtext构建seq2seq模型,用RNN进行名字分类和生成,seq2seq网络和注意力机制的翻译模型,torchtext的文本分类,以及Transformer的翻译模型。还介绍了如何在LSTM和BERT上应用dynamic quantization,并给出了动态量化学习笔记的链接。此外,还涉及了使用XLM-RoBERTa进行SST-2二分类任务。

本文提供了一份PyTorch官方文本处理教程的目录,包括使用nn.Transformer和torchtext构建seq2seq模型,用RNN进行名字分类和生成,seq2seq网络和注意力机制的翻译模型,torchtext的文本分类,以及Transformer的翻译模型。还介绍了如何在LSTM和BERT上应用dynamic quantization,并给出了动态量化学习笔记的链接。此外,还涉及了使用XLM-RoBERTa进行SST-2二分类任务。

1084

1084

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?