Towards Lightest Low-Light Image Enhancement Architecture for Mobile Devices(2025 ESWA)

该论文提出了一种名为 LiteIE 的超轻量级无监督低光图像增强框架,旨在解决移动设备等资源受限平台上实时低光图像增强的需求,在保证视觉质量的同时大幅提升计算效率。参考资料如下:

[1]. 论文地址

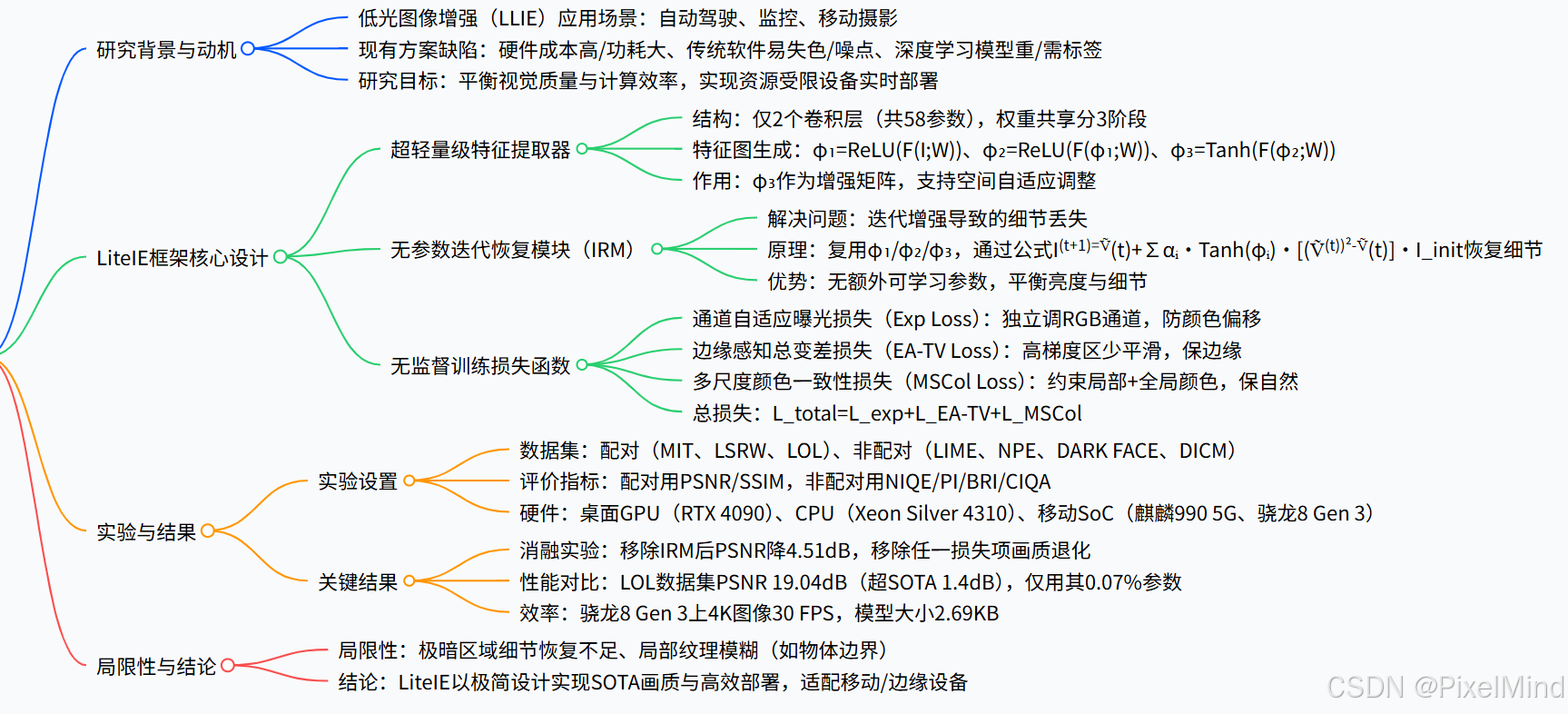

论文整体结构思维导图如下:

专题介绍

在低光照环境下,传统成像设备往往因画面昏暗、细节丢失而受限。LLIE(低照度暗光增强)技术应运而生,它通过提升图像亮度、对比度,减少噪点并恢复色彩细节,让暗夜变得清晰可见。

LLIE技术从传统方法如直方图均衡化、Retinex模型等起步,近年来借助深度学习,尤其是卷积神经网络(CNN),GAN模型,扩散模型实现了质的飞跃。这些算法能自动学习图像特征,精准处理低光照图像,效果显著优于传统技术。

本专题将聚焦LLIE技术的核心原理、应用案例及最新进展,让我们一起见证LLIE如何点亮暗夜,开启视觉新视界!欢迎一起探讨交流!

系列文章如下

【1】ZeroDCE

【2】HVI

【3】CLIP-LIT

【4】GLARE

【5】Retinexformer

【6】SG-LLIE

【7】GPP-LLIE

【8】FusionNet

【9】EnligtenGAN

【10】PTG

【11】CSNorm

【12】SG-LLIE结构提取方案

【13】SAIGFormer

【14】BEM

【15】SKF

【16】SIED

【17】LYT-Net

【18】GT-Mean Loss

【19】SCI

【20】IAGC

一、研究背景

低光图像增强(LLIE)在自动驾驶、监控、移动摄影等领域至关重要,但低光图像常存在可见度差、对比度低、噪声多、色彩失真等问题。

- 现有解决方案存在不足:硬件方法成本高、功耗大;传统软件方法易放大噪声或导致色彩偏移;

- 深度学习方法虽有进展,但多数依赖大型网络和带标签数据集,参数与计算成本高,难以在资源受限设备上部署。

因此本文提出了一种轻量化无监督暗光增强方案。

二、方法

1.核心模块设计

LiteIE 整体架构包含轻量级特征提取器与无参数迭代恢复模块(IRM) 两大核心组件,二者协同实现“从粗到精”的低光图像增强,具体结构与原理如下:

(一)轻量级特征提取器:极简结构实现多尺度特征捕捉

该模块(上图黄框部分)是 LiteIE 轻量化的核心,通过“权重共享+双卷积层”设计,仅用58个参数即可提取图像多尺度特征,并生成用于增强的核心矩阵,具体设计如下:

-

结构设计:

采用“压缩-重构”双卷积层结构,通道配置为3-1-3(即Conv₃×₃³→¹与Conv₃×₃¹→³):- 第一步(压缩):通过3×3卷积将输入RGB图像(3通道)压缩至1通道,减少冗余信息,聚焦关键光照特征;

- 第二步(重构):再通过3×3卷积将1通道特征重构回3通道,恢复颜色维度,同时保留压缩过程中提取的光照信息;

- 权重共享:上述双卷积层在整个特征提取过程中重复使用3次,避免新增参数,仅通过激活函数差异实现多尺度特征捕捉。

-

特征生成流程:

输入低光图像 I I I 经共享权重算子 F ( ⋅ ; W ) \mathcal{F}(\cdot; W) F(⋅;W)(含卷积、批归一化、恒等激活)处理,生成3组递进式特征图 ϕ 1 \phi_1 ϕ1、 ϕ 2 \phi_2 ϕ2、 ϕ 3 \phi_3 ϕ3,数学公式为:

ϕ ( I ) : { ϕ 1 = R e L U ( F ( I ; W ) ) ϕ 2 = R e L U ( F ( ϕ 1 ; W ) ) ϕ 3 = T a n h ( F ( ϕ 2 ; W ) ) \phi (I):\left\{ \begin{array} {l} \phi _{1}=ReLU(\mathcal {F}(I; W)) \\ \phi _{2}=ReLU\left( \mathcal {F}(\phi _ {1} ; W) \right) \\ \phi _ {3 } =Tanh\left( \mathcal {F}\left( \phi _ {2 } ; W\right) \right) \end{array} \right. ϕ(I):⎩ ⎨ ⎧ϕ1=ReLU(F(I;W))ϕ2=ReLU(F(ϕ1;W))ϕ3=Tanh(F(ϕ2;W))- ϕ 1 \phi_1 ϕ1(ReLU激活):捕捉基础低频特征,初步区分明暗区域;

- ϕ 2 \phi_2 ϕ2(ReLU激活):在 ϕ 1 \phi_1 ϕ1基础上深化特征,增强局部对比度信息;

- ϕ 3 \phi_3 ϕ3(Tanh激活):将特征值约束在[-1,1]区间,生成增强矩阵,用于后续空间自适应光照调整,避免过增强。

(二)无参数迭代恢复模块(IRM):细节保护的关键

迭代增强虽能逐步提升亮度,但易导致细节丢失(如天空云层模糊、物体边缘淡化)。IRM 模块通过复用特征+残差调整,在不新增参数的前提下恢复细节,具体设计如下:

-

设计逻辑:

复用特征提取器生成的 ϕ 1 \phi_1 ϕ1、 ϕ 2 \phi_2 ϕ2、 ϕ 3 \phi_3 ϕ3(含丰富语义细节),结合原始低光图像 I i n i t I_{init} Iinit 的结构信息,对迭代过程中的中间增强结果 I ~ ( t ) \tilde{I}^{(t)} I~(t)进行残差校准,平衡亮度提升与细节保留。 -

恢复流程:

数学公式为:

I ( t + 1 ) = I ~ ( t ) + ∑ i = 1 3 α i ⋅ T a n h ( ϕ i ) ⋅ ( ( I ~ ( t ) ) 2 − I ~ ( t ) ) ⋅ I i n i t I^{(t+1)}=\tilde{I}^{(t)}+\sum_{i=1}^{3} \alpha_{i} \cdot Tanh\left(\phi_{i}\right) \cdot\left(\left(\tilde{I}^{(t)}\right)^{2}-\tilde{I}^{(t)}\right) \cdot I_{init } I(t+1)=I~(t)+i=1∑3αi⋅Tanh(ϕi)⋅((I~(t))2−I~(t))⋅Iinit- 中间增强结果 I ~ ( t ) \tilde{I}^{(t)} I~(t):由增强矩阵 ϕ 3 \phi_3 ϕ3调制生成,公式为 I ~ ( t ) = I ( t ) + ϕ 3 ⋅ ( ( I ( t ) ) 2 − I ( t ) ) \tilde{I}^{(t)}=I^{(t)}+\phi_3 \cdot\left(\left(I^{(t)}\right)^{2}-I^{(t)}\right) I~(t)=I(t)+ϕ3⋅((I(t))2−I(t)),其中 ( I ( t ) ) 2 − I ( t ) \left(I^{(t)}\right)^{2}-I^{(t)} (I(t))2−I(t)为非线性对比度增强项,亮区增强、暗区抑制;

- 特征复用与权重控制: α 1 \alpha_1 α1、 α 2 \alpha_2 α2、 α 3 \alpha_3 α3 为标量权重,分别控制 ϕ 1 \phi_1 ϕ1(基础结构)、 ϕ 2 \phi_2 ϕ2(局部细节)、 ϕ 3 \phi_3 ϕ3(光照特征)的贡献,自适应调整不同区域的恢复强度;

- 非线性校准:Tanh函数将特征调制值约束在[-1,1],确保残差调整平滑可控,避免引入噪声或 artifacts。

这里解释一下为什么

(

I

(

t

)

)

2

−

I

(

t

)

\left(I^{(t)}\right)^{2}-I^{(t)}

(I(t))2−I(t)为非线性对比度增强

数学层面:非线性函数的本质属性

图像像素值

I

(

t

)

I^{(t)}

I(t) 通常被归一化到

[

0

,

1

]

[0,1]

[0,1] 区间(0代表纯黑,1代表纯白)。对该区间内的

I

(

t

)

I^{(t)}

I(t)而言,

(

I

(

t

)

)

2

−

I

(

t

)

(I^{(t)})^{2} - I^{(t)}

(I(t))2−I(t)是一个二次函数(非线性函数的典型形式),其表达式可变形为

I

(

t

)

(

I

(

t

)

−

1

)

I^{(t)}(I^{(t)} - 1)

I(t)(I(t)−1)。

- 当 I ( t ) ∈ [ 0 , 1 ] I^{(t)} \in [0,1] I(t)∈[0,1] 时,该函数的取值范围为 [ − 0.25 , 0 ] [-0.25, 0] [−0.25,0],且函数曲线呈现“先降后升”的非线性趋势(顶点在 I ( t ) = 0.5 I^{(t)}=0.5 I(t)=0.5处,此时值为 − 0.25 -0.25 −0.25)。

- 相比线性函数(如 a ⋅ I ( t ) + b a \cdot I^{(t)} + b a⋅I(t)+b)仅能对像素值进行“均匀缩放/偏移”,这种二次函数的非线性特性,使其能对不同亮度区间的像素值产生差异化调整效果。

2.无监督训练策略:保证增强自然性

LiteIE 采用无监督训练(无需配对低光/正常光图像),设计三类损失函数组合,约束增强图像的曝光、边缘、颜色质量,总损失公式为 L t o t a l = L e x p + L E A − T V + L M S C o l \mathcal{L}_{total }=\mathcal{L}_{exp }+\mathcal{L}_{EA-TV }+\mathcal{L}_{MSCol } Ltotal=Lexp+LEA−TV+LMSCol:

(一)通道自适应曝光损失( L e x p \mathcal{L}_{exp} Lexp):避免过/欠曝光

针对不同颜色通道对光照的敏感度差异,独立调整RGB通道曝光,公式为:

L

e

x

p

=

∑

(

M

R

′

−

α

r

0

C

0

)

2

+

∑

(

M

G

′

−

α

g

0

C

0

)

2

+

∑

(

M

B

′

−

α

b

0

C

0

)

2

\begin{aligned} \mathcal{L}_{exp }= & \sum\left(M_{R}'-\alpha r_{0} C_{0}\right)^{2}+\sum\left(M_{G}'-\alpha g_{0} C_{0}\right)^{2} \\ & +\sum\left(M_{B}'-\alpha b_{0} C_{0}\right)^{2} \end{aligned}

Lexp=∑(MR′−αr0C0)2+∑(MG′−αg0C0)2+∑(MB′−αb0C0)2

- M R ′ M_R' MR′、 M G ′ M_G' MG′、 M B ′ M_B' MB′:增强图像RGB通道的均值;

- r 0 r_0 r0、 g 0 g_0 g0、 b 0 b_0 b0:原始图像RGB通道的归一化比例,确保颜色比例与原始一致;

- C 0 C_0 C0:chromatic 一致性因子( C 0 = 1 − ( r 0 − 1 3 ) 2 + ( g 0 − 1 3 ) 2 + ( b 0 − 1 3 ) 2 C_0=1-\sqrt{(r_0-\frac{1}{3})^{2}+(g_0-\frac{1}{3})^{2}+(b_0-\frac{1}{3})^{2}} C0=1−(r0−31)2+(g0−31)2+(b0−31)2),衡量颜色分布平衡度,避免偏色;

- α \alpha α:曝光缩放参数(最优值0.8),控制整体亮度增益,防止过曝光。

(二)边缘感知总变差损失( L E A − T V \mathcal{L}_{EA-TV} LEA−TV):保护边缘结构

改进传统TV损失过度平滑的问题,通过边缘权重自适应调整平滑强度,公式为:

L

E

A

−

T

V

=

∑

w

h

∥

∇

h

x

∥

2

+

∑

w

w

∥

∇

w

x

∥

2

{\mathcal L}_{EA-TV}=\sum w_{h}\| \nabla _{h}x\| ^{2}+\sum w_{w}\| \nabla _{w}x\| ^{2}

LEA−TV=∑wh∥∇hx∥2+∑ww∥∇wx∥2

- ∇ h x \nabla_h x ∇hx、 ∇ w x \nabla_w x ∇wx:图像水平、垂直梯度;

- w = e − β ∣ ∇ x ∣ w=e^{-\beta|\nabla x|} w=e−β∣∇x∣:边缘感知权重( β \beta β最优值0.4),高梯度区域(边缘)权重小、平滑弱,低梯度区域(平坦区)权重高、平滑强,既抑制噪声又保护边缘。

(三)多尺度颜色一致性损失( L M S C o l \mathcal{L}_{MSCol} LMSCol):颜色自然无偏移

同时约束局部与全局颜色,避免“局部偏色”或“全局色移”,公式为:

L

M

S

C

o

l

=

∑

c

∈

{

r

,

g

,

b

}

(

M

l

o

c

a

l

c

−

M

l

o

c

a

l

,

o

r

i

g

c

)

2

+

∑

c

∈

{

r

,

g

,

b

}

(

M

g

l

o

b

a

l

c

−

M

r

e

f

c

)

2

\begin{aligned} \mathcal{L}_{MSCol }= & \sum_{c \in\{r, g, b\}}\left(M_{local }^{c}-M_{local, orig }^{c}\right)^{2} \\ & +\sum_{c \in\{r, g, b\}}\left(M_{global }^{c}-M_{ref }^{c}\right)^{2} \end{aligned}

LMSCol=c∈{r,g,b}∑(Mlocalc−Mlocal,origc)2+c∈{r,g,b}∑(Mglobalc−Mrefc)2

- 局部约束: M l o c a l c M_{local }^{c} Mlocalc(增强图像局部颜色均值)与 M l o c a l , o r i g c M_{local, orig }^{c} Mlocal,origc(原始图像局部颜色均值)匹配,确保区域颜色一致性(如皮肤色、天空蓝不偏移);

- 全局约束: M g l o b a l c M_{global }^{c} Mglobalc(增强图像全局颜色均值)与 M r e f c M_{ref }^{c} Mrefc(参考颜色均值)匹配,保证整体颜色平衡,避免全局偏蓝/偏红。

消融验证:移除任何一类损失均会导致性能下降——无 L M S C o l \mathcal{L}_{MSCol} LMSCol会引发严重颜色偏移,无 L e x p \mathcal{L}_{exp} Lexp图像偏暗,无 L E A − T V \mathcal{L}_{EA-TV} LEA−TV产生边缘 artifacts。

三、实验结果

1.定量实验结果

定量实验通过与Zero-DCE、Zero-DCE++、RUAS、SCI等10余种主流低光图像增强方法对比,验证LiteIE在精度与效率上的优势,核心结果如下:

- 关键结论:LiteIE的PSNR较现有SOTA方法(如RUAS)提升2.64 dB,较Zero-DCE提升4.07 dB;仅使用Zero-DCE 0.07%的参数,模型大小为其1/11,GPU帧率为其1.96倍,实现“精度+效率”双重领先。

2. 多数据集泛化性(MIT、LSRW系列)

- 关键结论:LiteIE在所有配对数据集上的PSNR、SSIM均排名第一,尤其在LSRW-Huawei数据集上,PSNR较第二名CLIP-LIT(18.22)提升0.32 dB,证明其对不同设备拍摄的低光图像均有强适配性。

3. 无参考指标表现(无配对数据集)

在LIME、NPE、DARK FACE、DICM四组无配对数据集上,LiteIE的平均PI(2.61)、NIQE(3.74)、BRI(15.98)均为最低,平均CIQA(0.58)为最高,优于Zero-DCE(平均PI 2.73、NIQE 3.80)、SCI(平均PI 2.93、NIQE 4.00),说明其在无参考场景下仍能保证视觉自然度与舒适度。

4. 效率指标(移动端与桌面端)

- 关键结论:LiteIE是唯一能在Snapdragon 8 Gen 3上实现4K实时增强(30 FPS)的方法,移动端 latency 较SCI降低76.5%;GPU端帧率为Zero-DCE的2.62倍,效率优势显著。

5.定性实验结果

定性实验通过视觉对比,验证了LiteIE在亮度提升、细节保留、颜色自然度上的优势。感兴趣的读者可以去文章查看详情。

四、总结

从以下三个方面总结本文:

- 定量层面:LiteIE在PSNR、SSIM等精度指标上超越现有主流方法,同时参数规模、模型大小、推理速度均处于绝对领先,尤其在移动端4K场景下实现实时增强,突破资源受限平台的部署瓶颈;

- 定性层面:LiteIE能平衡低光区域亮度提升与细节保留,避免颜色偏移、过曝光、噪声放大等问题,增强结果的视觉自然度与实用性更优,且能适配下游人脸检测等任务;

- 模块有效性:IRM模块可显著提升细节恢复能力,多损失函数组合能保证曝光、边缘、颜色的稳定性,二者共同构成LiteIE“轻量且高效”的核心支撑。

感谢阅读,欢迎留言或私信,一起探讨和交流。

如果对你有帮助的话,也希望可以给博主点一个关注,感谢。

658

658

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?