💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文目录如下:🎁🎁🎁

目录

💥1 概述

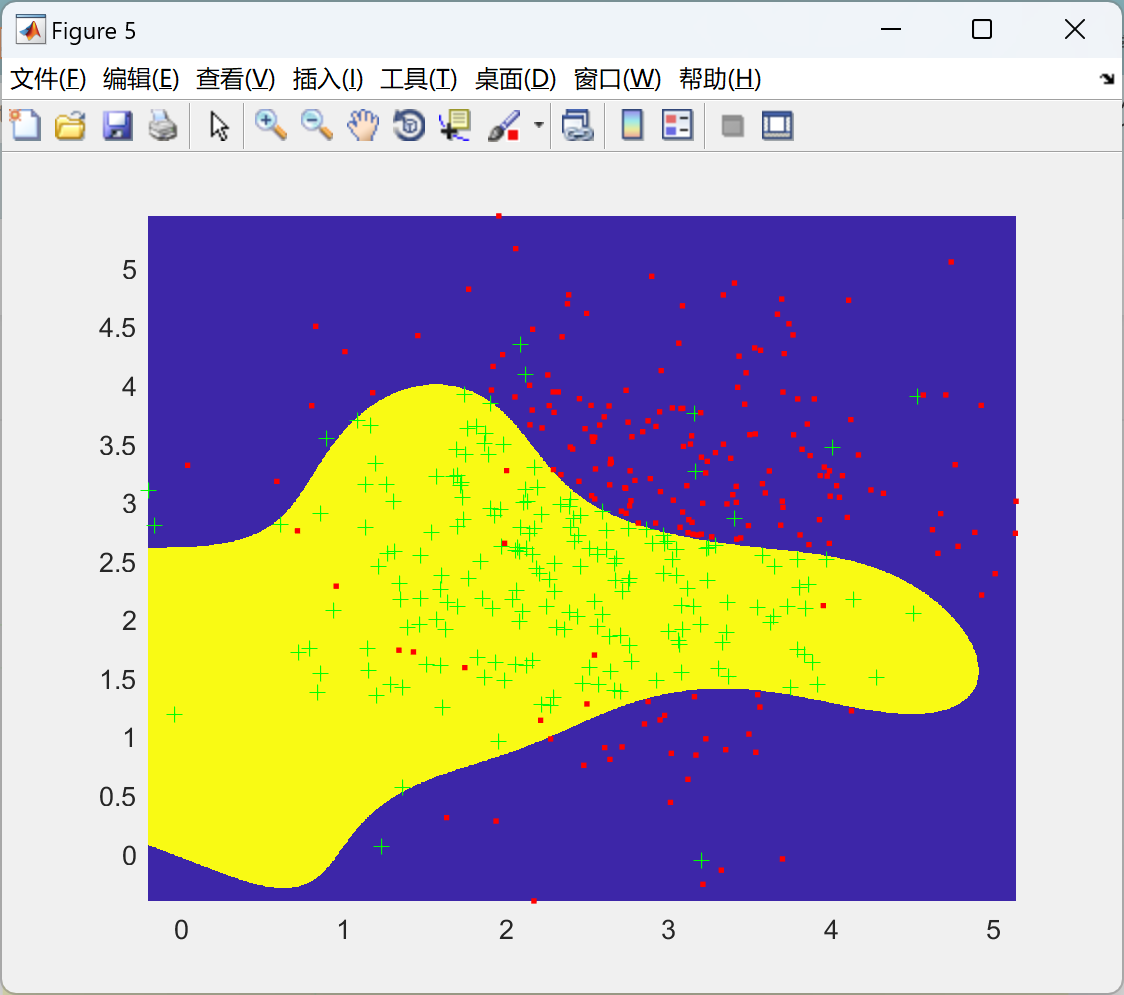

SVM是一种用于分类和回归分析的监督学习算法。它在各种内核函数的支持下展现了强大的灵活性。SVM通过在特征空间中找到最优的超平面来进行分类或回归。对于线性可分的情况,它寻找能够将不同类别的数据点分隔开的最佳超平面。而对于线性不可分的情况,则利用核技巧将数据映射到高维空间,使其在高维空间中线性可分。使用各种内核的SVM是一种强大的机器学习算法,通过选择适当的核函数和调优超参数,可以有效地解决各种分类和回归问题,具有广泛的应用前景。

📚2 运行结果

主函数部分代码:

主函数部分代码:

clear all;clc;

data=csvread('GaussianData.csv');

% Training & testing sets

[data_train,data_test] = holdout(data,80);

Xtrain = data_train(:,1:end-1);

Ytrain = data_train(:,end);

Xtest = data_test(:,1:end-1);

Ytest = data_test(:,end);

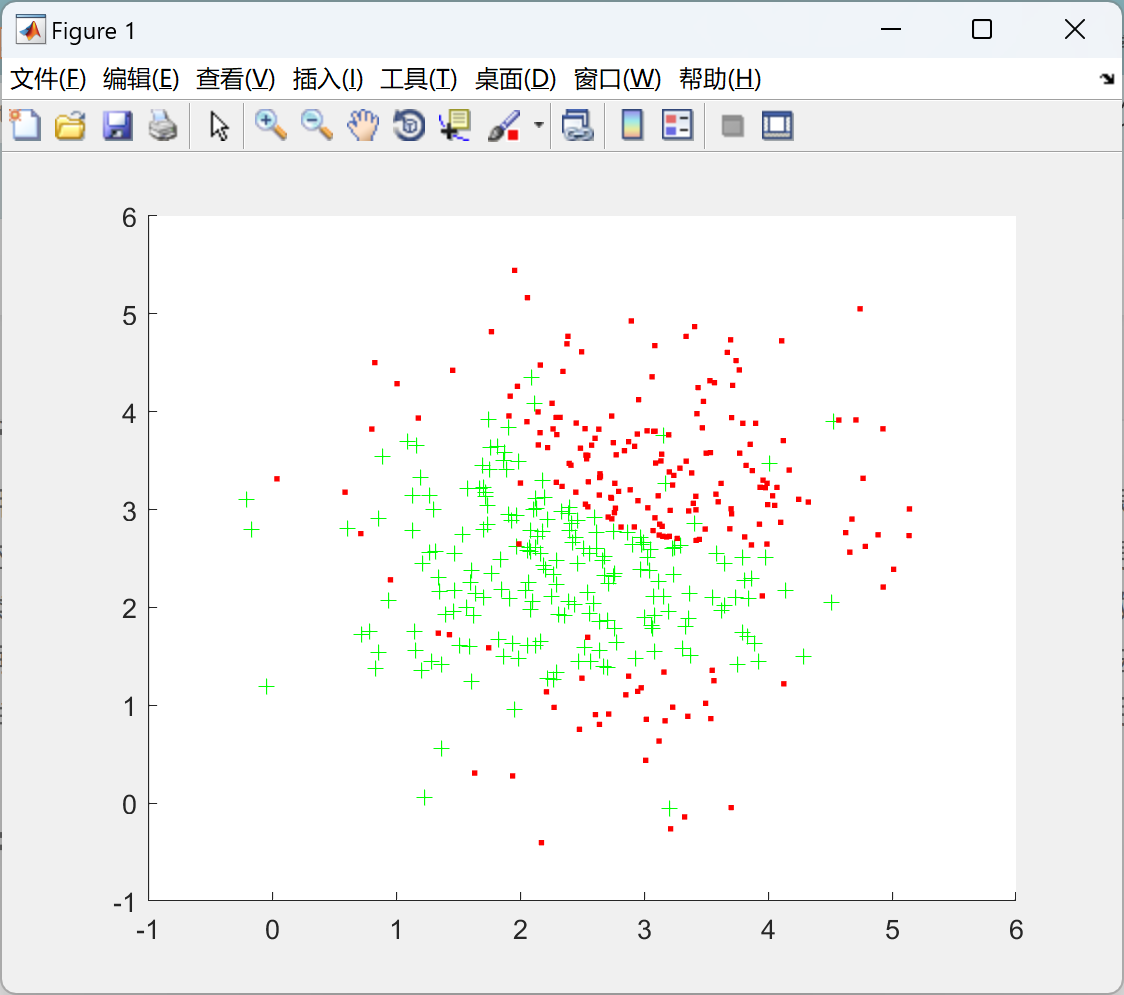

% Scatter Plot of data

figure

hold on

X=[Xtrain;Xtest];Y=[Ytrain;Ytest];

scatter(X(Y==1,1),X(Y==1,2),'+g')

scatter(X(Y==-1,1),X(Y==-1,2),'.r')

hold off

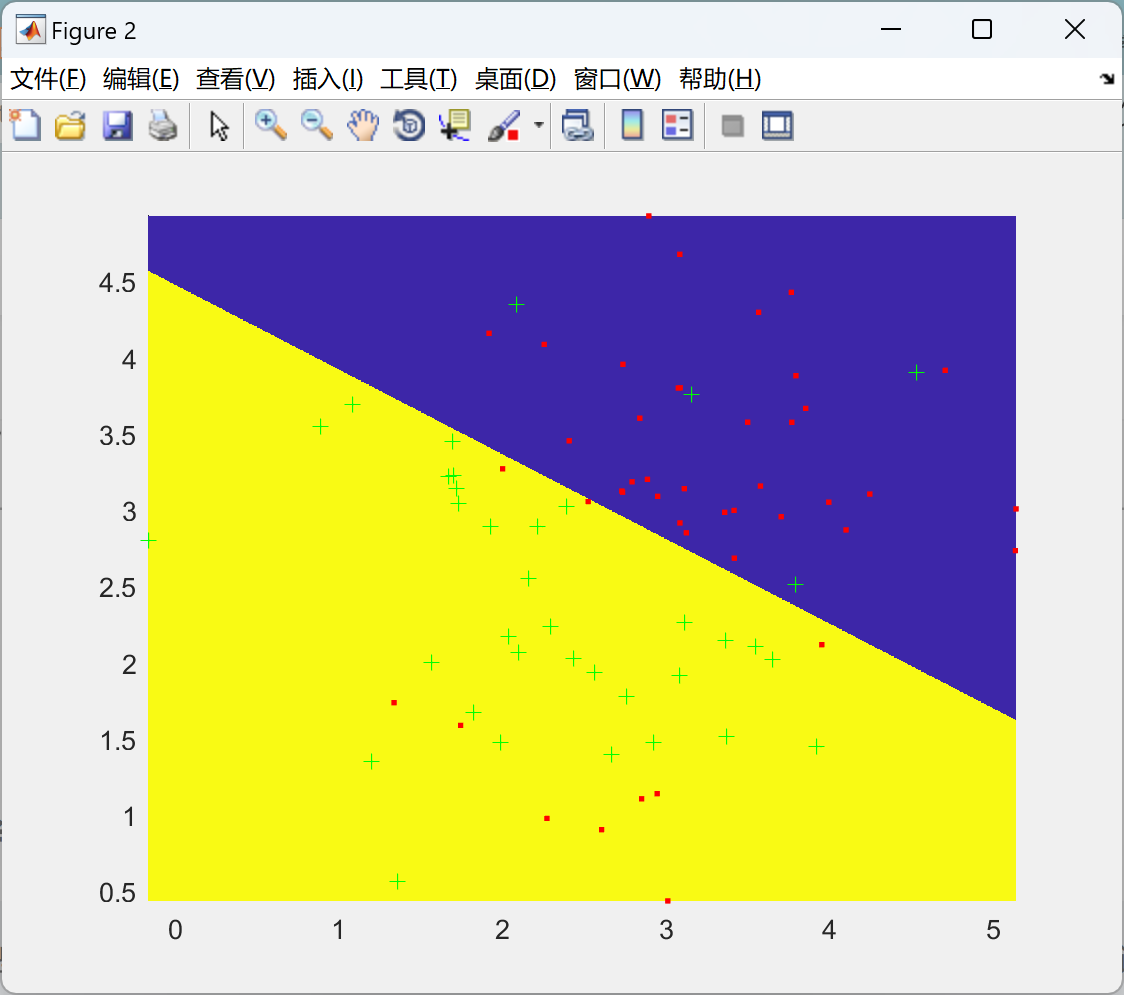

%% Applying linear Kernel

%%

linear_in=fitcsvm(Xtrain,Ytrain,'KernelFunction','linear');

linear_out=predict(linear_in,Xtest);

[~,acc_linear,fm_Linear]=confusionMatrix(Ytest,linear_out)

%% Decision Boundry in input space (Linear Kernel)

%%

x1range=min(data(:,1)):0.005:max(data(:,1));

x2range=min(data(:,2)):0.005:max(data(:,2));

🎉3 参考文献

文章中一些内容引自网络,会注明出处或引用为参考文献,难免有未尽之处,如有不妥,请随时联系删除。

[1]王顶明,潘晨晨.博士生思想政治教育认同度及影响因素——基于博士生思政教育改革问题的二元Logistic回归[J/OL].研究生教育研究,2024(02):60-67[2024-04-01].https://doi.org/10.19834/j.cnki.yjsjy2011.2024.02.09.

[2]梁昊光,秦清华.“数字丝绸之路”建设与共建国家价值链优化[J/OL].统计与决策,2024(06):126-131[2024-04-01].https://doi.org/10.13546/j.cnki.tjyjc.2024.06.023.

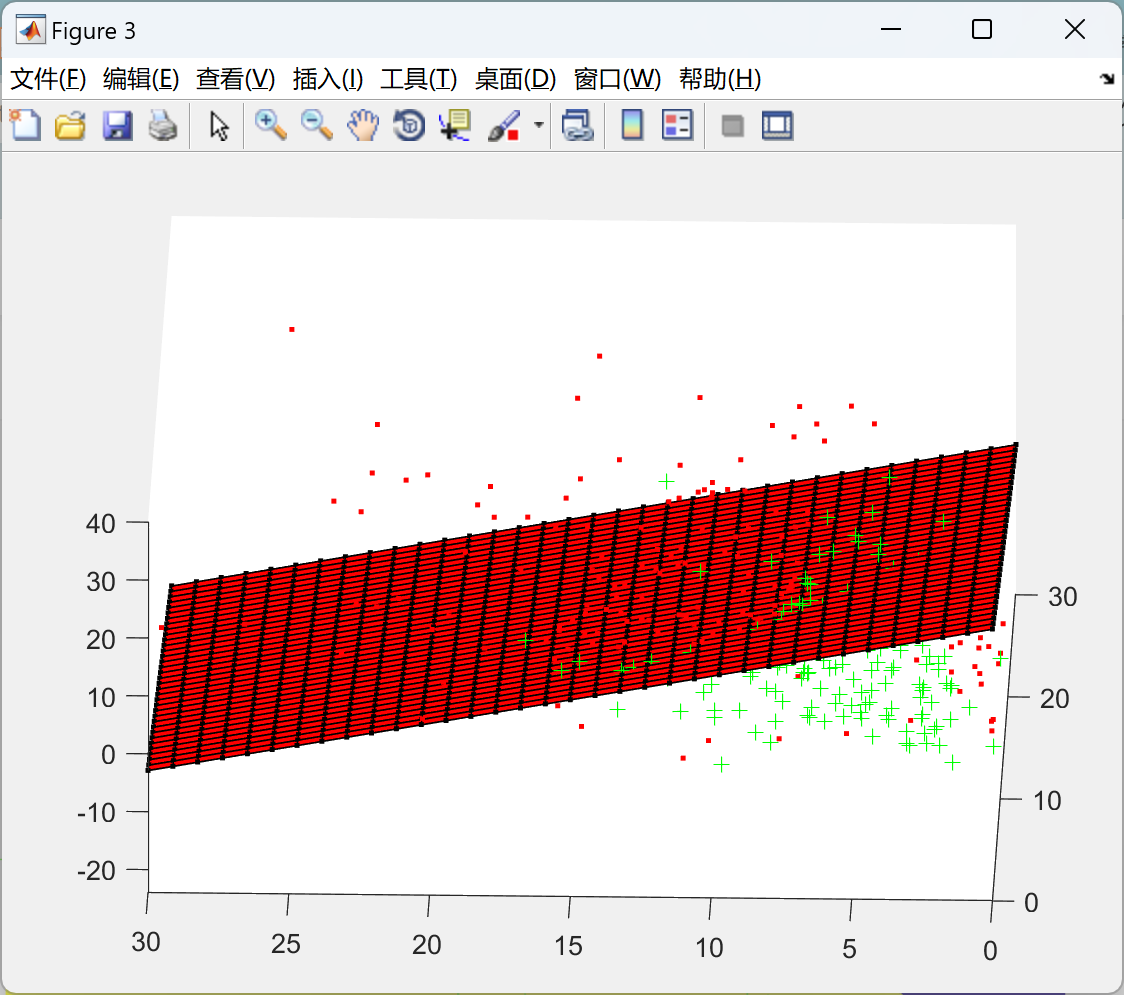

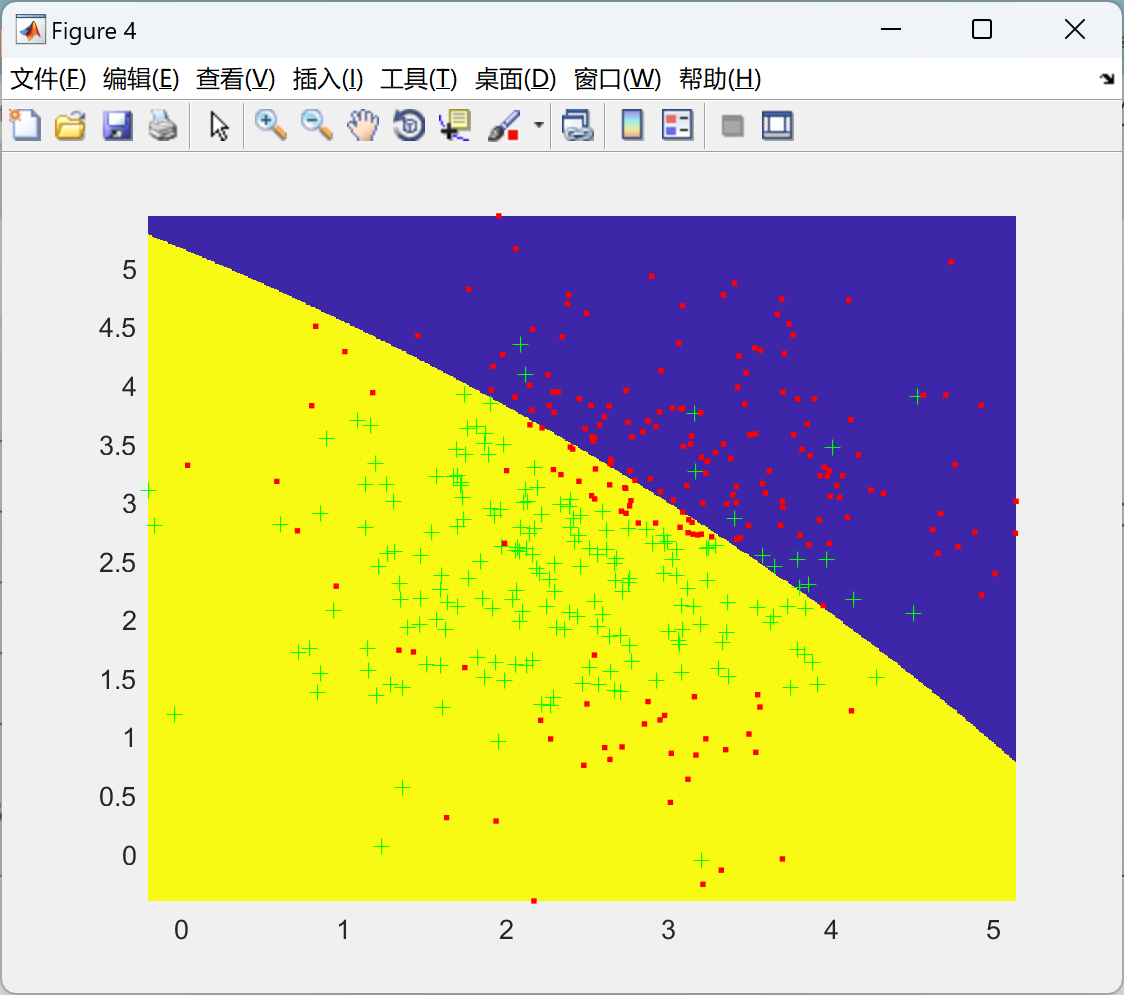

本文介绍了支持向量机(SVM)作为监督学习算法的基本原理,包括其在特征空间中的超平面划分和通过核技巧处理线性不可分问题的方法。通过Matlab代码展示了如何在GaussianData.csv数据集上应用线性内核进行分类,并展示了决策边界。

本文介绍了支持向量机(SVM)作为监督学习算法的基本原理,包括其在特征空间中的超平面划分和通过核技巧处理线性不可分问题的方法。通过Matlab代码展示了如何在GaussianData.csv数据集上应用线性内核进行分类,并展示了决策边界。

3722

3722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?