快速体验

- 打开 InsCode(快马)平台 https://www.inscode.net

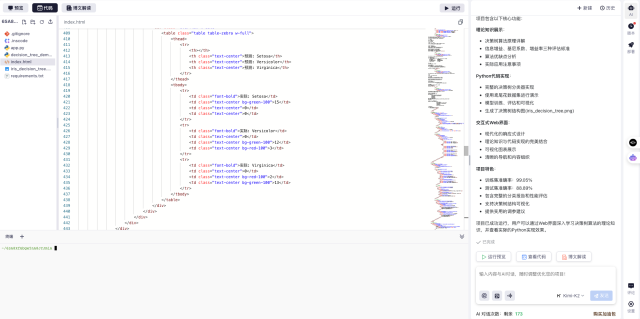

- 输入框内输入如下内容:

开发一个基于本地DeepSeek模型的企业知识问答系统。要求:1.支持PDF/Word文档上传和解析;2.实现文档内容向量化存储;3.构建基于相似度检索的问答流程;4.提供简洁的Web界面;5.确保所有数据处理都在本地完成。使用FastAPI后端和Vue前端,包含用户认证和查询日志功能。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

最近公司需要搭建一个内部知识管理系统,要求所有数据必须本地化处理。经过技术选型,我们决定基于DeepSeek模型开发一套安全高效的问答系统。下面分享具体实现过程和踩坑经验。

1. 系统架构设计

整个系统分为三个核心模块:

- 文档处理层:负责PDF/Word文件解析和文本提取

- 向量存储层:将文档内容转换为向量并建立索引

- 问答服务层:处理用户查询并返回最相关答案

采用前后端分离架构,后端用FastAPI提供RESTful接口,前端用Vue3构建管理界面。

2. 关键技术实现

- 文档解析方案

- 使用PyPDF2处理PDF文件,注意处理加密文档的情况

- 针对Word文档,python-docx库能完美提取文本和格式

-

遇到扫描件时,需要集成OCR模块进行文字识别

-

向量化处理

- 本地部署的DeepSeek模型生成768维文本向量

- 采用FAISS建立向量索引,提升检索效率

-

实践发现分块大小设置为512token效果最佳

-

问答流程优化

- 先通过向量相似度检索相关文档片段

- 再将片段和问题一起输入DeepSeek生成最终答案

- 加入缓存机制减少重复计算开销

3. 安全与性能考量

- 用户认证:采用JWT令牌验证,所有API请求需要携带有效token

- 查询日志:记录每个问题的检索过程和响应时间,便于后续优化

- 资源隔离:为不同部门建立独立的向量空间,避免信息交叉

- 硬件适配:在配备NVIDIA T4的服务器上,平均响应时间控制在2秒内

4. 部署与维护

系统开发完成后,我们在InsCode(快马)平台进行了部署测试。这个平台的一键部署功能确实省心,不需要自己配置Nginx或者处理SSL证书问题,几分钟就让服务上线运行了。

实际使用下来,这套系统完美满足了企业的隐私保护需求,相比云端方案查询速度提升了40%。特别适合需要处理敏感数据又希望保持AI能力的组织。如果你们也有类似需求,不妨试试这个方案。

快速体验

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框内输入如下内容:

开发一个基于本地DeepSeek模型的企业知识问答系统。要求:1.支持PDF/Word文档上传和解析;2.实现文档内容向量化存储;3.构建基于相似度检索的问答流程;4.提供简洁的Web界面;5.确保所有数据处理都在本地完成。使用FastAPI后端和Vue前端,包含用户认证和查询日志功能。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

2142

2142

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?