我还记得我第一次听说MCP(模型上下文协议)的时候,我心想:

“哈?又一个花里胡哨的缩写,这个世界已经快被这些缩写淹没了!”

但当我意识到MCP就像AI界的通用连接器——就像USB-C之于手机和笔记本电脑——我瞬间兴奋了。

再也不用折腾那些只能在某个地方工作的插件或奇怪的脚本了。

有了MCP,我可以轻松连接新工具,一下子搞定。

感觉就像是在打造一支专属的AI梦之队!

在这篇文章里,我想简单聊聊我是怎么在Cline、WindSurf,有时候还有Cursor这些工具里使用MCP服务器的。

我会用最简单的方式解释,一点都不会拿术语砸你。

另外,我还会提到一个我打算在自己电脑上尝试的个人案例(等我实际测试完再补充结果)。

那我们开始吧!

什么是MCP,我为什么要关心?

先从基础的讲起:MCP是模型上下文协议(Model Context Protocol)的缩写,这是Anthropic开发的一个开放标准。

用人话来说,就是有人想出了一个好点子,搞了个框架,让AI工具能顺畅沟通,不再闹脾气。

所以,现在如果我们想让某个工具做点事——比如读取Figma设计文件或者管理数据库——就不用每次都特意开发一个专用适配器了。只要我们的AI主界面支持MCP协议,就能直接把这个工具接入进去。

这就像插U盘一样:只要接口是USB,它就能用。

那么,MCP在哪能见到?

MCP并不是藏在某个神秘的开发者实验室里。

事实上,它已经出现在各种AI工具里了,比如Cline、WindSurf、Cursor等等。

你甚至可能已经在Cline里看到一个新功能:“MCP Marketplace”市场。

那基本上是一个可以浏览和安装各种服务器的地方——这些服务器就像AI插件,可以执行特定的任务。

还有一些第三方的仓库或者目录,你可以直接复制一条命令,粘贴到AI工具的配置文件里,然后立刻激活新的功能。

这就是让我忍不住感叹——

“哇,终于来了!”

因为再也不用去折腾那些乱七八糟的脚本,或者一步步跟着复杂的教程才能让某个功能跑起来了。

我现在只要打开MCP的配置文件,粘贴一个链接,就能直接用上。

我最喜欢的MCP服务器

这些年来,我试过不少MCP服务器,其中有些还属于实验性阶段。但有几个我一直在用。

Sequential Thinker(序列思考)

一开始,我以为这东西只是个噱头:

“我为什么需要一个AI按步骤思考?”

但其实,如果你用的是本地模型,或者有时候AI会犯迷糊,这个插件能让它把推理过程拆成更小的步骤。

如果你曾经遇到过AI说:

“让我想想……其实,等等,我再检查一下”

那这个插件就像是更有条理的版本。

我主要在Cline和WindSurf里用它,特别是处理复杂的编码任务时。

虽然它不总是完美的,但确实能帮我避免一些AI突然跳逻辑的问题。

这里是这个MCP的npx代码:

{

"mcpServers": {

"sequential-thinking": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-sequential-thinking"

]

}

}

}

你可以在这个页面找到关于这个MCP的所有信息:

github.com/modelcontextprotocol/servers/tree/main/src/sequentialthinking

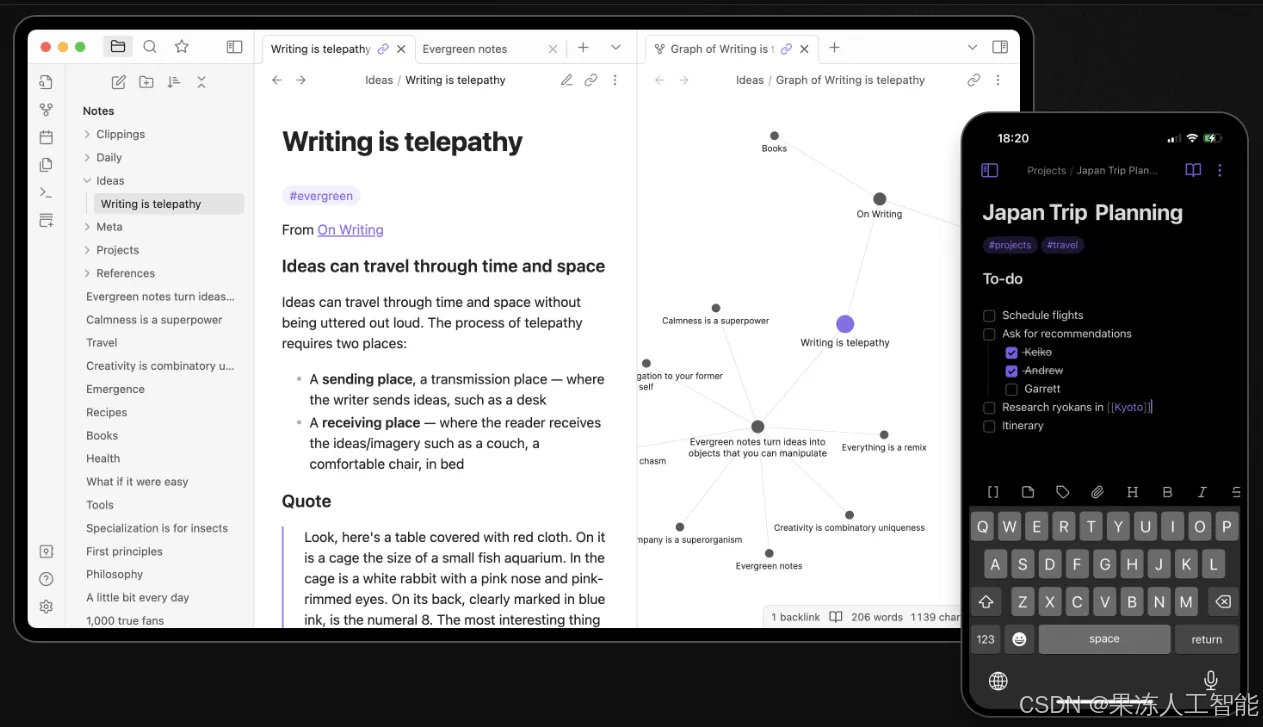

Obsidian 集成

我是个狂热的笔记爱好者。

我几乎把所有东西都存进 Obsidian Vault——包括待办事项、写作灵感、头脑风暴的想法,甚至随机的购物清单。

Obsidian MCP 服务器是一个真正的改变者,因为我可以直接在 AI 工具(比如 Cline)里说:

“嘿,把‘买狗粮’这个任务标记为已完成。”

然后它就会自动更新我的 Obsidian 笔记!

听起来可能是个小功能,但这种无缝的工作流意味着我不用在不同的应用之间来回切换。

如果你更喜欢 Jira 或 Notion,也有对应的 MCP 服务器可用。

配置 Obsidian MCP 服务器环境有两种方式。

第一种方式(推荐): 在服务器配置文件中添加 API Key:

{

"mcp-obsidian": {

"command": "uvx",

"args": [

"mcp-obsidian"

],

"env": {

"OBSIDIAN_API_KEY": "<your_api_key_here>"

}

}

}

第二种方式: 在工作目录下创建一个 .env 文件,并添加以下变量:

OBSIDIAN_API_KEY=your_api_key_here

这个 API Key 可以在 Obsidian 插件的配置里找到。

你可以在这里找到更多关于 Obsidian MCP 服务器的信息:

https://github.com/MarkusPfundstein/mcp-obsidian

E2B MCP

这个 MCP 服务器适合那些喜欢在安全环境中测试代码的人。

你可以把它想象成一个小泡泡,你的代码可以在里面运行,而不会影响你的主系统。

我发现它对测试新的 Node 模块、玩转 Python 库,或者运行示例脚本来确认是否可行特别有用。

如果你讨厌折腾 Docker 或虚拟机的麻烦,E2B Sandbox 会是你的好帮手。

你可以用 Python 或 JavaScript 来配置它。

Python 配置方法:

安装依赖:

uv install

然后在 Claude Desktop 里添加服务器配置:

MacOS 路径:

~/Library/Application Support/Claude/claude_desktop_config.json

Windows 路径:

%APPDATA%/Claude/claude_desktop_config.json

配置文件内容示例:

{

"mcpServers": {

"e2b-mcp-server": {

"command": "uvx",

"args": ["e2b-mcp-server"],

"env": { "E2B_API_KEY": "${e2bApiKey}" }

}

}

}

你可以在这里找到更多关于 E2B MCP 服务器的信息:

github.com/e2b-dev/mcp-server?tab=readme-ov-file

Replicate MCP

如果你曾经想要直接在项目文件夹里生成 AI 图片,那么 Replicate 的服务器会是个不错的选择。

我有时候会快速生成一个博客横幅的设计概念,或者测试 AI 如何为我正在写的文章生成随机插图。

这样,我不用从网上下载图片或者折腾第三方网站,所有东西都可以在一个环境里完成。

这比想象中要方便得多。

配置 Replicate MCP 服务器

这个服务器需要 Replicate API 令牌 才能工作。

你可以在 Replicate 官网 获取 API 令牌。

实际上,有两种方法可以提供这个令牌:

方法 1(推荐):添加到 Claude Desktop 配置文件

你需要将以下内容添加到 Claude Desktop 配置文件(具体位置见 Quickstart 部分):

{

"mcpServers": {

"replicate": {

"command": "mcp-replicate",

"env": {

"REPLICATE_API_TOKEN": "your_token_here"

}

}

}

}

你可以在这里找到更多关于 Replicate MCP 服务器的信息:

github.com/deepfates/mcp-replicate

数据库集成(Firebase、SupaBase 等)

这个功能对于自动化数据库任务非常有用。

如果我想创建一个新表、更新记录,或者快速查询点东西,我只需要用 AI 提示就能完成。

比如:

“创建一个名为 ‘newsletter_signups’ 的表,包含 email、signup_date 和 referrer 三列。”

然后,它就搞定了。

当然,你需要先准备好数据库凭据或配置。

但一旦设置完成,节省的时间是巨大的。

MCP:让 AI 工具更强大的“通用翻译器”

说到底,我想强调的是,MCP 本质上是一个通用翻译器,它能让各种 AI 工具变得更强大。

无论是读取设计文件、运行代码、管理数据库,还是整理任务,它的核心目标都是减少工作流程中的摩擦。

我知道,面对一大堆可用的服务器,可能会让人无从下手。但我的建议是,从最相关的一个开始。

• 喜欢做笔记? 试试 Obsidian 的集成。

• 整天用 Node 或 Python 编码? E2B Sandbox 可能会成为你的救星。

轻松创建属于你的 MCP 服务器

还有一点我不得不强调——现在创建自己的 MCP 服务器真的非常简单,如果现有的 MCP 服务器不能满足你的需求,完全可以自己搭建一个。

当然,你可能需要稍微打磨一下,但最大的难点——框架的搭建,基本上已经帮你解决了。

你的 MCP 体验?

如果你尝试了这些 MCP 服务器,告诉我你的使用体验!

如果你已经是 MCP 的深度用户,我很想知道你最离不开哪些服务器。

分享越多,我们的工作流就会变得越高效!

这次就先聊到这里。

祝你玩转 MCP,探索愉快!

7018

7018

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?