变分自编码器:原理、代码实现及应用解析

一、引言

在深度学习的广袤领域中,变分自编码器(Variational Autoencoder,VAE) 犹如一颗璀璨的明星,自2013年由Kingma和Welling提出后,便以其独特的魅力吸引了众多研究者的目光。它巧妙地融合了变分推断与神经网络,不仅能实现数据的高效压缩与精准重构,更具备强大的生成能力,可依据学习到的潜在分布创造出全新的数据样本。相较于传统自编码器,VAE在功能与应用上实现了质的飞跃,在图像生成、数据去噪、异常检测等诸多领域大显身手,成为推动人工智能技术发展的关键力量。

二、变分自编码器核心原理剖析

(一)传统自编码器回顾:基石与局限

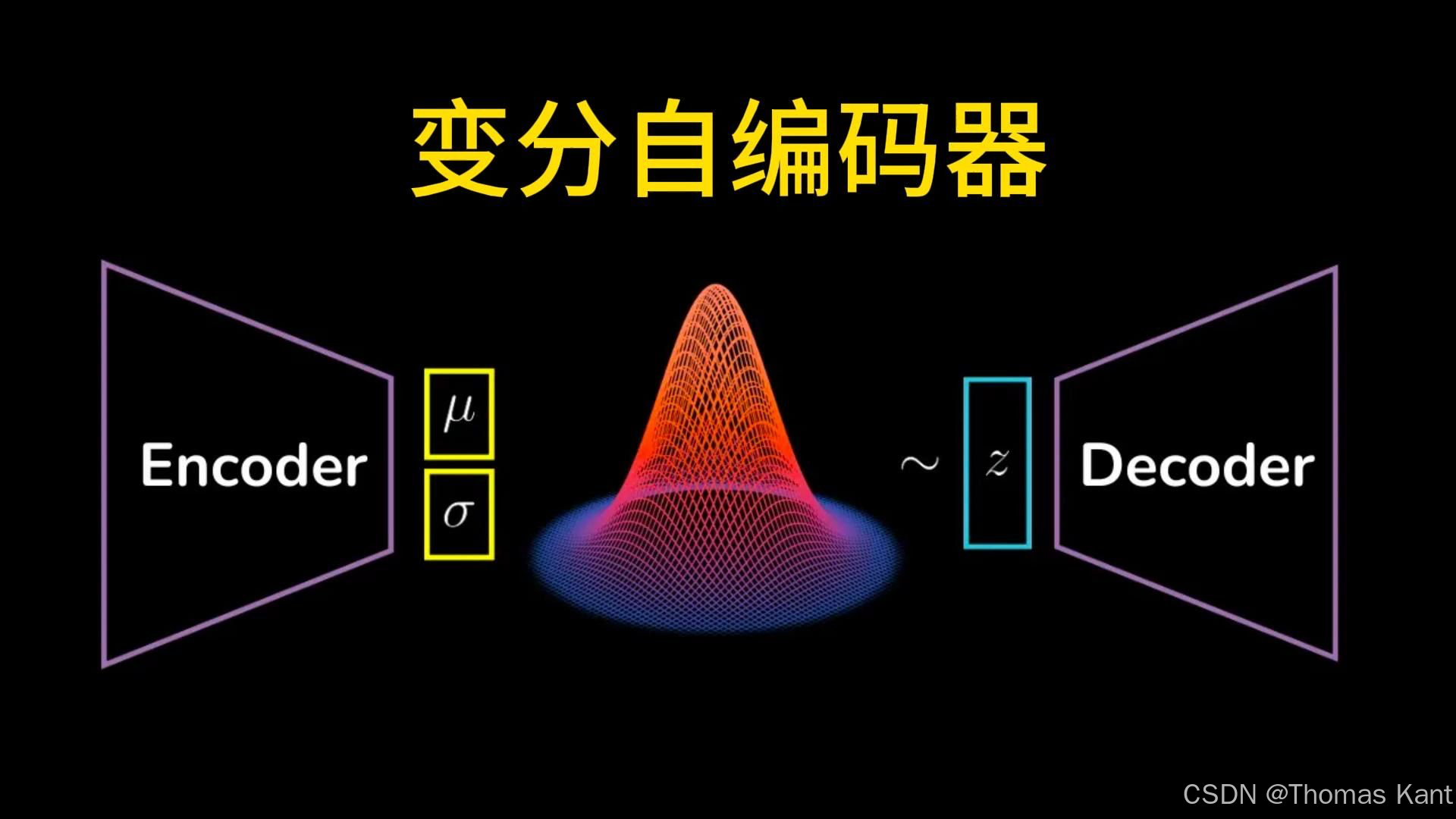

传统自编码器作为深度学习中数据处理的基础模型,由编码器(Encoder) 和解码器(Decoder) 构成:

- 编码器将高维输入数据压缩为低维潜在向量,完成特征提取。

- 解码器将潜在向量还原为与原始输入相似的输出,最小化重构误差(如均方误差)。

局限性:潜在向量缺乏概率分布特性,限制了生成能力。

(二)VAE的独特创新:引入概率分布

- 编码器输出潜在向量的均值μ\muμ与方差σ2\sigma^2σ2,定义高斯分布qϕ(z∣x)q_{\phi}(z|x)qϕ(z∣x)。

- 解码器从采样后的zzz生成数据x^\hat{x}x^,对应分布pθ(x∣z)p_{\theta}(x|z)pθ(x∣z)。

核心优势:通过概率化处理赋予VAE强大的生成能力。

(三)变分推断与最大似然估计:理论基石

- 目标:最大化对数似然logpθ(x)\log p_{\theta}(x)logpθ(x)。

- 变分推断分解:

logpθ(x)=Eqϕ(z∣x)[logpθ(x∣z)]−KL(qϕ(z∣x)∥p(z))\log p_{\theta}(x) = \mathbb{E}_{q_{\phi}(z|x)}[\log p_{\theta}(x|z)] - \text{KL}(q_{\phi}(z|x) \| p(z))logpθ(x)=Eqϕ(z∣x)[logpθ(x∣z)]−

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

595

595

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?