全AI决策的农业AI自动化通过集成人工智能算法、传感器网络、自动化设备和先进的系统架构,正在深刻变革传统农业生产方式。其核心在于利用AI进行智能感知、精准决策和自主执行,涵盖病虫害识别与无人机喷洒、温室智能调控、杂草识别与机器人除草、作物成熟度判断与自动收割等多个关键环节,旨在提高效率、降低成本、优化资源利用并促进农业可持续发展。

1. 技术实现细节

1.1 AI算法在农业自动化中的具体应用

在农业自动化领域,人工智能(AI)算法,特别是深度学习模型,扮演着至关重要的角色,它们赋予机器感知、理解、决策和执行复杂农业任务的能力。一个突出的应用是基于AI的自主农药喷洒无人机,这类系统利用卷积神经网络(CNN)等深度学习模型进行图像识别,以判断作物健康状况并识别病虫害 。例如,研究人员开发了能够识别约四种不同水培植物疾病的CNN模型,通过对包含这些疾病图像的数据集进行训练,模型的准确率可以超过90% 。这种高准确率为后续的精准决策和作业奠定了坚实基础。在训练过程中,通过执行Epoch函数来减少损失并提高模型的准确性。具体到模型的工作层面,通常使用Keras预处理包输入图像,然后通过Pillow包及其图像转数组功能将图像转换为数组值。训练完成的CNN模型能够对输入的作物图像进行分析,预测植物所患的具体疾病类型 。在杂草识别方面,YOLO(You Only Look Once)系列模型,如YOLOv5,也被广泛应用于实时目标检测,例如在杂草识别中,YOLOv5n模型被用于处理包含25255张图像的杂草检测数据集,并通过降低图像分辨率至416x416以及采用加权和的损失函数(包括CE Loss、Focal Loss、Dice Loss和Pearson Correlation Loss)来提高检测精度 。

除了病虫害和杂草识别,AI算法还广泛应用于温室环境控制。例如,有研究提出了一种AI驱动的温室环境控制系统(AI-GECS),该系统采用混合多因素深度学习网络CLSTM-CNN-BP来预测温室内部微气候条件 。该模型整合了卷积长短期记忆(CLSTM)网络、卷积神经网络(CNN)以及回归反向传播神经网络(BPNN),能够处理网格化天气预报数据和温室控制数据集,以生成多因素、多步长的微气候预测,包括温度、相对湿度和光合有效辐射(PAR)等关键参数 。这种预测能力使得系统能够提前评估作物生理指标,并据此调整温室设备,以优化作物生长环境。另一项研究则探讨了使用改进的循环神经网络(MRNN)模型进行温室气候控制,该模型在预测准确性方面表现出色,平均绝对误差(MAE)为0.21,均方误差(MSE)为0.39,F1分数达到0.85 。这些AI模型的应用,使得温室管理更加智能化和精细化,有助于提高作物产量和资源利用效率。在农药推荐方面,机器学习算法被用于分析由无人机搭载的多光谱和地理传感器收集的数据,包括作物健康指标、天气模式、土壤特性和历史病虫害发生情况 。基于这些分析,系统能够根据实时的害虫压力和作物种类,通过高级数据分析和预测模型,实时推荐最佳的农药选择、剂量和施用时间。

对于作物成熟度判断和自动收割,AI技术也展现出强大的能力。AI模型可以通过分析来自光谱传感器和卫星图像的数据,解读作物的成熟度指标,如叶绿素水平、糖分含量和成熟度 。同时,结合天气预报数据和生长模型,AI系统可以推荐理想的收获窗口,从而最大限度地提高产量和作物质量,并减少浪费。例如,针对苹果和葡萄等水果,AI驱动的平台可以评估特定的成熟度和糖分含量阈值,确保在最佳品质时进行采摘 。尽管自动化收割面临诸多挑战,如识别成熟果实、果实定位、选择性采摘以及果实无损处理等 ,但AI算法的不断进步正在逐步克服这些难题,推动自动收割技术的发展。例如,电装与Certhon联合开发的全自动收割机器人Artemy®,通过高精度图像识别系统实时判断番茄成熟度,其算法源自汽车高级驾驶辅助系统(ADAS)的环境感知技术,确保了在不同光照条件下的识别稳定性 。

下表总结了AI算法在农业自动化中的主要应用领域及其关键技术:

| 应用领域 | AI算法/模型示例 | 主要功能 | 关键技术/传感器 | 参考文献 |

|---|---|---|---|---|

| 病虫害识别 | CNN (如MobileNetV2), YOLO | 识别病虫害类型、严重程度,指导精准施药 | 无人机/摄像头图像 (RGB, 多光谱), 光谱数据 | , |

| 杂草识别 | CNN, YOLO (如YOLOv5, YOLOv8) | 区分作物与杂草,定位杂草,指导精准除草 | 摄像头图像 (RGB, 多光谱) | , |

| 温室环境控制 | CLSTM-CNN-BP, MRNN | 预测微气候 (温度、湿度、光照), 优化设备调控 | 温度、湿度、光照、CO2传感器, 天气预报数据 | , |

| 作物成熟度判断 | CNN (如VGG19, YOLOv4/v7/v8), MLPANN, Mask R-CNN | 评估果实成熟度 (颜色、大小、内部成分), 确定最佳采收期 | 摄像头图像 (RGB, 3D), 光谱传感器, 电子鼻 | , |

| 农药/肥料推荐 | 机器学习算法 | 根据作物健康、土壤、天气等推荐最佳投入品及用量 | 多光谱/地理传感器数据, 土壤数据, 气象数据 | |

| 自主导航与路径规划 | 强化学习, 蚁群算法 (ACA), A*算法 | 农机自主导航, 优化作业路径, 避障 | GPS, RTK-GNSS, LiDAR, IMU, 摄像头 | , |

Table 1: AI算法在农业自动化中的主要应用领域及关键技术

1.2 传感器与AI的集成方式

传感器与AI的集成是实现全AI决策农业自动化的核心环节,它为AI系统提供了感知物理世界并获取决策所需数据的关键能力。在基于AI的自主农药喷洒无人机系统中,无人机通常配备机载摄像头作为主要传感器,用于拍摄作物图像 。这些图像数据通过无线音频视频发射器(如TS832 48CH 5.8G)实时传输到处理单元,或者直接在无人机上的处理单元内进行分析 。处理单元运行预先训练好的AI模型(如CNN),对图像进行分析以识别病虫害。除了摄像头,无人机还可能集成其他传感器,例如GPS模块用于导航和定位,以及可能的**惯性测量单元(IMU)**用于飞行姿态稳定。AI算法处理这些多源传感器数据,综合判断作物健康状况,并据此做出喷洒决策。例如,一旦AI识别出病虫害,系统会通过UART协议从处理单元的Zigbee模块向无人机的Zigbee模块传输指令,激活泵电机执行喷洒操作 。在激光除草机器人的案例中,传感器系统包括环境传感器(温度、湿度、光照传感器)、定位系统(GPS、IMU)、以及用于环境感知的固态雷达和TM雷达 。这些传感器收集的数据,如点云数据、气象数据、机器人位置信息和田间图像数据,都会被传输至AI计算单元。

在AI驱动的温室环境控制系统中,传感器网络是获取环境参数的基础。这些传感器通常包括温度传感器、湿度传感器、光照强度传感器(PAR传感器)、土壤湿度传感器和二氧化碳传感器等 。这些传感器持续监测温室内的微气候条件和作物生长环境,并将收集到的实时数据传输给中央处理单元或云端平台。AI系统,如AI-GECS,会利用这些传感器数据,并结合外部数据源(如短期网格化天气预报)进行综合分析 。例如,CLSTM-CNN-BP模型会处理来自传感器的实时温室气象数据以及网格化天气预报数据,以预测未来的微气候状况 。基于这些预测和作物生理模型,AI系统生成控制指令,精准调控温室设备,如通风系统、遮阳网、加热器、加湿器等,以维持最佳的作物生长环境。这种集成方式实现了对环境条件的实时监测、智能分析和自动调控。在智能农业机器人云控制系统中,智能感知单元布置在智能农机单元上,包括农机运行状态传感器和环境信息传感器,用于感知农机运行状态和环境状况 。

对于AI杂草识别与自主除草机器人,传感器同样扮演着关键角色。除草机器人通常配备高分辨率摄像头作为主要传感器,用于捕捉田间作物的图像 , 。这些图像数据被输入到搭载在机器人上的AI处理单元,该单元运行训练好的CNN或YOLO等目标检测模型,实时识别作物和杂草 , 。例如,Carbon Robotics的LaserWeeder利用其机载摄像头和计算机硬件,通过CNN模型直接在机器上检测杂草 。John Deere的See & Spray系统也依赖摄像头和CNN进行杂草检测 。在一些更先进的系统中,还可能集成其他类型的传感器,如多光谱或高光谱传感器,以获取更丰富的植物信息,从而提高杂草识别的准确性和鲁棒性。AI算法处理这些传感器数据,不仅识别杂草,还可能评估杂草的密度和分布,为后续的除草作业提供更精确的指导。

在AI作物成熟度判断与自动收割场景中,传感器技术同样不可或缺。用于判断作物成熟度的传感器可以包括光谱传感器(如近红外光谱仪)、高光谱成像仪、RGB摄像头以及卫星遥感设备 , 。这些传感器能够捕捉反映作物成熟状态的多种指标,如颜色、大小、形状、内部化学成分(如糖分、酸度、水分)等。AI模型通过分析这些传感器数据,结合历史数据和作物生长模型,来判断作物的成熟度,并预测最佳采收期 。例如,AI可以分析光谱数据中的叶绿素含量变化或糖分积累情况。在自动收割过程中,**视觉传感器(如2D/3D摄像头)和激光雷达(LiDAR)**等用于感知果实的位置、大小和朝向,以及植株的形态,引导机械臂进行精准的采摘作业 , 。AI算法处理这些复杂的传感器信息,实现对成熟作物的识别、定位和选择性采收。

下表总结了不同农业自动化场景中传感器与AI的集成方式:

| 应用场景 | 主要传感器类型 | AI集成方式与数据处理 | 决策与执行 | 参考文献 |

|---|---|---|---|---|

| 无人机精准喷洒 | 机载摄像头 (RGB, 多光谱), GPS, IMU | 图像实时传输至处理单元 (边缘/云端), CNN模型分析病虫害 | AI决策喷洒指令通过Zigbee等传输至无人机执行喷洒 | , |

| 温室智能调控 | 温度、湿度、光照 (PAR)、CO2、土壤湿度传感器, 气象站数据 | 传感器数据上传至云端/边缘AI, CLSTM-CNN-BP等模型预测微气候, 结合作物生理模型优化控制策略 | AI生成控制指令,自动调节温室设备 (通风、遮阳、加热、灌溉等) | , |

| 自主除草机器人 | 高分辨率摄像头, GPS, IMU, (可选)多光谱/高光谱传感器, 固态雷达, TM雷达 | 图像输入机载AI处理单元, CNN/YOLO模型实时识别杂草, 结合环境数据规划路径 | AI控制机械臂/锄头/激光器/精准喷头执行除草作业 | , |

| 自动收割 | 光谱传感器, 高光谱成像仪, RGB摄像头, 卫星遥感, 2D/3D摄像头, LiDAR, 电子鼻 | 多源传感器数据分析作物成熟度指标, AI模型判断成熟度并预测最佳采收期 | AI控制收割机行进路径与执行机构 (机械臂、切割器) 进行精准采摘/收割 | , |

| 激光除草机器人 | 环境传感器, GPS/IMU, 固态雷达, TM雷达, AI相机 | 多传感器数据融合, AI计算单元深度学习算法识别杂草, 结合环境数据制定除草策略 | AI控制激光器瞄准并摧毁杂草, 动态路径规划和避障 |

Table 2: 不同农业自动化场景中传感器与AI的集成方式

1.3 自动化设备的AI控制逻辑

自动化设备的AI控制逻辑是实现全AI决策农业自动化的执行层面,它基于AI算法的分析结果,精确控制各种农业机械和设备完成特定任务。在自主农药喷洒无人机系统中,AI的控制逻辑始于对无人机搭载的摄像头捕获的作物图像进行分析。一旦AI模型(如CNN)识别出特定区域存在病虫害,并且达到了预设的喷洒阈值,控制逻辑便会触发 。决策结果(例如,需要喷洒农药的类型和剂量)会通过通信模块(如Zigbee)从AI处理单元发送到无人机的飞行控制系统或专门的喷洒控制单元 。随后,控制单元会激活泵电机和喷嘴,按照AI指令精确地对目标区域进行农药喷洒。未来的改进方向可能包括根据受感染作物的严重程度实施预设水平的农药喷洒,使无人机能够自动调整喷洒强度,确保针对性处理,优化农药使用并减少环境影响 。整个控制逻辑强调实时性、精准性和自主性,旨在替代传统的人工判断和手动喷洒。在激光除草机器人中,AI计算单元在识别杂草并确定其位置后,会结合机器人当前位置、环境信息(障碍物、地形、气象)以及杂草特征(类型、大小、密度)来规划除草路径和制定除草策略 。

在AI驱动的温室环境控制系统中,AI的控制逻辑更为复杂,涉及对多个环境参数的协同调控。系统首先通过部署在温室各处的传感器网络(如温度、湿度、光照、CO2传感器)收集实时数据 。AI模型(如CLSTM-CNN-BP或MRNN)对这些数据进行分析,并结合天气预报和作物生长模型,预测未来一段时间内的微气候变化趋势以及作物需求 , 。基于这些分析和预测,AI控制逻辑会生成一系列控制指令,发送给温室内的各种执行设备,如通风扇、加热器、湿帘、补光灯、遮阳网、CO2发生器以及灌溉系统等。例如,如果AI预测到温室温度将过高,它会自动开启通风扇或湿帘进行降温;如果光照不足,则会启动补光灯。控制逻辑的目标是维持一个最适宜作物生长的动态平衡环境,同时优化能源和水资源的消耗 。这种闭环控制系统能够根据实时反馈不断调整设备状态,实现精准的环境管理。AI-GECS系统通过云端平台自动化所有操作,实现了增强的环境控制 。

对于AI杂草识别与自主除草机器人,AI的控制逻辑主要集中在精确识别和定位杂草,并指挥机器人执行除草动作。机器人通过其搭载的摄像头获取田间图像,AI模型(如YOLOv8或CNN)实时分析这些图像,识别出杂草并将其与作物区分开来 , 。一旦杂草被识别并定位,AI控制逻辑便会启动。根据除草机器人的类型,控制指令会有所不同。例如,对于机械式除草机器人,AI可能会控制机械臂或锄头精确地移除杂草;对于激光除草机器人(如Carbon Robotics的LaserWeeder),AI会控制激光器瞄准并摧毁杂草 ;对于喷洒式除草机器人(如John Deere的See & Spray),AI会控制喷嘴只对识别出的杂草进行精准喷洒,避免伤及作物 。控制逻辑还需要考虑机器人的导航和路径规划,确保其能够高效地覆盖整个作业区域,并根据杂草的分布密度调整作业策略。

在AI作物成熟度判断与自动收割场景中,AI的控制逻辑旨在实现高效、无损的自动化采收。首先,通过传感器(如光谱仪、摄像头)收集作物成熟度相关数据,AI模型分析这些数据,判断作物是否达到采收标准,并确定最佳采收时间窗口 。当作物达到成熟标准后,自动收割机开始作业。AI控制逻辑负责指挥收割机的行进路径,并控制其执行机构(如机械臂、切割器)进行采摘。例如,对于水果采摘,AI需要根据视觉传感器(如3D摄像头)和LiDAR获取的果实位置、大小、朝向等信息,精确计算机械臂的运动轨迹和末端执行器的抓取姿态,确保能够成功采摘果实并避免损伤 , 。控制逻辑还需要处理复杂情况,如果实被枝叶遮挡、果实簇生等。此外,AI还可以控制收割机对采摘的作物进行初步分级和分类。整个控制过程强调感知的准确性、决策的智能性和执行的精确性,以最大限度地提高采收效率和产品质量。

下表总结了不同自动化设备的AI控制逻辑:

| 自动化设备 | AI控制逻辑核心 | 关键决策点 | 执行动作 | 参考文献 |

|---|---|---|---|---|

| 自主农药喷洒无人机 | 图像识别病虫害 -> 决策喷洒 -> 控制无人机飞行与喷洒 | 病虫害类型与严重程度, 喷洒阈值, 无人机位置与状态 | 激活泵电机与喷嘴, 控制飞行路径与速度 | , |

| 温室环境控制系统 | 传感器数据预测微气候 -> 评估作物需求 -> 优化设备调控 | 预测环境参数 (温度、湿度、光照), 作物生理指标 (如光合作用速率) | 控制通风、遮阳、加热、加湿、CO2、灌溉等设备 | , |

| 自主除草机器人 | 图像识别杂草 -> 定位杂草 -> 规划路径与除草策略 | 杂草种类、位置、密度, 机器人位置与姿态, 环境障碍物 | 控制机械臂/锄头/激光器/精准喷头执行除草, 机器人导航 | , |

| 自动收割机 | 传感器数据分析成熟度 -> 判断采收时机 -> 规划路径与收割参数 | 作物成熟度指标 (颜色、大小、内部成分), 果实位置与朝向, 植株形态 | 控制机械臂/切割器进行采摘/收割, 收割机导航, 初步分级分类 | , |

| 激光除草机器人 | 识别杂草 -> 规划除草路径与策略 -> 动态避障 -> 控制激光除草 | 杂草特征 (类型、大小、密度), 机器人位置, 环境数据 (障碍物、地形、气象), 除草策略 | 控制激光器发射, 调整机器人行驶方向和速度 |

Table 3: 不同自动化设备的AI控制逻辑

2. 系统架构与集成

2.1 农业AI自动化系统的典型架构

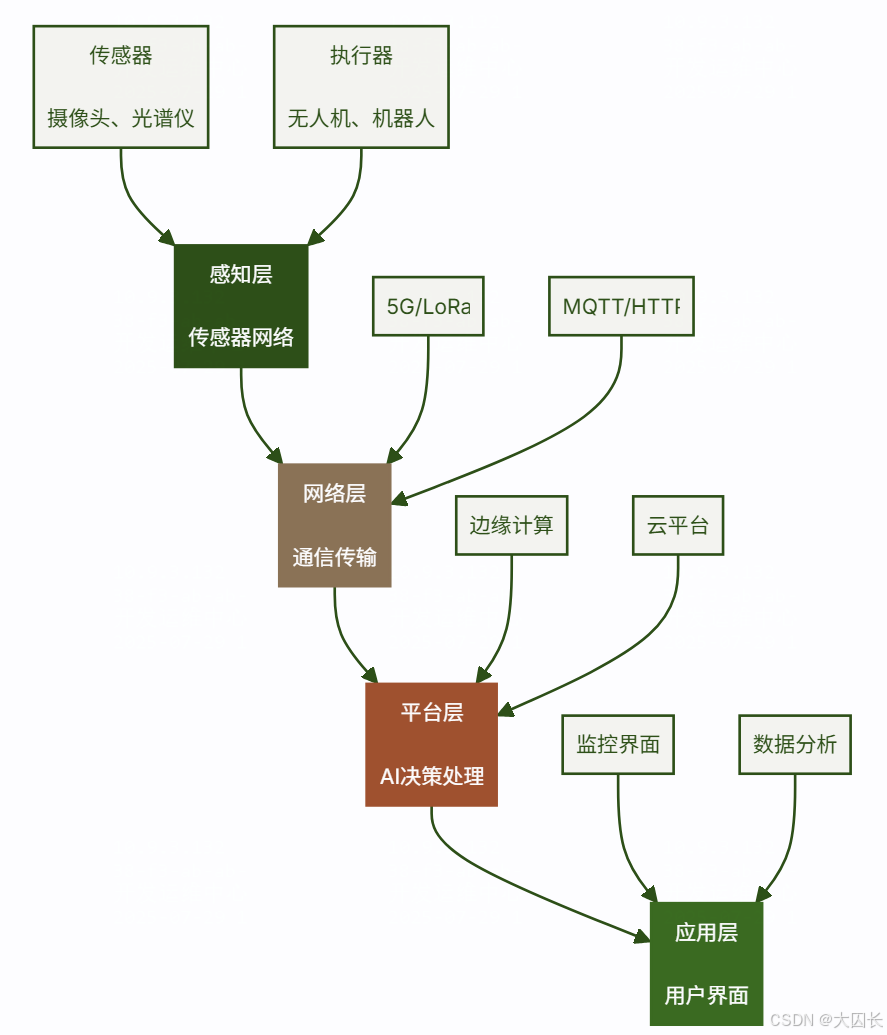

全AI决策的农业自动化系统通常采用分层或分布式的架构,以整合感知、决策、控制和通信等多个模块,实现高效的农业作业管理。一种典型的架构可以概括为“感知层 - 网络层 - 平台层 - 应用层”。感知层由部署在农田、温室或农机上的各种传感器(如摄像头、气象传感器、土壤传感器、光谱传感器等)和执行器(如无人机、温室设备、除草机器人、收割机等)组成,负责数据采集和指令执行 , 。网络层负责连接感知层与平台层,确保数据的可靠传输和指令的及时下达。这通常涉及到多种通信技术的融合,例如5G用于高速、低延迟的实时数据传输,LoRa、Zigbee等低功耗广域网(LPWAN)技术用于传感器节点的连接,以及卫星通信用于偏远地区的覆盖 。平台层,也称为边缘计算层或云计算层,是系统的核心处理单元。在边缘计算节点或云端服务器上,运行着AI算法和数据分析模型,对收集到的数据进行处理、分析和存储,并生成决策指令 , 。应用层则面向最终用户,提供可视化的操作界面、数据分析报告、决策支持信息以及远程控制功能,使农民能够监控和管理整个农业生产过程。

以AI驱动的温室环境控制系统(AI-GECS)为例,其架构清晰地体现了这些层次 。该系统包含四个主要模块:短期网格化天气预报模块、内部微气候预测模块、作物生理指标模块和AI环境控制模块。这些模块运行在云端平台上,通过物联网技术连接温室内的传感器(数据采集)和执行器(环境调控设备)。AI-GECS利用网格化天气预报数据和实时温室气象数据,通过CLSTM-CNN-BP深度学习模型预测温室微气候,并结合作物光合作用模型优化控制策略,最终生成控制指令自动调节温室设备 。这种云端集中处理与边缘执行相结合的架构,既利用了云计算的强大算力,也保证了控制的实时性。另一种值得关注的架构是AGRARIAN,这是一种混合AI驱动的智能农业架构,它特别强调了边缘计算和卫星通信的集成 。AGRARIAN架构支持根据具体的农业用例和可行性,选择并组合不同的技术方法,如实时边缘AI、联邦学习和卫星推断。该架构的网络层集成了5G通信、混合卫星通信(LEO和GEO)、边缘网络基础设施、容迟网络(DTN)和物联网协议,以确保在各种环境下的无缝连接 。

在控制架构方面,农业自动化系统可以采用集中式、分散式和混合式控制策略 。集中式控制系统(Centralized Control Systems)依赖单一的中央控制器协调所有模块的动作,通过全局信息进行优化决策,适用于温室等结构化环境,如Agrobot SW6010草莓采摘机器人 。分散式控制系统(Decentralized Control Systems)则强调个体模块基于本地传感器数据和邻域通信自主决策,实现自组织,具有更强的动态环境适应性,如Thorvald II机器人 。混合控制系统(Hybrid Control Systems)则试图结合集中式和分散式控制的优点,中央系统负责规划全局任务,而子模块则自主优化局部行为,例如SwarmBot机器人集成了集中式任务分配和分布式蚁群算法(ACA),以实现多机器人在玉米田中的协同喷洒作业 。John Deere公司的精准农业生态系统也提供了一个中央集成的系统架构范例,其核心是Operations Center,这是一个基于云计算的农场管理系统,充当连接机器、人员和海量农艺数据的中心枢纽 。

下表总结了农业AI自动化系统的典型架构及其特点:

| 架构类型/名称 | 核心思想 | 主要层次/组件 | 关键技术/协议 | 优点 | 缺点/挑战 | 参考文献 |

|---|---|---|---|---|---|---|

| 分层架构 (通用) | 模块化设计,功能分层 | 感知层, 网络层, 平台层 (数据处理与AI决策), 应用层 | 5G, LoRa, Zigbee, Wi-Fi, 卫星通信, MQTT, HTTP/HTTPS | 模块化, 可扩展, 可维护, 易于集成新技术 | 层间接口标准化, 数据传输效率, 安全性 | , |

| AI-GECS | 云端集中处理与边缘执行结合,精准温室调控 | 天气预报模块, 微气候预测模块, 作物生理指标模块, AI环境控制模块 | 物联网技术, CLSTM-CNN-BP模型, 云平台 | 利用云计算, 精准环境控制, 降低传感器依赖成本 | 对网络连接稳定性要求较高 | , |

| AGRARIAN | 混合AI驱动,边缘计算与卫星通信集成,适应偏远地区 | 传感器层, 网络层 (5G/卫星), 数据处理层 (边缘AI/联邦学习), 应用层 (ADSS) | 5G, 混合卫星通信, DTN, IoT协议, 边缘AI, 联邦学习 | 适应网络不稳定环境, 低延迟, 数据隐私保护, 数字包容性 | 系统复杂性较高, 成本可能较高 | , |

| John Deere Operations Center | 中央数据平台,连接机器、人员与数据,数据驱动决策 | 机器 (传感器, GPS, JDLink), 云平台 (Operations Center), 用户接口 (Web, App) | JDLink, StarFire, 云平台, 数据API | 数据无缝流动, 实时监控, 远程管理, 优化农场运营 | 生态系统封闭性, 数据所有权问题可能存疑 | , |

| 集中式控制 | 单一中央控制器协调所有模块,全局优化 | 中央控制器, 感知模块, 执行模块 | 专用通信协议 | 高精度任务同步 | 依赖中央节点, 单点故障风险, 通信延迟敏感 | |

| 分散式控制 | 各模块基于本地数据和邻域通信自主决策,自组织 | 分布式智能体/模块, 本地传感器, 通信模块 | 本地决策算法 (如强化学习, 人工势场) | 动态环境适应性强, 鲁棒性较高 (无单点故障) | 全局优化困难, 协同控制算法复杂 | |

| 混合式控制 | 中央系统规划全局任务,子模块自主优化局部行为 | 中央规划器, 分布式智能体/模块 | 任务分配协议, 本地优化算法 (如蚁群算法) | 兼顾全局优化与局部灵活性, 提升多机器人系统效率 | 设计复杂度高, 中央与分布式协调机制需精心设计 |

Table 4: 农业AI自动化系统的典型架构及其特点

2.2 中央决策AI与子系统的通信与数据流

在全AI决策的农业自动化系统中,中央决策AI与各子系统(如无人机、温室设备、除草机器人、收割机等)之间的高效通信和有序数据流是实现协同工作和精准作业的关键。通信协议的选择至关重要,需要考虑到传输距离、数据量、功耗、实时性以及部署环境的复杂性。常见的通信协议包括MQTT(Message Queuing Telemetry Transport)和AMQP(Advanced Message Queuing Protocol),它们作为消息传递协议,使得代理(agents)能够交换数据、命令或通知,构成了交互的骨干 。此外,子系统或代理通常会暴露API(Application Programming Interfaces),提供标准化的接口,使其他代理或系统能够请求特定信息或操作,从而促进互操作性和简化的通信 。在物联网(IoT)背景下,MQTT因其轻量级、低功耗和适用于不稳定网络的特点,常被推荐为传感器、执行器、通信节点和设备子系统之间的通信范式 。John Deere公司的“运营中心”(Operations Center)作为一个中央数字枢纽,通过JDLink™等连接技术,实现了机器、人员和海量农艺数据流的无缝连接,农场主可以近乎实时地获取机器位置和田间数据更新 。

数据流的管理涉及到数据的采集、传输、处理、存储和分发。传感器网络负责采集农田环境数据(如温度、湿度、土壤墒情)、作物生长数据(如光谱信息、图像)以及设备状态数据。这些原始数据通过无线或有线网络传输到边缘计算节点或中央云平台。在传输过程中,数据的标准化和格式化对于后续的AI分析和决策至关重要。例如,在AI-GECS系统中,温室内部的微气候数据(来自传感器)和外部网格化天气预报数据(来自公开数据集)被整合并输入到CLSTM-CNN-BP模型中进行分析和预测 。处理后的数据,如病虫害识别结果、杂草分布图、作物成熟度评估、优化控制指令等,会从中央AI下发到相应的子系统。例如,无人机接收到喷洒指令和路径信息,温室设备接收到温湿度调节指令,除草机器人接收到杂草位置和类型信息。为了确保通信的可靠性和数据的安全性,系统架构中通常会考虑容错机制和数据加密。例如,AGRARIAN架构的网络层集成了5G、卫星通信和DTN(Delay-Tolerant Networking)技术,以适应不同场景下的连接需求 。John Deere与SpaceX合作,为其农业机械配备Starlink终端和4G调制解调器,以解决农村地区网络连接不畅的问题 。

一个开源的AI架构,利用MLOps(机器学习操作)范式,为农业应用提供了强大的技术支撑,其中也体现了中央AI与子系统的通信和数据流管理 。该架构基于Kubernetes平台构建,利用其容器编排能力实现应用的稳定性和弹性。在通信层面,该平台使用MQTT协议进行设备到设备的通信,并使用HTTP协议在云环境中进行数据包交换。这些协议的选择不仅促进了系统组件之间的高效数据交换,还通过提供通信冗余增强了系统的灵活性。数据科学家和ML工程师可以利用这个平台更有效地开发或微调模型。该架构集成了Kubeflow,一个用于机器学习工作流的开源平台,它支持数据准备、任务编排、模型训练(与TensorFlow、PyTorch等流行框架集成)、模型部署以及模型监控 。

下表总结了中央决策AI与子系统间的主要通信协议及其特点:

| 通信协议 | 类型/特点 | 主要应用场景 | 优点 | 缺点/挑战 | 参考文献 |

|---|---|---|---|---|---|

| MQTT | 轻量级, 发布/订阅, 低功耗, 适用于不稳定网络 | 传感器数据上报, 设备控制指令下发, IoT场景 | 带宽占用小, 易于实现, 支持一对多通信, 设备解耦 | 消息可能丢失 (QoS 0), 安全性需额外配置 (如TLS/SSL) | , |

| AMQP | 企业级, 功能丰富, 可靠消息传递 | 复杂系统间的数据交换, 金融、电信等行业 | 高可靠性, 事务支持, 灵活的路由机制 | 相对重量级, 实现复杂度较高 | |

| HTTP/HTTPS | 请求/响应模型, 广泛应用的Web协议 | 设备与云平台交互, API调用, 数据上传下载 | 标准化, 易于开发和调试, 安全性 (HTTPS) | 开销较大, 不适合低功耗设备, 实时性相对较差 | |

| CoAP | 专为受限设备设计, 基于UDP, 类HTTP语义 | 低功耗传感器网络, 资源受限设备通信 | 轻量级, 低功耗, 支持多播 | 基于UDP不可靠, 需要应用层处理可靠性 | |

| ISOBUS (ISO 11783) | 农业机械串行控制和通信数据网络标准 | 拖拉机与农具间通信, 不同厂商设备互操作性 | 标准化接口, 提高设备兼容性 | 主要针对农机内部通信, 外部集成需网关 | , |

| OPC UA | 平台独立, 面向服务, 安全可靠, 工业互操作性标准 | 复杂工业设备系统集成, 智能制造, 农业自动化高级集成 | 高安全性, 丰富的信息模型, 支持复杂数据结构 | 实现相对复杂, 资源消耗较大 | |

| LoRaWAN | 低功耗广域网 (LPWAN) | 远距离, 低功耗传感器数据传输, 大面积农田监测 | 远距离覆盖, 低功耗, 大容量连接 | 数据传输速率低, 主要用于小数据量传输 | , |

| Zigbee | 低功耗, 短距离, 自组网 | 传感器网络, 智能家居, 农业近距离设备控制 | 低功耗, 自组网能力强, 成本较低 | 传输距离短, 网络容量有限, 易受干扰 | , |

| 5G | 高带宽, 低时延, 广连接 | 高清视频监控, 大规模无人机协同, 远程精确控制, 实时AI应用 | 高速率, 低延迟, 大连接数, 高可靠性 | 覆盖范围有限 (目前), 部署成本较高, 终端功耗可能较高 | , |

| 卫星通信 | 广域覆盖, 适用于偏远地区 | 地面网络覆盖不到的地区的数据传输, 应急通信 | 覆盖范围广, 不受地面基础设施限制 | 成本较高, 可能存在延迟 (GEO卫星), 带宽可能受限 | , |

Table 5: 中央决策AI与子系统间的主要通信协议及其特点

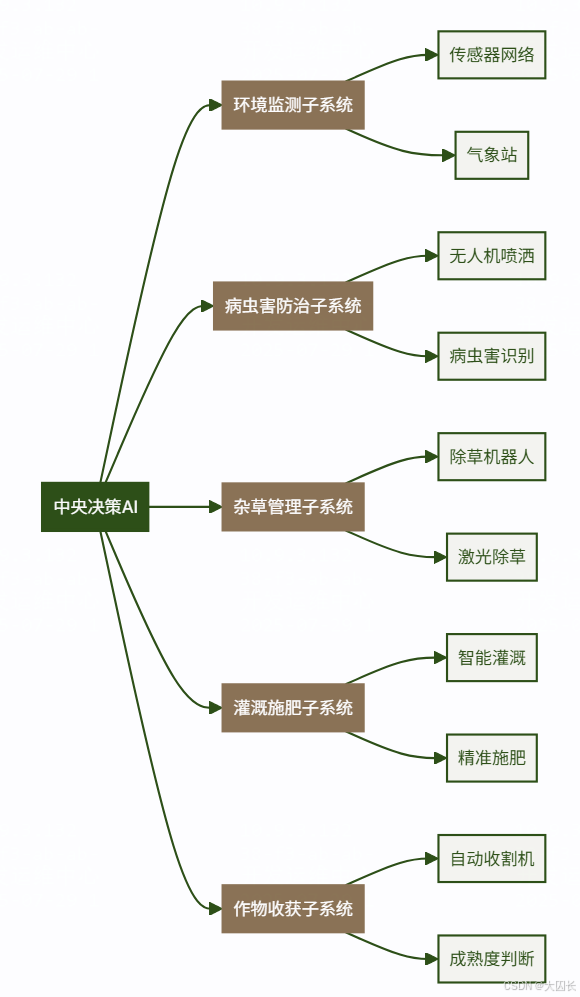

2.3 多子系统协同工作机制

全AI决策的农业自动化系统往往包含多个功能各异的子系统,如环境监测子系统、病虫害防治子系统、杂草管理子系统、灌溉施肥子系统、作物收获子系统等。实现这些子系统之间的高效协同工作,是提升整体农业生产效率和智能化水平的关键。协同工作机制的核心在于中央决策AI的统一调度和各子系统之间的信息共享与任务配合。中央决策AI作为系统的“大脑”,负责整合来自各个子系统的数据,进行综合分析,制定全局最优的作业计划,并将具体的任务指令分配给相应的子系统执行。例如,中央AI根据气象数据、土壤数据和作物生长模型,判断需要灌溉,则会向灌溉子系统发送指令;同时,如果监测到病虫害迹象,会调度无人机进行巡查和精准喷药。John Deere的自动化解决方案为此提供了一个很好的范例,其系统通过先进的感知技术、强大的边缘计算能力和中央云平台的协同,实现了复杂的农业作业自动化 。

一个重要的协同场景是数据驱动的决策闭环。例如,温室环境控制系统(AI-GECS)中,传感器网络(环境监测子系统)实时采集温室内的温度、湿度、光照等数据,并将这些数据传输给中央AI 。中央AI结合天气预报和作物生理模型进行分析,预测未来环境变化趋势,并生成控制指令发送给温室设备控制子系统(如通风、遮阳、加温设备),以调节温室环境。调节后的环境数据再次被传感器网络捕获,反馈给中央AI,形成一个持续优化的闭环控制系统 。这种协同确保了温室环境始终处于作物生长的最佳状态。在更复杂的农田管理中,多子系统的协同更为关键。例如,无人机在进行病虫害监测时,如果发现大面积病虫害爆发,中央AI不仅会指挥无人机进行喷洒作业,还可能联动地面机器人进行更细致的检查或辅助作业,或者通知管理人员进行人工干预。John Deere的“运营中心”(Operations Center)在协调不同设备和作业环节方面扮演着关键角色,它连接机器、数据和实时洞察,允许农民监控性能、及时做出决策并逐年改善结果 。

实现多子系统协同工作的技术基础包括统一的通信协议、标准化的数据接口、以及高效的任务调度算法。**ROS(Robot Operating System)**在这样的系统中扮演着重要角色,它为不同机器人平台和传感器提供了模块化的通信框架和工具集,使得开发和集成复杂的多机器人系统成为可能 , 。例如,一个基于ROS的农业机器人系统,可以方便地集成视觉感知、路径规划、机械臂控制等模块,并实现多个机器人之间的任务分配和协作。此外,边缘计算和云计算平台的结合,为多子系统的协同提供了强大的计算和存储支持。边缘节点可以处理本地的实时任务,而云端则负责更复杂的全局优化和数据分析,共同保障整个农业自动化系统的高效协同运行。数字孪生(Digital Twins)技术也为多子系统协同工作提供了新的途径,通过构建物理系统的虚拟映射,可以实时模拟、预测和优化子系统的协同行为 。

3. 实际应用与案例

3.1 病虫害AI识别与无人机精准喷洒

基于AI的病虫害识别与无人机精准喷洒系统是当前智慧农业领域一个备受关注且发展迅速的应用方向。这类系统通过集成先进的传感器技术、人工智能算法和无人机平台,实现了对作物病虫害的早期、快速、准确识别,并能够指挥无人机进行针对性的农药喷洒,从而有效控制病虫害的蔓延,减少农药使用量,降低对环境和人力的负面影响。例如,有研究成功开发了能够自主操作的农药喷洒无人机,该无人机集成了PIXHAWK飞行控制器和物联网传感器,通过机载摄像头拍摄作物图像,利用训练好的卷积神经网络(CNN)模型分析图像以识别植物疾病,模型的准确率超过90% 。一旦识别到病虫害,无人机能够自主导航至目标植物,并通过UART协议和Zigbee模块控制泵电机和喷嘴进行精准喷洒 。这种自主喷洒机制不仅提高了作业效率,还解决了传统农药喷洒方法中存在的对人体有害、劳动力需求大和喷洒成本高等问题。

另一项研究也展示了类似的技术路径,提出了一种基于AI的无人机系统,用于农药推荐和精准喷洒 。该系统同样利用CNN模型分析多光谱图像,提取作物健康指标。Robovision公司与法兰德斯农业、渔业和食品研究所(ILVO)合作开发了一套杂草检测系统,该系统利用计算机视觉AI赋能无人机,实现超局部化喷洒,据称可减少高达80%的农药使用 。该系统的工作流程是:无人机自主飞行读取田间信息并识别杂草,数据被即时发送到AI模型进行分析,随后生成详细的任务地图并发送给喷洒设备。喷洒设备依据该地图进行精准作业。为了应对各种天气条件和光照变化带来的挑战,该系统通过精心挑选包含不同田间、各类杂草和土壤类型的训练数据集,并进行针对性的数据增强,使得模型能够在高度可变的环境中保持接近完美的识别准确率 。Fermata公司的Croptimus平台也通过分析摄像头捕捉的图像数据,自动在早期阶段检测病虫害,据称可帮助种植者减少高达30%的作物损失,并节省50%的侦察成本 。

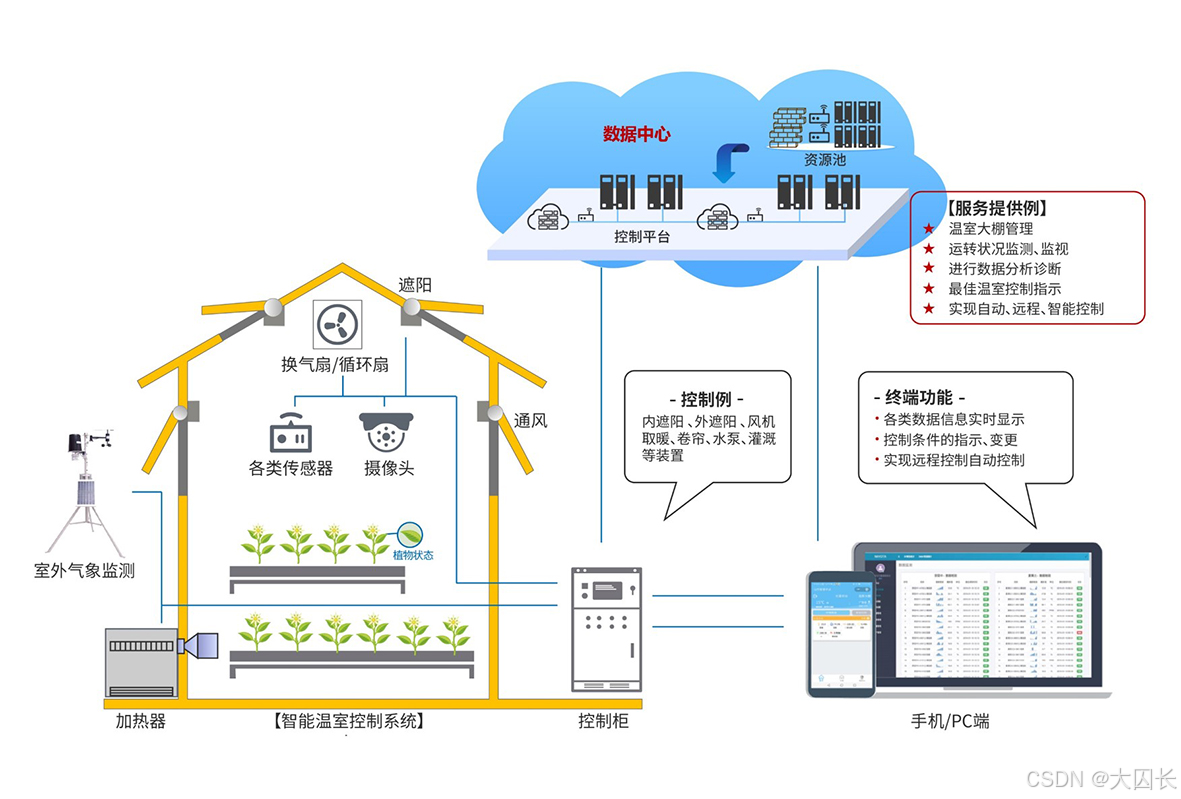

3.2 AI驱动的温室环境智能调控

AI驱动的温室环境智能调控是精准农业在设施园艺领域的重要应用,旨在通过集成传感器数据、AI算法和自动化控制设备,实现对温室内光照、温度、湿度、CO2浓度等环境因子的优化管理,从而最大限度地提高作物产量和品质,同时节约资源和能源。一个典型的案例是台湾农业研究所开发的AI-GECS(AI-powered greenhouse environmental control system)系统 。该系统通过整合定制化的网格天气预报、温室内部微气候预测、作物生理指标评估以及自动化的温室操作,实现了对温室环境的智能调控。其核心技术在于利用一个名为CLSTM-CNN-BP的混合深度学习模型,该模型能够基于天气预报和实时温室数据,提前数小时预测温室内的温度、湿度和光合有效辐射等关键参数 。基于这些预测,系统能够评估作物在预期环境下的生理状态(如光合作用速率),并据此主动调整温室的控制设备(如冷却系统、遮阳系统),以优化作物生长条件。AI-GECS系统能够每小时执行一次这样的预测和调控循环,主动启动降温或防雨措施,从而优化作物生长条件 。

数字孪生(Digital Twins)技术与AI的结合,为温室环境的精细化管理提供了强大的工具。在温室数字孪生系统中,各种传感器(如温湿度传感器、光照传感器、CO2传感器、土壤传感器等)实时收集环境数据和作物生长数据,这些数据被传输到数字孪生模型中 。AI算法,特别是机器学习模型,对这些数据进行分析,预测作物生长趋势和环境变化,并据此生成控制指令,驱动执行器(如通风设备、加热器、遮阳帘、补光灯、灌溉系统等)进行调节。例如,Hemming等人利用数字孪生算法,在六个温室隔间中为期六个月的樱桃番茄种植期间,确定了气候设定点和作物管理策略,旨在最大化净利润。他们将气候模型与番茄作物模型相结合,根据生长条件估算每个隔间的预测产量 。一个典型的温室数字孪生系统架构通常包括数据管理、预测工具、温室建筑设施、传感器和执行器(如Arduino Uno微控制器),以及可随时访问的数据存储(如使用MySQL数据库)。

3.3 AI杂草识别与自主除草机器人

AI杂草识别与自主除草机器人是精准农业和可持续农业领域的重要发展方向,旨在通过自动化手段替代传统的人工除草或大面积化学除草,从而减少劳动力成本、降低除草剂使用量、减轻环境污染。该技术的核心在于利用计算机视觉和深度学习算法,使机器人能够准确识别作物和杂草,并进行精准的除草作业。目前市场上已出现多种基于AI的除草机器人解决方案。例如,瑞芯微推出的基于RK3576 SoC的智能除草机器人解决方案,利用其强大的边缘计算能力(NPU算力达6 TOPS)和AI加速能力,支持Linux、ROS等操作系统,可实现育苗和杂草的视觉识别、种植物行线采集、路径跟踪和行控除草等功能 。该方案通过多路摄像头接入,结合AI算法(如YOLOv8)实时识别杂草与作物,并通过CAN总线或GPIO接口控制激光模块或机械臂进行精准除草 。

激光除草机器人是另一种重要的研究方向。一项专利(CN118525832A)详细描述了一种激光除草机器人,其AI计算单元利用深度学习算法识别杂草位置,并根据杂草特征(类型、大小、密度)和环境数据(温度、湿度、光照)制定最优除草策略,包括除草路径、激光功率和作业时长 。该机器人集成了多种传感器,如环境传感器、GPS/IMU定位系统、固态雷达和TM雷达,用于环境感知、自主导航和避障 。美国农业机器人公司FarmWise也开发了AI驱动的除草机器人,利用图像识别技术区分作物和杂草,实现精准除草 。国内也有研究团队开发基于深度学习的避苗除草装置,通过RGB-D摄像头采集信息,利用预训练的深度神经网络对土壤、作物和杂草进行分类,作物和杂草识别准确率超过95%,除草效率达85%,作物损伤率低于5% 。Robovision公司也开发了类似的AI驱动杂草检测系统,该系统不仅支持无人机,还可以赋能地面机器人进行精准喷洒或机械除草,据称可减少高达80%的农药使用 。

3.4 AI作物成熟度判断与自动收割

AI在作物成熟度判断与自动收割领域的应用,旨在通过智能化手段准确判断作物的最佳采收时机,并指挥自动化设备进行高效、低损的采收作业,从而提高农产品质量和经济效益。目前,已有多个研究机构和公司在此领域取得了进展。例如,株式会社电装与荷兰子公司Certhon联合开发的全自动收割机器人Artemy®,已正式投入欧洲市场,该机器人通过高精度图像识别系统实时判断番茄成熟度,其算法源自汽车高级驾驶辅助系统(ADAS)的环境感知技术,确保在不同光照条件下的识别稳定性 。Artemy®还采用了柔性机械臂设计,借鉴工业机器人轨迹规划技术,能够自适应不同形态的作物,实现精准采收,并且其模块化电池系统和自动换箱功能支持可持续作业20小时以上 。

在中国,搭载北斗导航的智能收割机可以精准判别作物成熟度,自动优化收割参数,大幅降低漏割率 。一些研究则聚焦于特定作物的成熟度检测与采摘。例如,有研究利用改进的YOLOv4与迁移学习技术,结合VGG19卷积层,实现对复杂环境下番茄果实的精准检测和成熟度判断 。苏州博田自主研发的果蔬采摘机器人,利用人工智能和多传感器融合技术,基于深度学习的视觉算法引导机械臂完成识别、定位、抓取、切割、回收任务,采摘成功率可达90%以上,其多传感器融合技术可以对采摘对象进行信息获取、成熟度判断,并确定目标的三维空间信息 。浙江理工大学的科研团队研发的慧“眼”识茶采茶机器人,配备深度相机和深度学习模型,能够高精度识别茶芽的嫩度和位置,模拟手工采摘动作,采茶成功率已超过87% 。Agrobot SW6010是一款用于草莓采摘的机器人,它采用集中式控制,视觉系统使用RGB-D摄像头识别成熟果实,中央控制器协调机械臂的轨迹,定位误差在±2毫米以内,损伤率低于3% 。

3.5 行业领先企业的AI农业解决方案(如John Deere)

约翰迪尔(John Deere)作为全球领先的农业机械制造商,在AI农业解决方案的研发与应用方面处于行业前沿。该公司将AI技术深度整合到其设备中,以实现精准农业,其AI驱动系统综合利用了机器学习、数据分析和计算机视觉等多种技术 。John Deere的设备配备了大量的传感器、GPS和数据分析功能,能够收集关于土壤状况、天气模式、植物健康和机器性能的海量数据。机器学习算法对这些数据进行分析,识别模式并提取洞察,从而为农民提供更优的决策支持。计算机视觉技术则通过摄像头和图像识别软件评估植物健康状况、识别杂草并监测作物生长阶段,从而实现靶向干预而非大面积施药 。John Deere的AI解决方案通过多种产品和服务实现,例如智能播种系统可以根据实时土壤条件调整播种深度和间距;See & Spray技术(收购自Blue River Technology)利用计算机视觉区分作物和杂草,并仅对杂草喷洒除草剂,据称可将除草剂使用量减少高达90%;自主拖拉机则利用AI在田间导航、避开障碍并优化作业 。

John Deere还构建了数据平台,整合来自不同来源的数据,使农民能够可视化田间状况、跟踪设备性能,并就灌溉、施肥和收割等做出数据驱动的决策 。该公司强调边缘计算在其AI战略中的重要性,即在机器层面执行计算,以应对农业现场网络连接不可靠的挑战。其机器配备了坚固耐用的高速处理单元,能够在恶劣的农业环境中运行,机载GPU每秒可执行数万亿次操作,使AI能够在眨眼间(约100毫秒)分析摄像头图像并做出决策 。John Deere Operations Center是其核心的数字中枢,连接农民、顾问和经销商,实现机器与利益相关者之间的无缝数据共享,以及对产量、土壤条件和设备性能的实时分析 。通过与SpaceX等公司的合作,John Deere致力于改善农民的连接性,以实现对精准农业和自动化系统的全面指挥 。John Deere通过“构建、购买、集成”的策略来加速其AI技术的创新和市场推广,例如收购Blue River Technology获得了计算机视觉和机器学习方面的核心技术,收购Bear Flag Robotics拓展了其自主驾驶技术的市场,收购SparkAI则引入了“人在环路”技术以处理AI在不确定情况下的边缘案例 。

4. 挑战与未来发展

4.1 当前技术面临的挑战

尽管AI在农业自动化领域展现出巨大潜力,但其广泛应用仍面临诸多挑战。首先,成本是一个主要障碍。许多先进的AI系统,包括高精度传感器、高性能计算单元、智能机器人等,其初始投资和维护成本相对较高,对于中小型农场而言可能难以承受 。例如,模块化机器人的成本可能是传统设备的3到5倍,而且其平均运行续航时间仅为4小时,能效不足 。其次,可靠性和鲁棒性是AI系统在复杂多变的农业环境中必须克服的难题。农田环境具有高度的不确定性,如光照变化、天气突变、作物形态多样性、土壤类型差异等,这些都可能影响传感器数据的准确性和AI模型的性能。例如,在杂草识别中,作物和杂草在生长不同阶段的外观差异、以及不同田间背景的干扰,都对AI模型的泛化能力和鲁棒性提出了极高要求 。

数据安全和隐私也是日益突出的问题。农业AI系统依赖于大量数据的收集、传输和处理,包括农田地理信息、作物生长数据、农场经营数据等敏感信息。如何确保这些数据在采集、存储、传输和使用过程中的安全性,防止数据泄露、滥用或遭受网络攻击,是亟待解决的关键问题 。此外,数据质量和标注是制约AI模型性能的瓶颈。训练高性能的AI模型需要大量高质量、准确标注的农业数据,但农业数据的获取成本高、标注难度大,且存在地域性和季节性差异,这限制了模型的泛化能力和应用范围 。最后,技术普及和农民接受度也是一个挑战。许多AI农业技术操作复杂,需要使用者具备一定的技术素养,农民对新技术的接受度和使用技能也需要提高 。农村地区的网络连接性差也是一个普遍存在的障碍,许多AI驱动的工具需要持续的互联网连接,而在服务可能有限或不可靠的农村和偏远地区,这是一个关键的路障 。

4.2 未来发展趋势

未来,全AI决策的农业自动化将朝着更加智能化、精准化、高效化和可持续化的方向发展。一个显著的趋势是人工智能与农业的深度融合。基于机器学习和深度学习算法,智能农机装备将实现作物生长信息的精准感知与调控,优化预测分析和决策模型,加载人工智能技术的农业机器将在田间除草、施肥施药、采摘收割等领域加快示范和推广 。例如,“蜂巢(Beehive)”智慧农场操作系统展示了利用作物生长大模型和任务编排大模型,结合大语言模型(LLM)实现Agent协同编排,逐步实现从辅助决策到全自主任务执行的演进 。这将使得农业生产更加依赖数据驱动的智能决策,而非传统经验。边缘计算与云计算协同的深化也是一个核心方向,通过在农场本地部署边缘计算节点,可以处理大量实时数据,进行快速决策和响应,减少对云端计算的依赖和网络延迟 。

另一个重要趋势是多技术融合与系统集成。物联网、大数据、云计算、5G、机器人技术、高精度导航等技术将与AI更紧密地结合,形成更为强大的农业自动化解决方案。智能农机装备将具备全程化、自主化和协同化的作业能力,拓展机器人、无人系统的应用范围,实现各类农机功能的系统整合 。例如,通过多传感器信息融合技术(机器视觉、GNSS、雷达等)为除草机器人等农业机器人提供丰富的感知信息,实现对作物行、杂草、作物植株的精确定位,以及作物生长长势、病虫害和成熟度等信息的感知,为精准作业提供支持 。**可解释性AI(XAI)**的应用将越来越受到重视,通过提供对AI决策过程的解释,可以增强农民对AI系统的信任,并帮助他们更好地理解和应用AI提供的建议 。此外,绿色可持续发展的理念将更加深入人心,AI技术将更多地应用于精准施肥、精准施药、节水灌溉等方面,以减少农业投入品的使用,降低对环境的影响,提高资源利用效率 。

4.3 技术栈偏好与标准化

在全AI决策的农业自动化领域,技术栈的选择呈现出多样性与特定场景适用性相结合的特点,同时标准化工作也在逐步推进,以促进不同系统和设备间的互操作性。在AI算法和模型开发方面,Python 凭借其丰富的库和框架,成为主流的编程语言。深度学习框架如 TensorFlow 和 PyTorch 被广泛应用于图像识别(如病虫害识别、杂草识别、作物成熟度判断)、预测模型(如产量预测、病虫害发生预测)等任务 。例如,有研究采用TensorFlow 2.x构建轻量级CNN模型用于病虫害识别,并利用TensorFlow Lite进行移动端部署 。另一项研究则使用预训练的ResNet50和EfficientNet模型进行植物病害检测 。对于需要快速原型开发和部署的场景,一些开发者会选择在Google Colab等云端平台进行模型训练和测试,这些平台通常提供免费的GPU资源 。

在系统集成和自动化设备控制方面,机器人操作系统(ROS) 扮演着重要角色,尤其是在开发复杂的农业机器人(如自主导航拖拉机、采摘机器人、除草机器人)时。ROS提供了一系列工具和库,用于处理传感器数据、实现机器人运动控制、进行路径规划以及模块间的通信。对于云端和边缘计算平台的部署,容器化技术如 Docker 和容器编排工具如 Kubernetes (及其边缘计算变种如KubeEdge和K3s) 被用于实现AI模型和应用程序的可移植性、可扩展性和高效管理 。例如,AGRARIAN架构就提到了使用Kubernetes、KubeEdge和K3s进行云原生编排,以支持可扩展、容错和分布式的AI计算 。

在通信协议和数据标准化方面,虽然尚未形成完全统一的局面,但一些标准和协议正在被推广。例如,AGRARIAN架构计划通过API接口与农业机械集成,并支持 ISOBUS (ISO 11783) 和 OPC UA (Open Platform Communications Unified Architecture) 等标准 。ISOBUS是农业机械电子控制单元之间通信的国际标准,旨在实现不同品牌农机具的互操作性。OPC UA则是一种工业自动化领域广泛采用的机器对机器通信协议,支持安全、可靠和平台独立的数据交换。这些标准的采用将有助于打破不同厂商设备之间的技术壁垒,促进数据的无缝流动和系统的集成。然而,缺乏统一的行业标准和互操作性仍是当前面临的一大挑战 。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?