矩阵设计(Design Matrix)

矩阵设计(Design Matrix)是统计学、回归分析和机器学习中用来表示数据和模型关系的一种工具。它将样本的特征表示为矩阵形式,用于简化计算,特别是在进行线性回归、多项式回归和其他统计模型时。

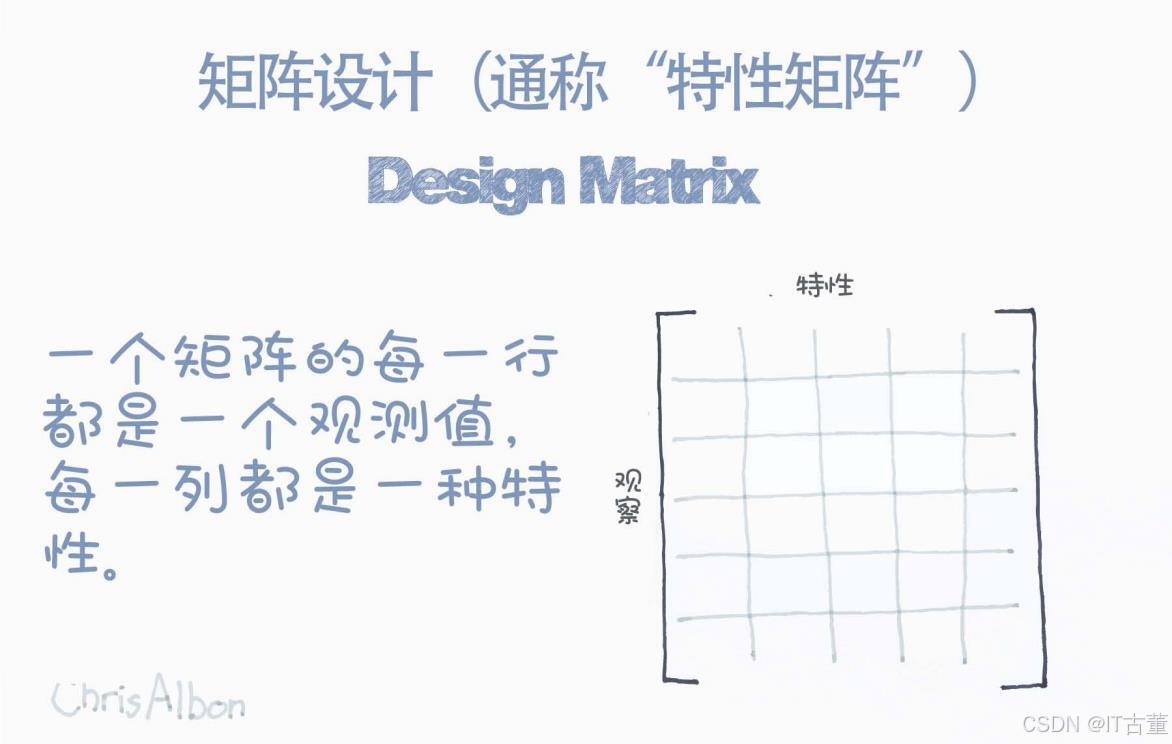

矩阵设计的定义

矩阵设计是一种二维数组,其中每行对应一个样本,每列对应一个特征(自变量)。在矩阵设计中,通常会包含一个常数列(例如全为1的列),用于表示截距项。

若有 nnn 个样本,每个样本有 ppp 个特征,则设计矩阵通常表示为:

其中,第一列为常数 1(对应截距项),其他列为特征值。

矩阵设计的作用

-

简化回归分析计算

通过矩阵形式,线性回归的目标函数可以表示为:其中:

:响应变量(目标值)向量。

:设计矩阵。

:模型系数向量。

:误差向量。

-

适用于多种模型

矩阵设计不仅适用于线性回归,还可以用于多项式回归、逻辑回归等模型。 -

便于扩展和实现

设计矩阵的形式化表示使得数值优化算法(如梯度下降)和矩阵操作(如QR分解、SVD分解)更加高效。

矩阵设计的构建

线性回归

假设有两个特征 和

,设计矩阵为:

多项式回归

对于多项式回归,设计矩阵需包含特征的高次项。例如,对于 ,设计矩阵为:

分类模型

对于分类问题(例如逻辑回归),类别特征通常需要编码(如独热编码),然后添加到设计矩阵中。

线性回归中的应用

在线性回归中,设计矩阵用于解决最小二乘问题。目标是通过最小化残差平方和(RSS)来估计模型参数:

通过矩阵运算,解析解为:

设计矩阵的优缺点

优点

- 统一表示:将数据和模型转换为矩阵形式,便于表示和处理。

- 高效计算:利用矩阵运算可以高效地实现模型的训练和预测。

- 灵活性:支持多种特征变换(如多项式、交互项)和特征编码(如独热编码)。

缺点

- 稀疏性:对于高维数据(如独热编码特征),设计矩阵可能非常稀疏,增加内存需求。

- 特征选择:在高维设计矩阵中,不相关特征可能引入噪声,降低模型性能。

- 扩展性:对于非常大的数据集,直接计算矩阵操作(如求逆)可能不现实。

示例:Python代码

以下为线性回归模型中构建设计矩阵的代码:

import numpy as np

# 样本数据

X = np.array([[1, 2], [3, 4], [5, 6]]) # 特征

y = np.array([7, 8, 9]) # 目标值

# 构建设计矩阵(添加常数列)

X_design = np.hstack([np.ones((X.shape[0], 1)), X])

# 计算线性回归系数,使用伪逆矩阵

beta = np.linalg.pinv(X_design.T @ X_design) @ X_design.T @ y

print("设计矩阵:")

print(X_design)

print("回归系数:", beta)

输出:

设计矩阵:

[[1. 1. 2.]

[1. 3. 4.]

[1. 5. 6.]]

回归系数: [ 4.16666667 -1.83333333 2.33333333]

总结

设计矩阵是构建统计模型和机器学习模型的基础工具。它通过矩阵化表示,将数据处理和模型计算统一,既能提高计算效率,又能简化实现。理解设计矩阵的构建和应用,对于解决回归问题和其他模型训练至关重要。

558

558

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?