本文解析的是一篇ECCV2018的文章,主要内容是对CVPR2017的SENet进行改进。

1.SENet回顾

此论文是由Momenta公司所作并发于2017 CVPR,论文中的SENet赢得了ImageNet最后一届(ImageNet 2017)的图像识别冠军。论文的核心点在对CNN中的feature channel(特征通道依赖性)利用和创新。 论文的动机是从特征通道之间的关系入手,希望显式地建模特征通道之间的相互依赖关系。另外,没有引入一个新的空间维度来进行特征通道间的融合,而是采用了一种全新的“特征重标定”策略。具体来说,就是通过学习的方式来自动获取到每个特征通道的重要程度,然后依照这个重要程度去增强有用的特征并抑制对当前任务用处不大的特征。

论文的核心就是Squeeze和Excitation两个操作。

由此可以让我们考虑以下几个问题:

- SENet存在哪些不足?

- 全局平均池化是否就是最优选择?

- 除了特征通道还可以关注哪些方面?

- 有没有其他轻量级的通用模块?

让我们带着以上疑问进入到CBAM的论文中吧~

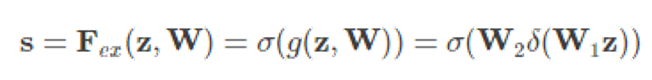

2.卷积块注意力模型CBAM

本文提出了卷积块注意模块(CBAM),这是一种用于前馈卷积神经网络的简单而有效的注意力模块。给定一个中间特征图谱,我们的模块沿着两个独立的维度(通道和空间)依次推断注意力映射,然后将权重乘以输入特征map以进行自适应特征细化。由于CBAM是一个轻量级的通用模块,它可以无缝地集成到任何CNN架构中

本文深入解析了ECCV2018论文《CBAM: Convolutional Block Attention Module》,该论文针对SENet进行了改进,提出了一种新的注意力模块——CBAM,它在通道和空间维度上进行注意力推断,提升CNN性能。CBAM包含通道注意力和空间注意力两个模块,实验表明顺序排列的CBAM模块效果更佳,同时CBAM在目标区域覆盖和特征聚合方面表现出色。

本文深入解析了ECCV2018论文《CBAM: Convolutional Block Attention Module》,该论文针对SENet进行了改进,提出了一种新的注意力模块——CBAM,它在通道和空间维度上进行注意力推断,提升CNN性能。CBAM包含通道注意力和空间注意力两个模块,实验表明顺序排列的CBAM模块效果更佳,同时CBAM在目标区域覆盖和特征聚合方面表现出色。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3122

3122

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?