基于 Learning Efficient Convolutional Networks Through Network Slimming (ICCV 2017) 论文的模型压缩。

目前有很多的开源实现,基于各种方法对YOLOv3进行裁剪和压缩,例如:

等等...

数据集

收费卡口的车辆车轮数据,2266训练集,530验证集。

原理

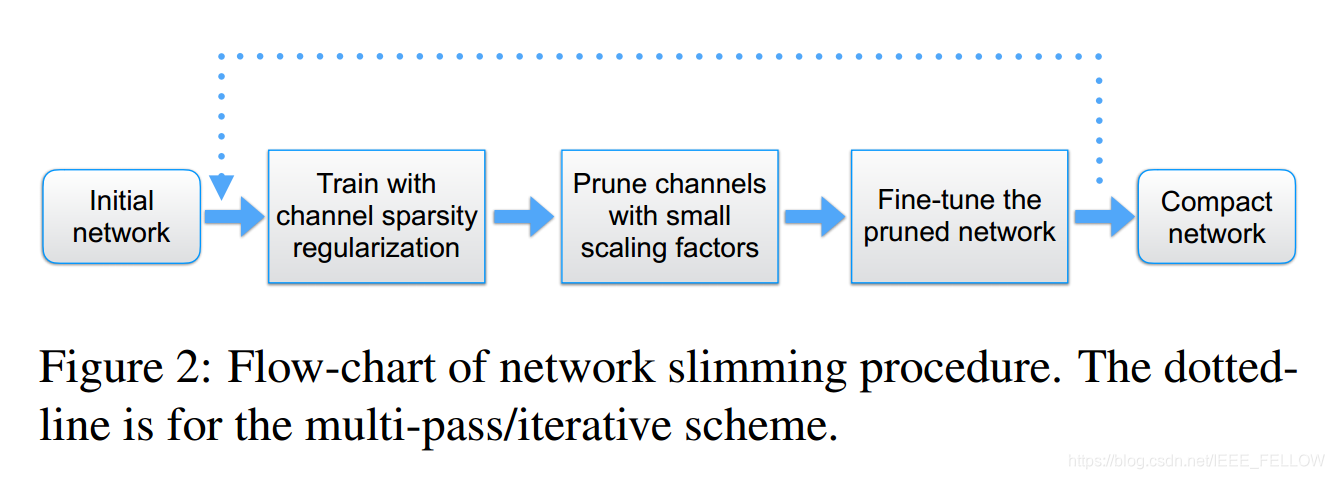

对于一个训练好的模型,会发现部分卷积核权重很小,因此相应的激活也会很小,这部分卷积核的贡献其实是很小的,裁剪这些卷积核后再微调是可以恢复到之前的精度,这是在未作任何限制情况下,如果对权重做某些限制,如L1正则,那么训练的参数会比较稀疏,更加利于裁剪。论文给出,在BN层的Scale层其实相当于对激活的一个线性变换,那么Scale层的Gamma做一个L1

正则,会学习到比较稀疏的Gamma,这部分Gamma会导致卷积通过BN的Scale层后输出很小,这样的通道是可以裁剪掉的,这就是论文的核心思想。详细原理参考相关论文。

裁剪流程

稀疏训练->裁剪->微调

其中最关键的当属稀疏训练。

实验过程记录

| Metric | mAP | Parameters | Inference | Model Size/M | Parameters Decrease |

|---|---|---|---|---|---|

| orignal YOLOv3 | 0.899230 | 61529119 | 0.0170 | 246.5 | 0 |

| pruned | 0.899493 | 589799 | 0.0074 | 2.4 | 99.04% |

可以看到,极限压缩YOLOv3的大小仅仅2.4M,参数虽然少依然可以获得良好的性能,一方面是因为我们的检测任务相对单一和简单,类别比较少,原始的YOLOv3模型庞大,能够处理更多的复杂(COCO等)的检测任务,对于简单任务是不需要那么多参数的,实际测试发现,压缩后的模型在大多数任务上依然有很好的表现,但是在极端场景下的检测相对不那么鲁棒,鱼与熊掌不可兼得。

压缩后的模型实测效果如下:

本文介绍基于LearningEfficientConvolutionalNetworksThroughNetworkSlimming论文的YOLOv3模型压缩方法,通过稀疏训练、裁剪和微调流程,极限压缩YOLOv3模型至2.4M,参数减少99.04%,仍保持良好检测性能。

本文介绍基于LearningEfficientConvolutionalNetworksThroughNetworkSlimming论文的YOLOv3模型压缩方法,通过稀疏训练、裁剪和微调流程,极限压缩YOLOv3模型至2.4M,参数减少99.04%,仍保持良好检测性能。

822

822

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?