本系列文章主要是分享一些关于大模型的一些学术研究或者实验性质的探索,为大家更新一些针对大模型的认知。所有的结论我都会附上对应的参考文献,有理有据,也希望这些内容可以对大家使用大模型的过程有一些启发。

注:本系列研究关注的是大型语言模型(Large Language Models, LLMs)的普遍特性,而非专指GPT。在文中,我们使用“GPT”作为一个典型例子来代表这一类模型,但请读者注意,所讨论的观点和结论通常也适用于其他同类大型模型。这样的表述旨在简化叙述,同时也强调了这些发现的广泛适用性。

不定期更新,敬请期待~

Chain-of-Thought(CoT, 思维链)其实是一种日用而不知的技巧。

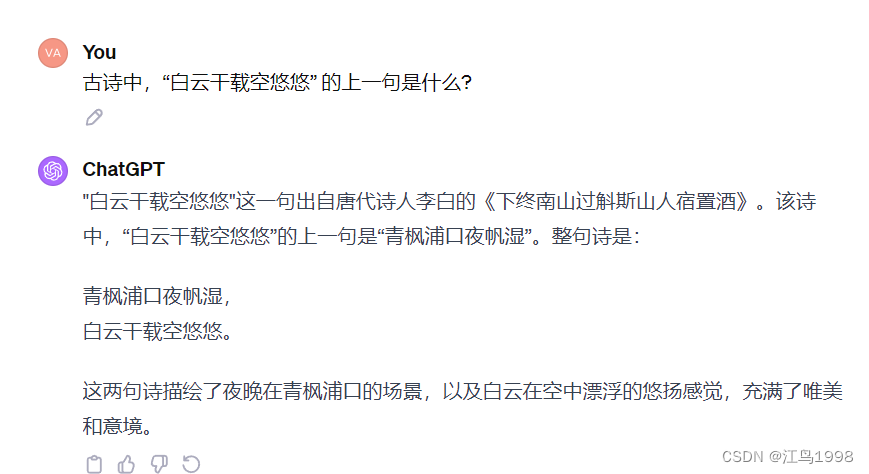

首先看一个例子,还是上一篇的例子举例:

我还是这么提问:

古诗中,“白云千载空悠悠”的上一句是什么?

此时再一次生成了一个非常不靠谱的回答。

什么是“思维链提示方法”呢?

没有思维链提示方法的时候,对于上面这个问题,就只能听天由命,等待大语言模型每一次运行产生的一个随机结果中可能有一个是正确的…

那么,使用思维链提示词的方法怎么得到答案呢?你要这么一步步引导GPT得到正确答案。

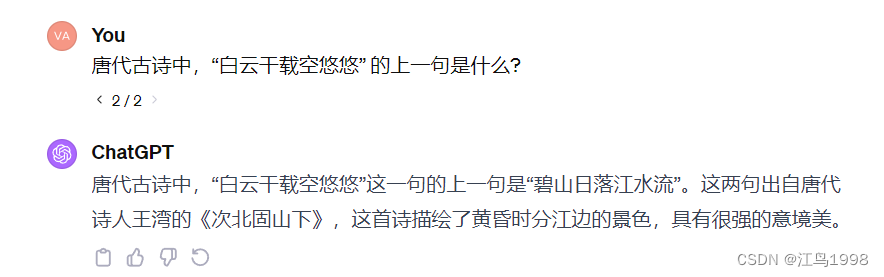

现在,额外告诉GPT一个信息,看一下GPT能否猜出来。

看

本文探讨了大型语言模型(如GPT)中的Chain-of-Thought(CoT)或思维链提示技巧,通过实例展示如何通过提供推理过程引导模型得出更准确的答案,以克服逆转诅咒现象。研究者引用了相关论文来支持这一策略的有效性。

本文探讨了大型语言模型(如GPT)中的Chain-of-Thought(CoT)或思维链提示技巧,通过实例展示如何通过提供推理过程引导模型得出更准确的答案,以克服逆转诅咒现象。研究者引用了相关论文来支持这一策略的有效性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

807

807

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?