英伟达于美国当地时间9日发布了专为大规模上下文推理与视频生成AI应用设计的Rubin CPX GPU。该芯片基于“Rubin”架构打造,但在具体设计上区别于此前已公布的Rubin Tensor Core GPU,展现出更明确的专业应用倾向。

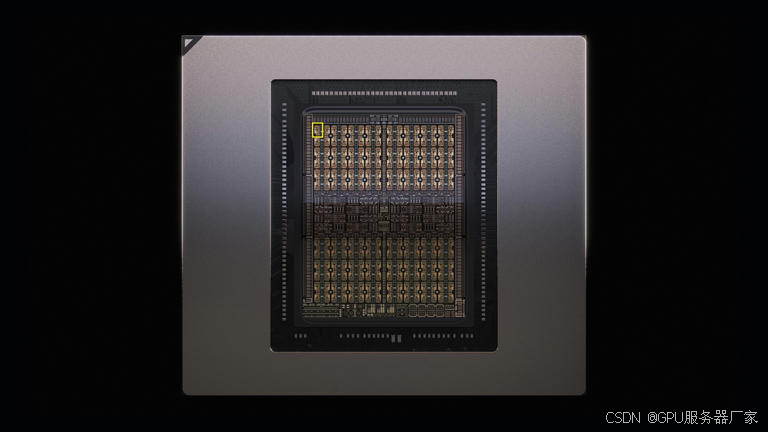

Rubin CPX采用高性价比的单片式结构,强化了对NVFP4数据格式的计算支持,并集成NVENC/NVDNC视频编解码单元。其搭载128GB GDDR7显存,据官方渲染图显示,GPU内部包含192组重复单元,应对应于192组SM(Streaming Multiprocessor),规模与GB202相当。

从显存带宽推测,单个Rubin CPX GPU带宽约为2083 GB/s。考虑到512位显存位宽的GeForce RTX 5090带宽为1792 GB/s,而Rubin CPX显存容量为128GB,可推断其同样具备512-bit位宽,等效显存速率约32.55 Gbps。

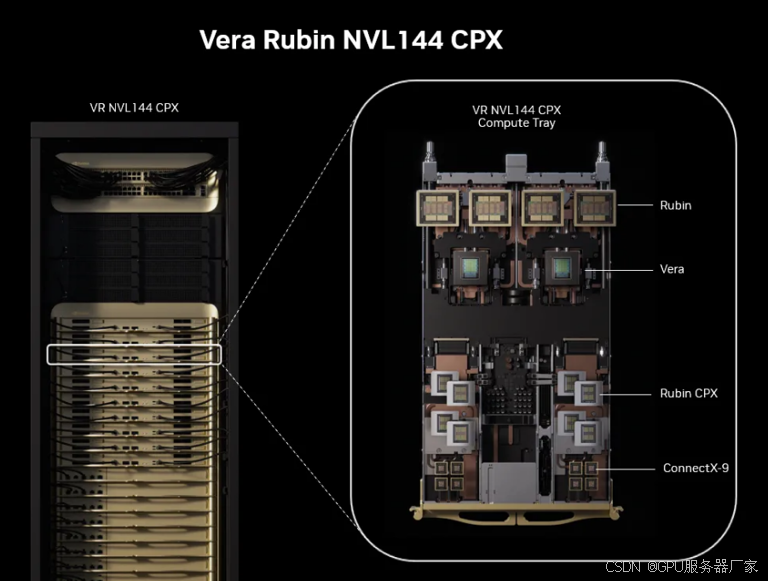

在系统层面,Vera Rubin NVL144 CPX机架系统新增144块Rubin CPX GPU,带来4.4 EFLOPS的NVFP4算力提升、0.3 PB/s的显存带宽增长及25TB快速存储扩展。英伟达宣称,全机架系统Vera Rubin NVL144 CPX可提供高达8 exaflops的AI计算性能。

Rubin CPX被定位为一款专注于大规模上下文处理的专用GPU,尤其适用于需要处理极长上下文的任务,如大规模编码和视频生成。该硬件将“理解AI提示”与“生成响应”两个阶段分离,从而提高整体推理效率。

CEO黄仁勋将其重要性比作当年RTX对图形与物理AI的革命:“正如RTX彻底改变了图形和物理AI,Rubin CPX是首款专为大规模上下文AI设计的CUDA GPU,可推理跨越数百万知识符号的模型。”他还强调其经济价值,称1亿美元的投资可带来50亿美元的潜在收益。

Rubin CPX将获得英伟达全栈软件支持,包括Nemotron系列开放多模态模型。该系列涵盖从设备端Nano版本、单GPU适用的Super版,到数据中心级的Ultra版本,旨在帮助企业构建可自主处理复杂任务的AI代理。

英伟达表示,Rubin CPX预计将于2026年底正式上市。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?