机器学习期末题库

1.属于监督学习的机器学习算法是:贝叶斯分类器

2.属于⽆监督学习的机器学习算法是:层次聚类

3.⼆项式分布的共轭分布是:Beta分布

4.多项式分布的共轭分布是:Dirichlet分布

5.朴素贝叶斯分类器的特点是:假设样本各维属性独⽴

6.下列⽅法没有考虑先验分布的是:最⼤似然估计

7.对于正态密度的贝叶斯分类器,各类协⽅差矩阵相同时,决策函数为:线性决策函数

8.下列属于线性分类⽅法的是:感知机

9.下列⽅法不受数据归⼀化影响的是:决策树

10.下列分类⽅法中不会⽤到梯度下降法的是:最⼩距离分类器

11.下列⽅法使⽤最⼤似然估计的是:Logistic回归

12.关于线性鉴别分析的描述最准确的是,找到⼀个投影⽅向,使得:类内距离最⼩,类间距离最⼤

13.SVM的原理的简单描述,可概括为:最⼤间隔分类

14.SVM的算法性能取决于:以上都有(核函数的选择、核函数的参数、软间隔参数C)

15.⽀持向量机的对偶问题是:凸⼆次优化

16.以下对⽀持向量机中的⽀撑向量描述正确的是:最⼤间隔⽀撑⾯上的向量

17.假定你使⽤阶数为2的线性核SVM,将模型应⽤到实际数据集上后,其训练准确率和测试准确率均为100%。现在增加模型复杂度(增加核函数的阶),会发⽣以下哪种情况:过拟合

18.避免直接的复杂⾮线性变换,采⽤线性⼿段实现⾮线性学习的⽅法是:核函数⽅法

19.关于决策树节点划分指标描述正确的是:信息增益越⼤越好

20.以下描述中,属于决策树策略的是:最⼤信息增益

21.集成学习中基分类器的选择如何,学习效率通常越好:分类器多样,差异⼤

22.集成学习中,每个基分类器的正确率的最低要求:50%以上

23.下⾯属于Bagging⽅法的特点是:构造训练集时采⽤Bootstraping的⽅式

24.下⾯属于Bagging⽅法的特点是:构造训练集时采⽤Bootstraping的⽅式

25.随机森林⽅法属于:Bagging⽅法

26.假定有⼀个数据集S,但该数据集有很多误差,采⽤软间隔SVM训练,阈值为C,如果C的值很⼩,以下哪种说法正确:会发⽣误分类现象

27.软间隔SVM的阈值趋于⽆穷,下⾯哪种说法正确:只要最佳分类超平⾯存在,它就能将所有数据全部正确分类

28.⼀般,K-NN最近邻⽅法在什么情况下效果好:样本较少但典型性较好

29.回归问题和分类问题的区别:前者预测函数值为连续值,后者为离散值

30.最⼩⼆乘回归⽅法的等效回归⽅法:线性均值和正态误差的最⼤似然回归

31.正则化的回归分析,可以避免:过拟合

32.“啤酒-纸尿布”问题讲述的是,超市购物中,通过分析购物单发现,买了纸尿布的男⼠,往往⼜买了啤酒。这是⼀个什么问题:关联分析

33.KL散度是根据什么构造的可分性判据:类概率密度

34.密度聚类⽅法充分考虑了样本间的什么关系:密度可达

35.混合⾼斯聚类中,运⽤了以下哪种过程:EM算法

36.主成分分析是⼀种什么⽅法:降维⽅法

37.PCA在做降维处理时,优先选取哪些特征:中⼼化样本的协⽅差矩阵的最⼤特征值对应特征向量

38.过拟合现象中:训练样本的测试误差最⼩,测试样本的正确识别率却很低

39.如右图所⽰有向图,节点G的马尔可夫毯为:{D,E,F,H,I,J}

40.如右图所⽰⽆向图,节点G的马尔可夫毯为:{D,E,I,J}

41.多层感知机⽅法中,可⽤作神经元的⾮线性激活函数:Logistic函数

42.在有限⽀撑集上,下⾯分布的熵最⼤:均匀分布

43.已知均值和⽅差,下⾯哪种分布的熵最⼤:⾼斯分布

44.以下模型中属于概率图模型的是:受限玻尔兹曼机

45.如右图所⽰有向图,以下陈述正确的有:B和G关于{C,F}条件独⽴

46.在标准化公式中,使⽤的⽬的是:防⽌分母为零

47.梯度下降算法的正确步骤是什么:4,3,1,5,2 (初始化-输⼊-计算误差-改变权重以减⼩误差-迭代更新)

(1)计算预测值和真实值之间的误差

(2)迭代跟新,直到找到最佳权重

(3)把输⼊传⼊⽹络,得到输出值

(4)初始化随机权重和偏差

(5)对每⼀个产⽣误差的神经元,改变相应的(权重)值以减⼩误差

48.假如使⽤⼀个较复杂的回归模型来拟合样本数据,使⽤岭回归,调试正则化参数,来降低模型复杂度。若λ较⼤时,关于偏差和⽅差,下列说法正确的是:若λ较⼤时,偏差减⼩,⽅差减⼩

49.以下哪种⽅法会增加模型的⽋拟合风险:数据增强

50.以下说法正确的是:除了EM算法,梯度下降也可求混合⾼斯模型的参数

51.在训练神经⽹络时,如果出现训练error过⾼,下列哪种⽅法不能⼤幅度降低训练error:增加训练数据

52.以下哪种激活函数可以导致梯度消失:Tanh

53.增加以下哪些超参数可能导致随机森林模型过拟合数据:(2)决策树的深度

54.以下关于深度⽹络训练的说法正确的是:D

A.训练过程需要⽤到梯度,梯度衡量了损失函数相对于模型参数的变化率

B.损失函数衡量了模型预测结果与真实值之间的差异

C.训练过程基于⼀种叫做反向传播的技术

D.其他选项都正确

55.以下哪⼀项在神经⽹络中引⼊了⾮线性:ReLU

56.在线性回归中使⽤正则项,你发现解的不少coefficient都是0,则这个正则项可能是:

L0-norm、L1-norm

57.关于CNN,以下结论正确的是:Pooling层⽤于减少图⽚的空间分辨率

58.关于k-means算法,正确的描述是:初始值不同,最终结果可能不同

59.下列关于过拟合现象的描述中,哪个是正确的:训练误差⼩,测试误差⼤

60.以下关于卷积神经⽹络,说法正确的是:卷积神经⽹络可以有多个卷积核,可以不同⼤⼩

61.LR模型的损失函数是:交叉熵

62.GRU和LSTM的说法正确的是:GRU的参数⽐LSTM的参数少

63.以下⽅法不可以⽤于特征降维的有:Monte Carlo method

64.下列哪个函数不可以做激活函数:y=2x

65.有两个样本点,第⼀个点为正样本,它的特征向量是(0,-1);第⼆个点为负样本,它的特征向量是(2,3),从这两个样本点组成的训练集构建⼀个线性SVM分类器的分类⾯⽅程是:x+2y=3

66.在其他条件不变的前提下,以下哪种做法容易引起机器学习中的过拟合问题:SVM算法中使⽤⾼斯核代替线性核

67.下⽅法中属于⽆监督学习算法的是:K-Means聚类

68.Bootstrap数据是什么意思:有放回地从总共N个样本中抽样n个样本

69.下⾯关于贝叶斯分类器描述错误的是:是基于后验概率,推导出先验概率

70.下⾯关于Adaboost算法的描述中,错误的是:同时独⽴地学习多个弱分类器

71.以下机器学习中,在数据预处理时,不需要考虑归⼀化处理的是:树形模型

72.⼆分类任务中,有三个分类器h1,h2,h3,三个测试样本x1,x2,x3。假设1表⽰分类结果正确,0表⽰错误,h1在x1,x2,x3的结果分别(1,1,0),h2,h3分别为(0,1,1),(1,0,1),按投票法集成三个分类器,下列说法正确的是:集成提⾼了性能

73.有关机器学习分类算法的Precision和Recall,以下定义中正确的是(假定tp = true positive, tn = true negative, fp = false positive, fn =false negative):

Precision= tp / (tp + fp), Recall = tp / (tp + fn)

74.下列哪个不属于常⽤的⽂本分类的特征选择算法:主成分分析

75.在HMM中,如果已知观察序列和产⽣观察序列的状态序列,那么可⽤以下哪种⽅法直接进⾏参数估计:极⼤似然估计

76.以下哪种距离会侧重考虑向量的⽅向:余弦距离

77.解决隐马模型中预测问题的算法是:维特⽐算法

78.在Logistic Regression 中,如果同时加⼊L1和L2范数,会产⽣什么效果:可以做特征选择,并在⼀定程度上防⽌过拟合

79.普通反向传播算法和随时间的反向传播算法(BPTT)有什么技术上的不同:与普通反向传播不同的是,BPTT会在每个时间步长内叠加所有对应权重的梯度

80.梯度爆炸问题是指在训练深度神经⽹络的时候,梯度变得过⼤⽽损失函数变为⽆穷。在RNN中,下⾯哪种⽅法可以较好地处理梯度爆炸

问题:梯度裁剪

81.当训练⼀个神经⽹络来作图像识别任务时,通常会绘制⼀张训练集误差和验证集误差图来进⾏调试。在下图中,最好在哪个时间停⽌训

练:C

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-ctS8tH71-1655199702381)(C:\Users\Crescent_P\AppData\Roaming\Typora\typora-user-images\image-20220612170843797.png)]

第 1 题

一个计算机程序从经验E中学习任务T,并用P来衡量表现。并且,T的表现P随着经验E的增加而提高。

假设我们给一个学习算法输入了很多历史天气的数据,让它学会预测天气。什么是P的合理选择?

A. 计算大量历史气象数据的过程

B. 以上都不

C. 正确预测未来日期天气的概率

D. 天气预报任务

第 2 题

假设你正在做天气预报,并使用算法预测明天气温(摄氏度/华氏度),你会把这当作一个分类问题还是一个回归问题?

A. 分类

B. 回归

第 3 题

假设你在做股市预测。你想预测某家公司是否会在未来7天内宣布破产(通过对之前面临破产风险的类似公司的数据进行训练)。你会把这当作一个分类问题还是一个回归问题?

A. 分类

B. 回归

第 4 题

下面的一些问题最好使用有监督的学习算法来解决,而其他问题则应该使用无监督的学习算法来解决。以下哪一项你会使用监督学习?(选择所有适用的选项)在每种情况下,假设有适当的数据集可供算法学习。

A. 根据一个人的基因(DNA)数据,预测他/她的未来10年患糖尿病的几率

B. 根据心脏病患者的大量医疗记录数据集,尝试了解是否有不同类患者群,我们可以为其量身定制不同的治疗方案

C. 让计算机检查一段音频,并对该音频中是否有人声(即人声歌唱)或是否只有乐器(而没有人声)进行分类

D. 给出1000名医疗患者对实验药物的反应(如治疗效果、副作用等)的数据,发现患者对药物的反应是否有不同的类别或“类型”,如果有,这些类别是什么

第 5 题

哪一个是机器学习的合理定义?

A. 机器学习从标记的数据中学习

B. 机器学习能使计算机能够在没有明确编程的情况下学习

C. 机器学习是计算机编程的科学

D. 机器学习是允许机器人智能行动的领域

第 6 题

基于一个学生在大学一年级的表现,预测他在大学二年级表现。

令x等于学生在大学第一年得到的“A”的个数(包括A-,A和A+成绩)学生在大学第一年得到的成绩。预测y的值:第二年获得的“A”级的数量

这里每一行是一个训练数据。在线性回归中,我们的假设hθ(x)=θ0+θ1x,并且我们使用m来表示训练示例的数量。

| x | y |

| 3 | 2 |

| 1 | 2 |

| 0 | 1 |

| 4 | 3 |

对于上面给出的训练集(注意,此训练集也可以在本测验的其他问题中引用),m的值是多少?

第 7 题

对于这个问题,假设我们使用第一题中的训练集。并且,我们对代价函数的定义是J(θ0,θ1)=12m∑i=1m(hθ(x(i))−y(i))2

求J(0,1)

第 8 题

令问题1中,线性回归假设的θ0=−1,θ1=2,求hθ(6)?

第 9 题

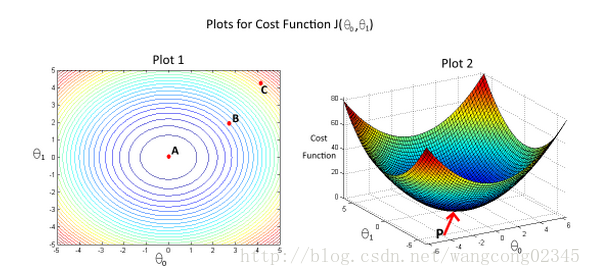

代价函数J(θ0,θ1)与θ0,θ1的关系如图2所示。“图1”中给出了相同代价函数的等高线图。根据图示,选择正确的选项(选出所有正确项)

A. 从B点开始,学习率合适的梯度下降算法会最终帮助我们到达或者接近A点,即代价函数J(θ0,θ1)在A点有最小值

B. 点P(图2的全局最小值)对应于图1的点C

C. 从B点开始,学习率合适的梯度下降算法会最终帮助我们到达或者接近C点,即代价函数J(θ0,θ1)在C点有最小值

D. 从B点开始,学习率合适的梯度下降算法会最终帮助我们到达或者接近A点,即代价函数J(θ0,θ1)在A点有最大值

E. 点P(图2的全局最小值)对应于图1的点A

第 10 题

假设对于某个线性回归问题(比如预测房价),我们有一些训练集,对于我们的训练集,我们能够找到一些θ0,θ1,使得J(θ0,θ1)=0。

以下哪项陈述是正确的?(选出所有正确项)

A. 为了实现这一点,我们必须有θ0=0,θ1=0,这样才能使J(θ0,θ1)=0

B. 对于满足J(θ0,θ1)=0的θ0,θ1的值,其对于每个训练例子(x(i),y(i)),都有hθ(x(i))=y(i)

C. 这是不可能的:通过J(θ0,θ1)=0的定义,不可能存在θ0,θ1使得J(θ0,θ1)=0

D. 即使对于我们还没有看到的新例子,我们也可以完美地预测y的值(例如,我们可以完美地预测我们尚未见过的新房的价格)

第 11 题

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-eIxCOuA6-1655199702382)(C:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1021

1021

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?