文件有些没法上传,直接贴了笔记的链接,maven本地资源包在链接里

链接:http://note.youdao.com/noteshare?id=a903e06ec06fdffabb903617d1c5f83d&sub=5A8AABF124DD4FF99F4954CAEA1CA709

1.新建项目,配置好对应的环境

(1)配置scala环境

settings=>Plugins=>搜索scala

可以看到idea中的scala版本,可以直接下载

下方三个按钮,第二个可以直接在idea下载(但是会比较慢)

第三个按钮,可以在网上下载上方对应的版本,下载在本地,然后在本地中选择下载好的scala

创建maven项目

配置pom文件

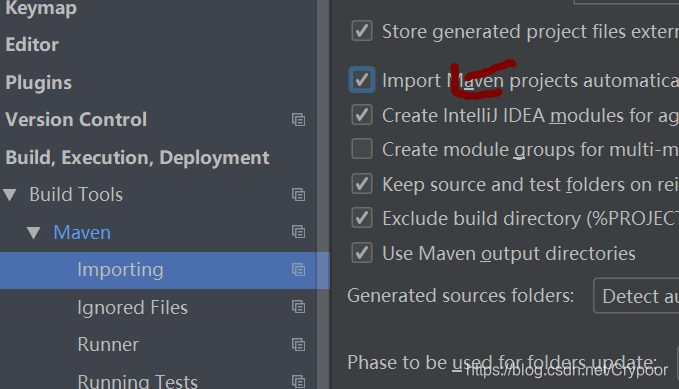

自动导入

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>spark</groupId>

<artifactId>spark</artifactId>

<version>1.0</version>

<!-- 声明公有的属性 -->

<properties>

<maven.compiler.source>1.8</maven.compiler.source>

<maven.compiler.target>1.8</maven.compiler.target>

<encoding>UTF-8</encoding>

<scala.version>2.11.8</scala.version>

<spark.version>2.2.0</spark.version>

<hadoop.version>2.7.1</hadoop.version>

<scala.compat.version>2.11</scala.compat.version>

</properties>

<!-- 声明并引入公有的依赖 -->

<dependencies>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>${scala.version}</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.11</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_2.11</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming_2.11</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>${hadoop.version}</version>

</dependency>

</dependencies>

<!-- 配置构建信息 -->

<build>

<!-- 资源文件夹 -->

<sourceDirectory>src/main/scala</sourceDirectory>

<!-- 声明并引入构建的插件 -->

<plugins>

<!-- 用于编译Scala代码到class -->

<plugin>

<groupId>net.alchim31.maven</groupId>

<artifactId>scala-maven-plugin</artifactId>

<version>3.2.2</version>

<executions>

<execution>

<goals>

<goal>compile</goal>

<goal>testCompile</goal>

</goals>

<configuration>

<args>

<arg>-dependencyfile</arg>

<arg>${project.build.directory}/.scala_dependencies</arg>

</args>

</configuration>

</execution>

</executions>

</plugin>

<plugin>

<!-- 程序打包 -->

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-shade-plugin</artifactId>

<version>2.4.3</version>

<executions>

<execution>

<phase>package</phase>

<goals>

<goal>shade</goal>

</goals>

<configuration>

<!-- 过滤掉以下文件,不打包 :解决包重复引用导致的打包错误-->

<filters>

<filter><artifact>*:*</artifact>

<excludes>

<exclude>META-INF/*.SF</exclude>

<exclude>META-INF/*.DSA</exclude>

<exclude>META-INF/*.RSA</exclude>

</excludes>

</filter>

</filters>

<transformers>

<!-- 打成可执行的jar包 的主方法入口-->

<transformer implementation="org.apache.maven.plugins.shade.resource.ManifestResourceTransformer">

<mainClass></mainClass>

</transformer>

</transformers>

</configuration>

</execution>

</executions>

</plugin>

</plugins>

</build>

</project>

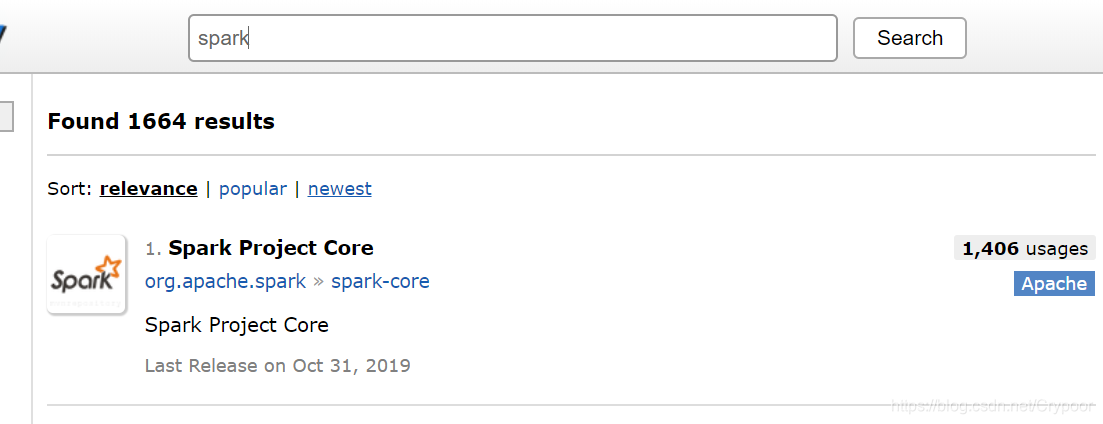

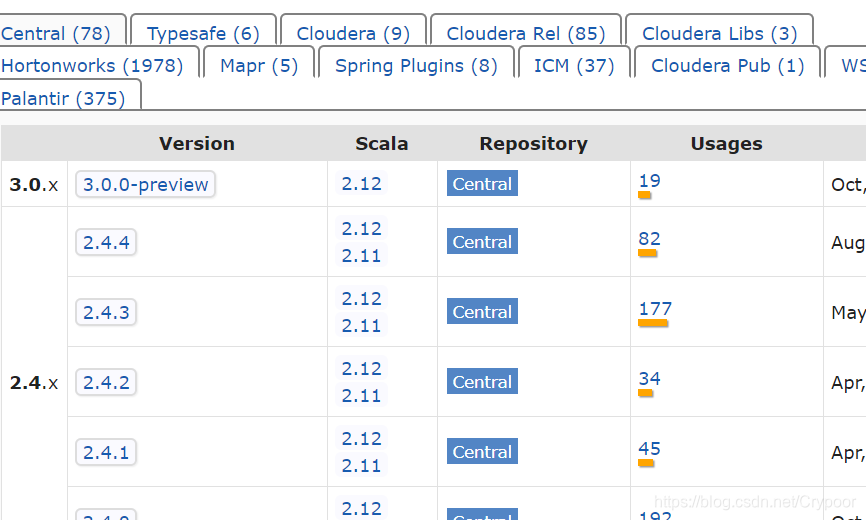

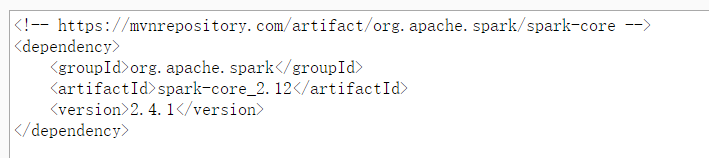

这是一般spark所需的pom文件,具体的版本依赖可以到maven资源库下载

maven资源库地址:https://mvnrepository.com/

将对应的依赖导入,要对应版本

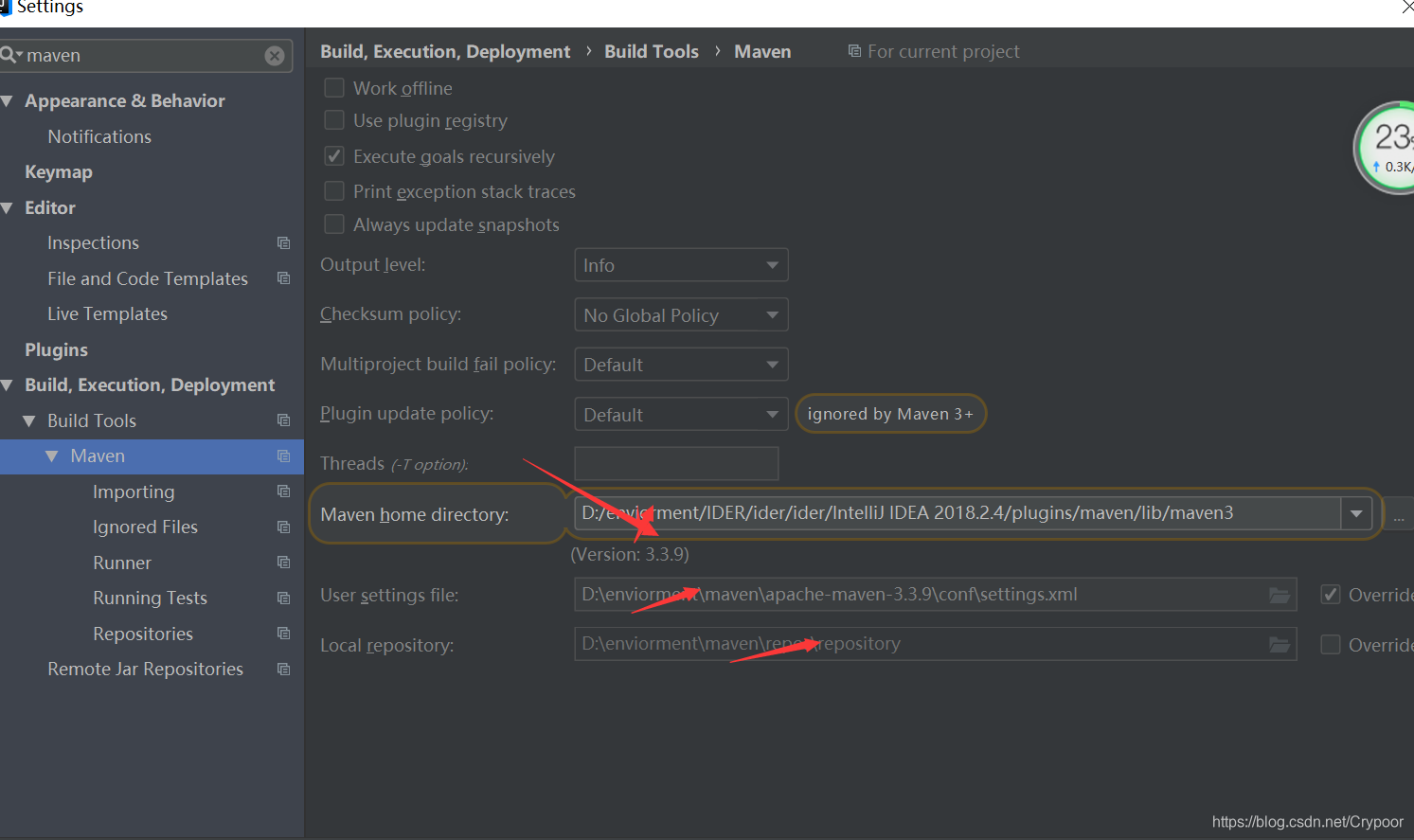

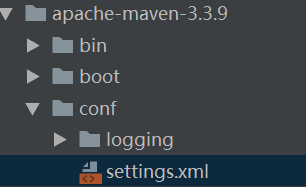

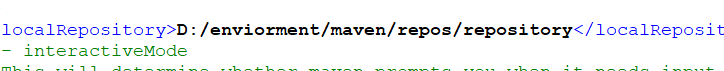

配置maven资源,settings=>搜索maven

这三个需要进行修改

maven的本地资源包,在附件,将它解压

第一个剪头,选择maven资源包的位置

第二个选择 选择settings文件,不过settings文件需要改下路径

这是settings文件里的资源路径,修改下,对应的路径

第三个路径其实就是settings 修改的路径

勾选上自动导入

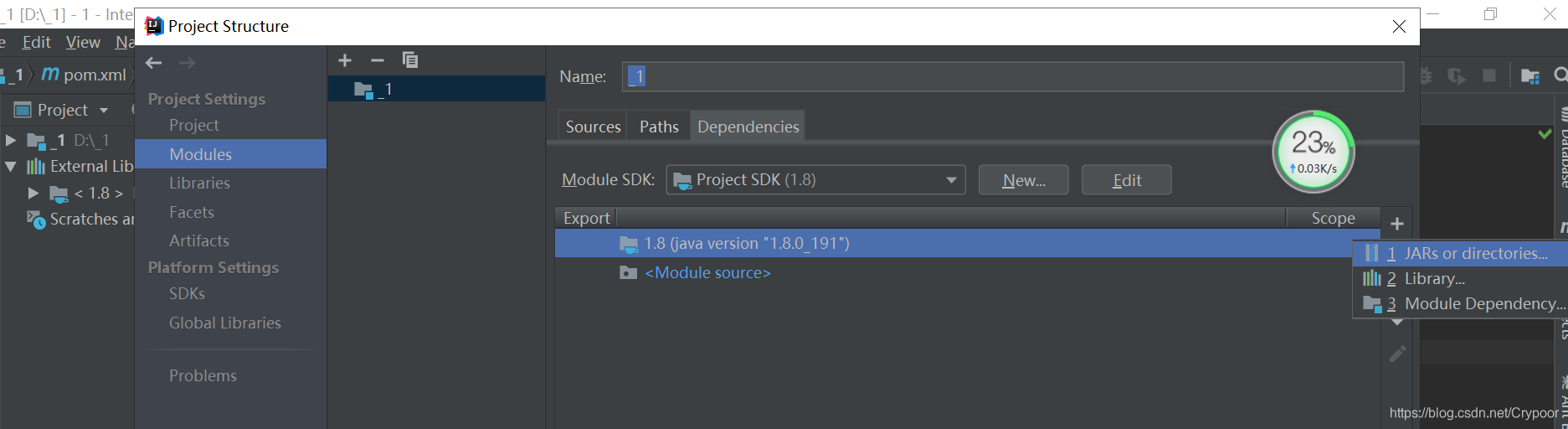

一般缺什么jar可以在 project structure 的modules 选择+ JARS OR… 导入对应的jar即可

本文介绍了如何在IntelliJ IDEA中配置Spark开发环境,包括安装Scala插件、创建Maven项目、配置pom.xml文件以引入Spark相关依赖,并提供了maven资源库的链接和本地Maven设置的详细步骤,确保项目的顺利构建。

本文介绍了如何在IntelliJ IDEA中配置Spark开发环境,包括安装Scala插件、创建Maven项目、配置pom.xml文件以引入Spark相关依赖,并提供了maven资源库的链接和本地Maven设置的详细步骤,确保项目的顺利构建。

8846

8846

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?