Introduction

文章将Vision-RWKV引入Style Transfer 领域,主要创新点有以下三点:

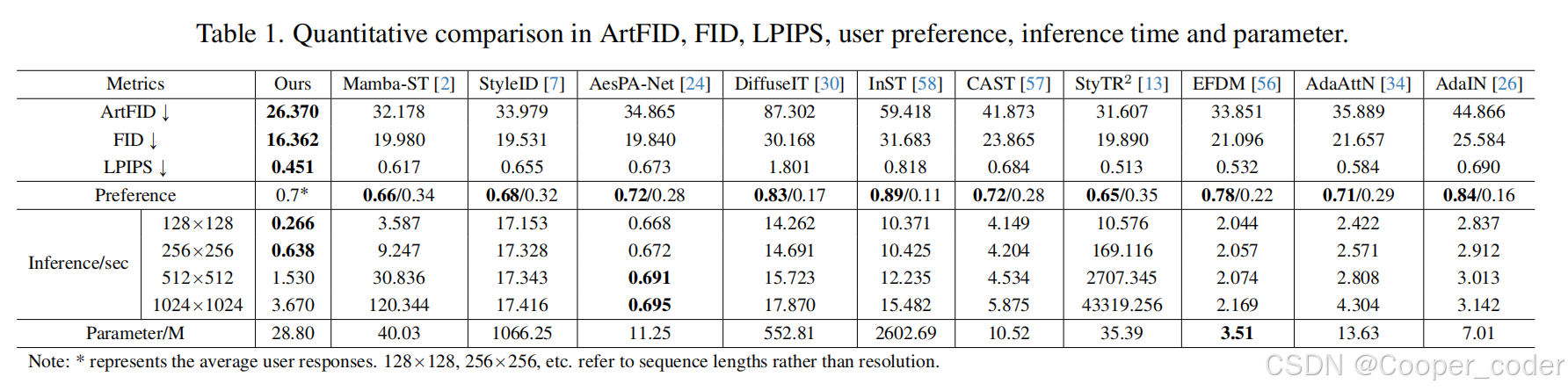

- 提出 StyleRWKV 模型:这是一种用于风格迁移任务的新型 RWKV-like 模型,在低分辨率和高分辨率图像上均能实现高效的线性时间复杂度、低内存使用和全局感受野,为风格迁移提供了新的解决方案。

- 引入 Recurrent WKV 注意力机制(Re-WKV)

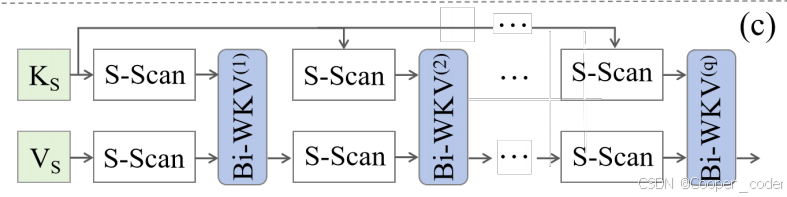

- 采用双向注意力机制,通过沿着 Skip Scanning(S-Scanning)方向循环引入 Bidirectional WKV(Bi-WKV)注意力,有效捕获全局依赖关系,且计算复杂度为线性,克服了原始 RWKV 中单向因果 WKV 注意力在图像应用中的局限性。

- 实验表明,增加 Re-WKV 的循环次数(q)可增强模型的全局建模能力,使风格化结果中对象边缘更清晰,但会增加推理时间,综合考虑后选择 q = 2 作为最优权衡。

- 提出 Deformable Shifting(Deform-Shifting)模块

- 利用可变形卷积动态学习偏移量,从感兴趣区域(ROIs)中移动和融合相邻令牌,以更好地捕捉图像对象结构内的局部依赖关系,增强了对 ROIs 的建模能力,从而提升了风格化效果。

- 实验证明,Deform-Shifting 在强调和增强 ROIs 的风格化方面表现更优,但相比其他方法会略微增加推理时间。

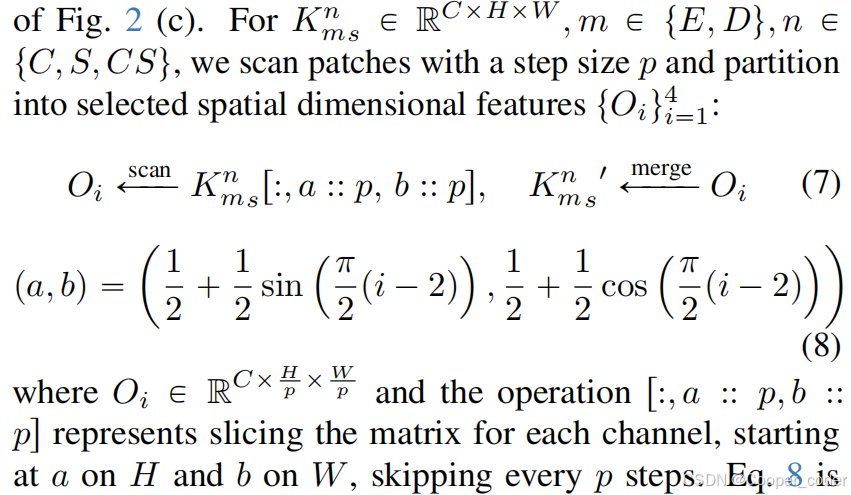

- 设计 Skip Scanning(S-Scanning)机制

- 采用基于空洞采样策略的 S-Scanning 方法,以步长 p 扫描补丁,能建立远距离补丁间的空间关系,整合不同区域信息,提高风格迁移的一致性,其性能优于双向和锯齿形扫描方法。

- 实验显示,当跳过步长 p = 2 时,S-Scanning 在性能和效率之间取得了良好平衡。

Methodology

1.StyleRwkv

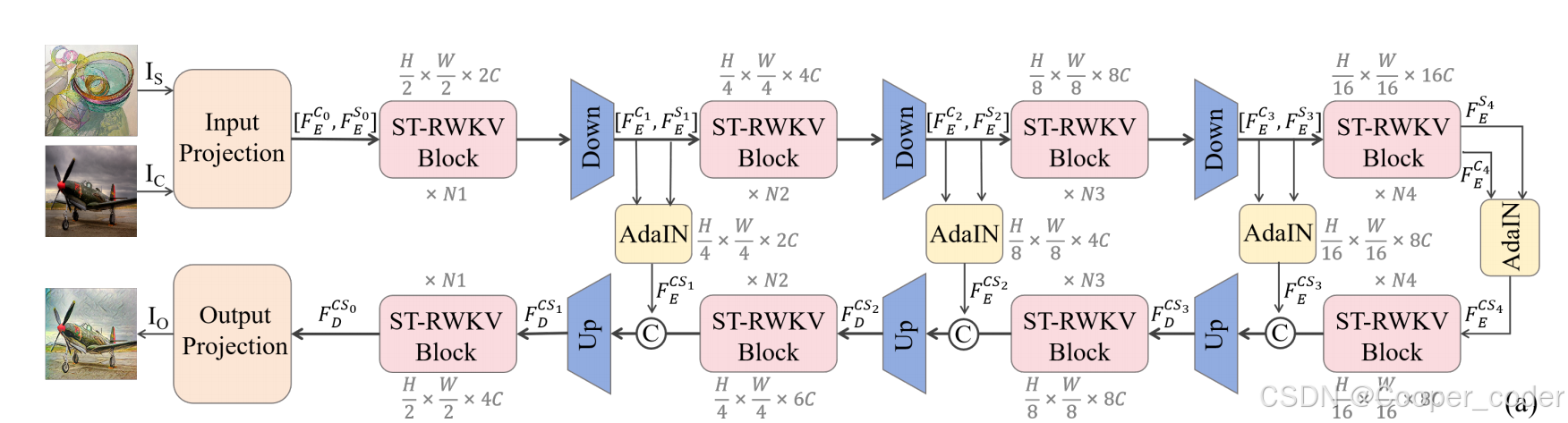

1.1 Architetcture

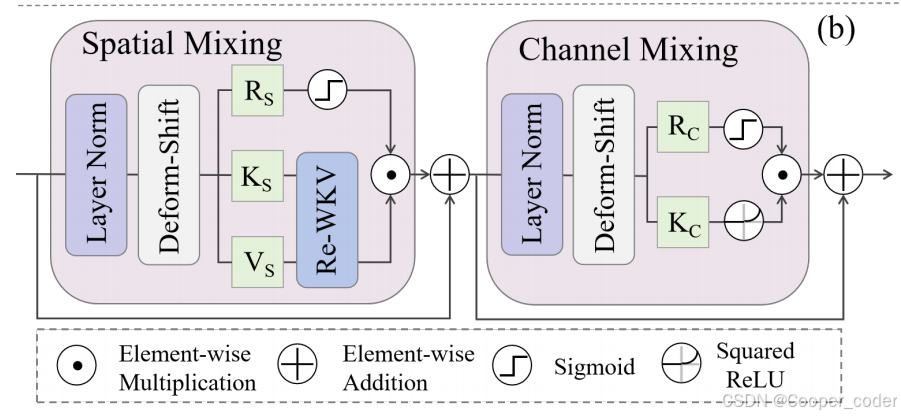

1.2 ST-RWKV Block

2.Re-RWKV

作者通过循环计算WKV注意力机制 q 次,从而获得更大的感知野,捕捉更远距离的依赖关系,每次计算wkv 时 ,仍然将原始输入的K经过S-Scan操作后作为输入,而V则变成上次Bi-WKV操作的输出。

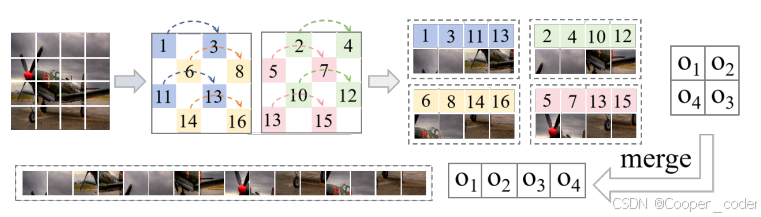

3.Skip Scanning

如图 i=0,1,2,3,4 四种取值,(a,b)=(0,0),(1,0),(0,1),(1,1) 四种取值,然后每个Oi经过merge操作之后重新排序,由于代码没有开源,暂时还不知道merge操作的具体是什么。

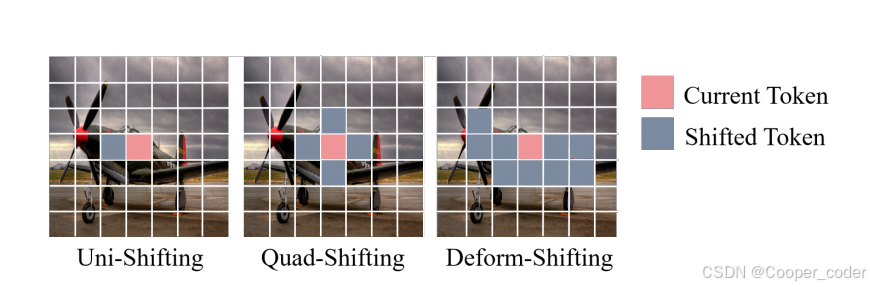

4.Deformable shifting

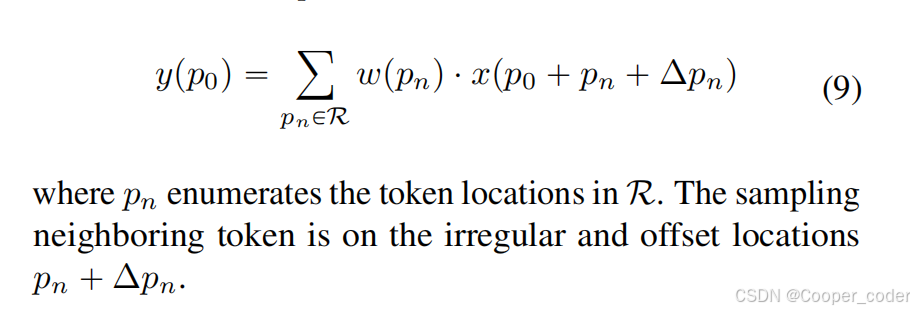

为了更加有效的提取二维图像的局部特征,作者将Quad-Shifting 替换成可学习的可变形卷积:

可变形卷积这里挖了个坑。。。。。。

Experiments

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?