Building your Deep Neural Network: Step by Step

您将构建一个深层神经网络,拥有您想要的多个层!

完成此任务后,您将能够:

- 使用ReLU等非线性单位来改善您的模型。

- 构建更深层的神经网络(具有多于1个隐藏层)。

- 实现易于使用的神经网络类。

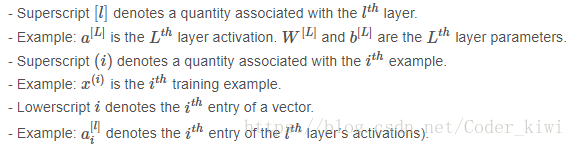

符号:

1 - 包

- numpy是使用Python进行科学计算的主要软件包。

- matplotlib是一个用Python绘制图形的库。

- dnn_utils为这款笔记本提供了一些必要的功能。

- testCases提供了一些测试用例来评估函数的正确性

- np.random.seed(1)用于保持所有随机函数调用一致。 它将帮助我们评估您的工作。 请不要改变种子。

import numpy as np

import h5py

import matplotlib.pyplot as plt

from testCases import *

from dnn_utils import sigmoid, sigmoid_backward, relu, relu_backward

%matplotlib inline

plt.rcParams['figure.figsize'] = (5.0, 4.0) # set default size of plots

plt.rcParams['image.interpolation'] = 'nearest'

plt.rcParams['image.cmap'] = 'gray'

%load_ext autoreload

%autoreload 2

np.random.seed(1)

2 - 作业概要

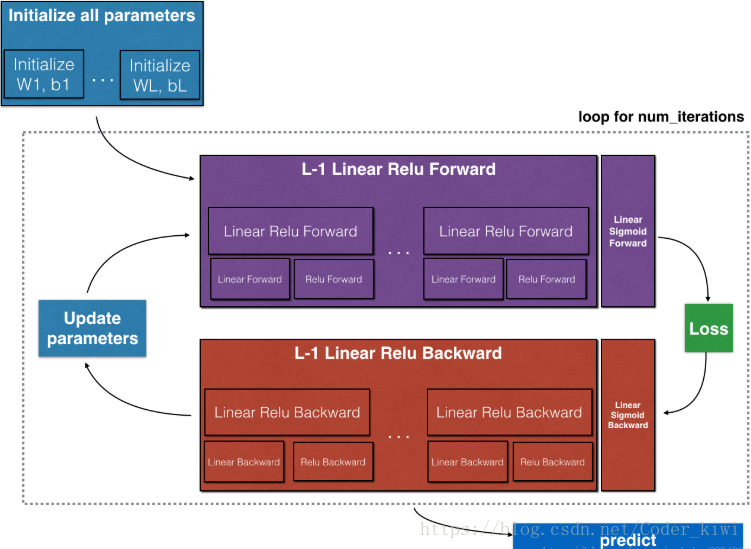

要构建您的神经网络,您将实现几个“辅助函数”。这些辅助函数将用于下一个任务,以构建一个双层神经网络和一个L层神经网络。以下是此作业的概要,您将:

- 初始化双层网络和L层神经网络的参数。

- 实现前向传播模块(如下图中的紫色所示)。

-

完成图层前向传播步骤的LINEAR部分(得到Z [1])。

-

我们为您提供ACTIVATION功能(relu / sigmoid)。

-

将前两个步骤组合成一个新的[LINEAR-> ACTIVATION]前向功能。

-

堆叠[LINEAR-> RELU]前向功能L-1时间(对于第1层到第L-1层)并在末尾添加[LINEAR-> SIGMOID](对于最后一层L)。这为您提供了一个新的L_model_forward函数。

- 计算损失。

- 实现后向传播模块(下图中以红色表示)。

- 完成图层向后传播步骤的LINEAR部分。

-

我们给你ACTIVATE函数的渐变(relu_backward / sigmoid_backward)

-

将前两个步骤组合成一个新的[LINEAR-> ACTIVATION]向后功能。

-

向后堆叠[LINEAR-> RELU] L-1次并在新的L_model_backward函数中向后添加[LINEAR-> SIGMOID]

- 最后更新参数。

注意:对于每个前向功能,都有相应的后向功能。在转发模块的每一步中,您都会将一些值存储在缓存中。缓存的值对计算渐变很有用。在反向传播模块中,您将使用缓存来计算渐变。此作业将向您显示如何执行这些步骤。

3 - 初始化

您将编写两个辅助函数来初始化模型的参数。第一个函数将用于初始化双层模型的参数。第二个将把这个初始化过程推广到L层。

3.1 - 2层神经网络

练习:创建并初始化2层神经网络的参数。

说明:

- 模型的结构是:LINEAR - > RELU - > LINEAR - > SIGMOID。

- 对权重矩阵使用随机初始化。使用正确形状的np.random.randn(shape)* 0.01。

- 对偏差使用零初始化。使用np.zeros(shape)。

# GRADED FUNCTION: initialize_parameters

def initialize_parameters(n_x, n_h, n_y):

"""

Argument:

n_x -- size of the input layer

n_h -- size of the hidden layer

n_y -- size of the output layer

Returns:

parameters -- python dictionary containing your parameters:

W1 -- weight matrix of shape (n_h, n_x)

b1 -- bias vector of shape (n_h, 1)

W2 -- weight matrix of shape (n_y, n_h)

b2 -- bias vector of shape (n_y, 1)

"""

np.random.seed(1)

### START CODE HERE ### (≈ 4 lines of code)

W1 = np.random.randn(n_h, n_x) * 0.01

b1 = np.zeros((n_h, 1))

W2 = np.random.randn(n_y, n_h) * 0.01

b2 = np.zeros((n_y, 1))

### END CODE HERE ###

assert(W1.shape == (n_h, n_x))

assert(b1.shape == (n_h, 1))

assert(W2.shape == (n_y, n_h))

assert(b2.shape == (n_y, 1))

parameters = {"W1": W1,

"b1": b1,

"W2": W2,

"b2": b2}

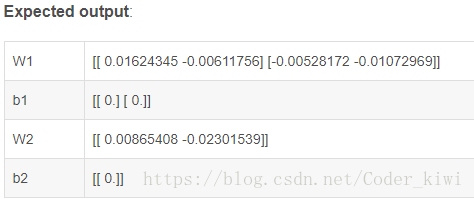

return parameters parameters = initialize_parameters(2,2,1)

print("W1 = " + str(parameters["W1"]))

print("b1 = " + str(parameters["b1"]))

print("W2 = " + str(parameters["W2"]))

print("b2 = " + str(parameters["b2"]))

3.2 - L层神经网络

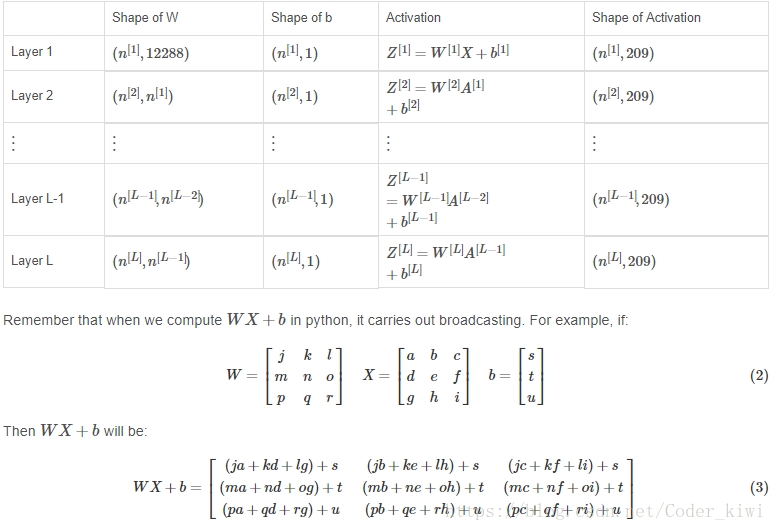

更深层的L层神经网络的初始化更复杂,因为有更多的权重矩阵和偏置向量。 完成initialize_parameters_deep后,您应确保每个图层之间的尺寸匹配。 回想一下,n [l]是层l中的单元数。 因此,例如,如果我们的输入X的大小是(12288,209)(m = 209个例子)那么:

练习:实现L层神经网络的初始化。

说明:

- 模型的结构是[LINEAR - > RELU]×(L-1) - > LINEAR - > SIGMOID。即,它具有L-1层,使用ReLU激活函数,接着是具有S形激活函数的输出层。

- 对权重矩阵使用随机初始化。使用np.random.rand(shape)* 0.01。

- 对偏差使用零初始化。使用np.zeros(shape)。

- 我们将在变量layer_dims中存储n [l],即不同层中的单元数。例如,上周的“平面数据分类模型”的layer_dims将是[2,4,1]:有两个输入,一个隐藏层有4个隐藏单元,一个输出层有一个输出单元。因此,W1的形状为(4,2),b1为(4,1),W2为(1,4),b2为(1,1)。现在你将它推广到L层!

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3160

3160

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?