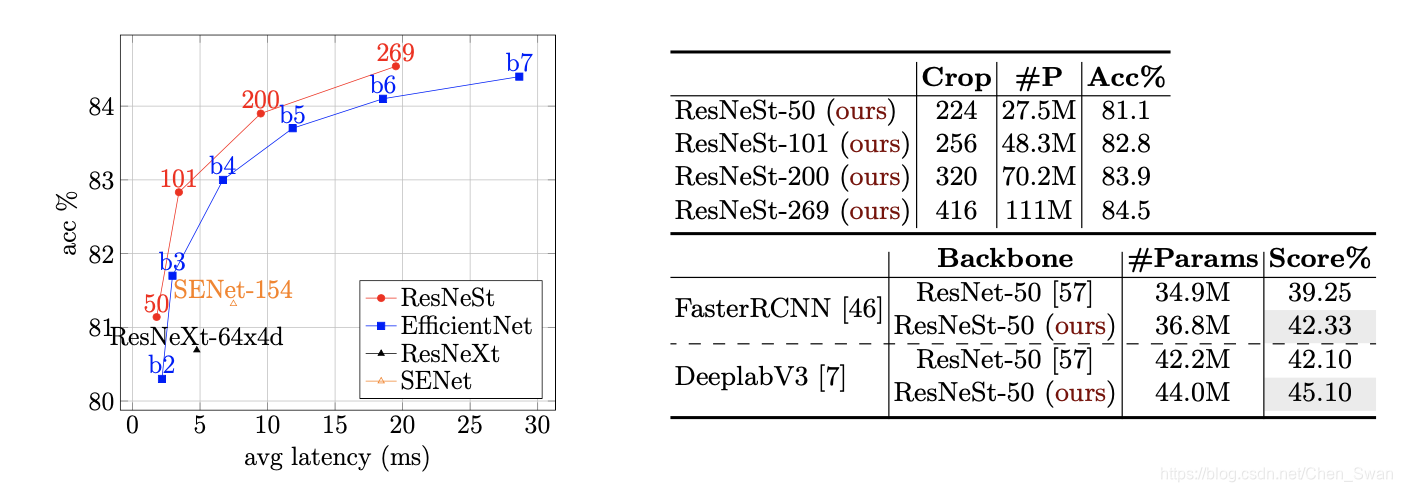

摘要:ResNest主要贡献是设计了一个Split-Attention模块,可以实现跨通道注意力。通过以ResNet样式堆叠Split-Attention块,获得了一个ResNet的变体。ResNest网络保留了完整的ResNet结构,可以直接用下游任务,而不会引起额外的计算成本。ResNest在分类、FasterRCNN、DeeplabV3上都有提升。

动机:著名的ResNet是针对图像分类设计的,对其他视觉任务的效果可能不是很好。在其他视觉任务中,使用图像金字塔或跨通道特征图注意力提高模型性能。因此ResNest希望能直接在backbone中实现跨通道的网络。

贡献:

1. 对ResNet进行修改,在单个网络内合并了特征图的拆分注意力。具体来说,把每个块的特征图分成几组(沿通道维度)和更细粒度的子组或分割,其中,每个组的特征表示是通过其分割表示的加权组合确定的。这个单元就是模块化的Split-Attention,通过叠加几个Split-Attention块,创建了一个类似ResNet的网络,即ResNest(S代表“split”)。

2. ResNest可用于图像分类、对象检测、实例分割、语义分割并取得良好的性能。在MS-COCO实例分割中,使用ResNeSt-101主干的Cascade-RCNN模型实现了48.3%的框mAP和41.56%的掩码mAP。我们的单个DeepLabV3 模型再次使用ResNeSt-101主干,在ADE20K场景解析验证集上的mIoU达到46.9%,比

ResNest通过Split-Attention模块实现跨通道注意力,改进ResNet以适应多种视觉任务。它在图像分类、Faster R-CNN、DeeplabV3等任务上表现出色,如在MS-COCO实例分割中实现48.3%的框mAP和41.56%的掩码mAP。

ResNest通过Split-Attention模块实现跨通道注意力,改进ResNet以适应多种视觉任务。它在图像分类、Faster R-CNN、DeeplabV3等任务上表现出色,如在MS-COCO实例分割中实现48.3%的框mAP和41.56%的掩码mAP。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

431

431

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?