在上一篇文章中初步地了解了机器学习的一些概念并接触了代价函数的数学定义,今天从代价函数开始继续学习机器学习

代价函数(cost function)

代价函数

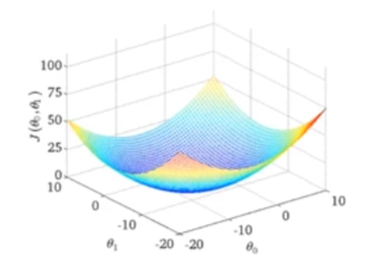

为了更好地让代价函数J可视化,令 ,从而获得代价函数

取一个只有(1,1)(2,2)(3,3)训练集,当 分别取到1、0.5、0时,代价函数的输出值为0、0.58、2.3,若是把

能取到的所有值对应的代价函数值画出来,我们能观察到

的形状像二次函数,而当

取到1时代价函数的值最小且为0。而学习算法的目标,就是通过选择

的值来获得最小的

。

但如果 不为0,例如取到50,并且取

为0.06,代价函数

的图像如下图:

代价函数三维碗状图

曲面的高度就是代价函数的值,水平方向上的点的高度都是一致的,用等高图来表示可以更清晰地看到:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1255

1255

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?